使用 SEO 爬虫寻找 CRO 机会

已发表: 2022-08-12

人类仍然需要,但是,男孩,爬虫可以帮忙吗

我做 CRO 的时间越长,我就越意识到不同类型研究的重要性。 多年来,我沉迷于定量数据(在某种程度上仍然如此)。 将干净可靠的数据收集到近乎完美的 Google Analytics 设置中。 这将导致最好的 CRO 计划,对吗? 它确实让你在一个很好的地方开始,但这只是一个开始。

在这篇文章中,我将分享我多年来在分析和 SEO 期间开发的内部搜索结果工作流程,这将有助于加快您对 CRO 计划应该关注的领域的研究。

认识尖叫的青蛙。

搜索结果(内部站点搜索)深入研究

我很容易向您展示意图映射(对于搜索者意图和 SERP 意图)以显示何时缺少相关性(对于关键字和页面类型)。 也许那会在以后发生,但我认为这已经做了很多。

相反,我想谈谈更接近转化的东西,即您的内部网站搜索结果。

站点搜索是您的用户真正想要某物的更大信号之一。

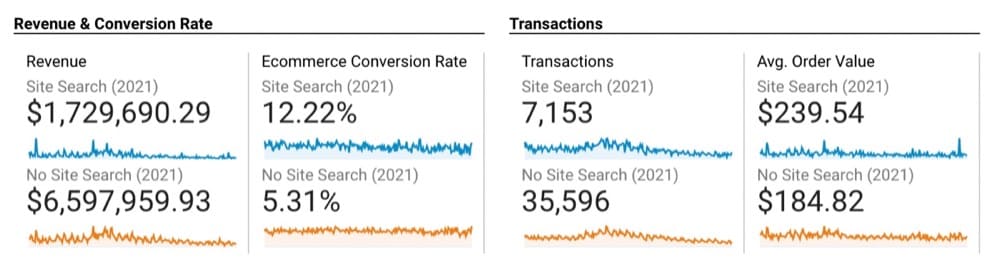

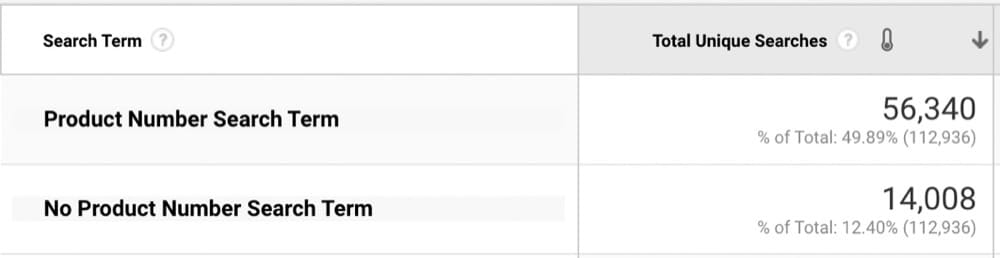

我们可以从这个泳池用品网站上看到搜索用户与不搜索用户的区别:

当用户搜索时,转化次数增加 130% 并不过分令人惊讶,但它确实显示了提供最佳搜索体验的能力。

现在让我们深入研究搜索词以确保优化体验。

我的第一个建议是下载所有搜索词(过去 12 个月通常是最有意义的,除非你的季节性很强)。

接下来,通过集群工具运行它们,以了解人们如何在更高级别进行搜索(这将为您提供比梳理数千个 KW 更好的方向)。

(在聚类之前,请确保您标准化和清理您的 KW 以防止拼写错误和/或不同的案例处理。)

使用 =trim(clean(lower(cell-number))) 为您的公式清理 Google 表格中的内容。

现在,将它们从 MarketBold 复制并粘贴到 Keyword Grouper Pro(这是免费的)。

要组成一个小组,您将估计有多少基于我使用 1,000 个关键字开始,所以猜测每组 10 个将给我正确数量的组。 你永远不知道你想要多少个组,但你应该有足够的数据来代表你的用户根据你上传的数量进行搜索(你会在这方面做得更好)。

通过 GIPHY

在看到聚类的关键字时,我会根据人们的搜索方式将它们分为几个不同的类别:

- 零件号(漏斗底部没有比这更多的东西了)

- 品牌名称

- 广泛的类别类型

现在,我可以更有针对性地使用 GA 搜索词来了解要查找的内容。

在这种情况下,由于搜索产品编号的用户具有很高的购买意愿,我想从那里开始(而不仅仅是查看顶部的“x”搜索结果)。 使用一些简单的正则表达式来仅隔离产品编号(搜索词中的多个数字),我们发现 80% 的搜索包含产品编号

现在我们要从 Google Analytics 中导出我们的搜索结果。 如果您有很多搜索词,您可能需要使用 API,或者像 Google Analytics(分析)Google 表格插件(它是免费的)这样的工具。

检查搜索结果(我们在寻找什么?)

诚然,这是我第一次开始确保我不会掉进兔子洞的地方。 但是现在已经这样做了太多次了,我知道我在寻找什么

此处的“问题区域”将根据您使用的平台和搜索提供商而有所不同。 对于这种情况,我主要感兴趣的是:

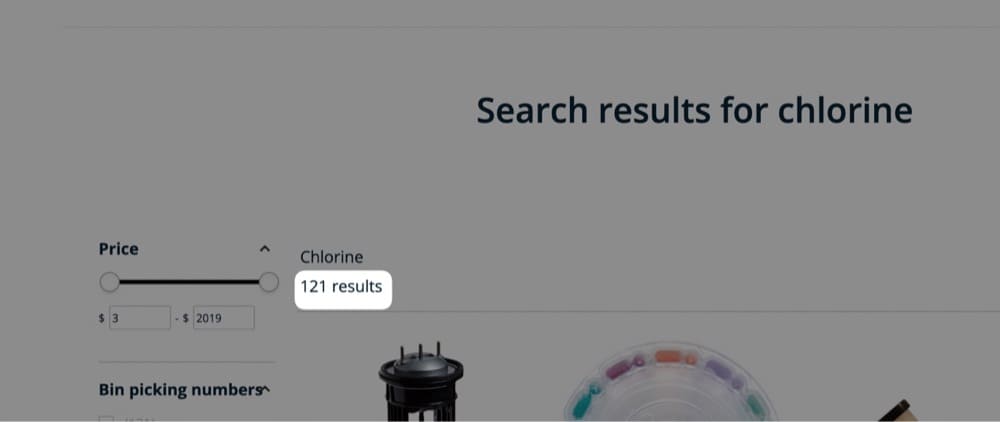

- 显示的结果数

此处显示:

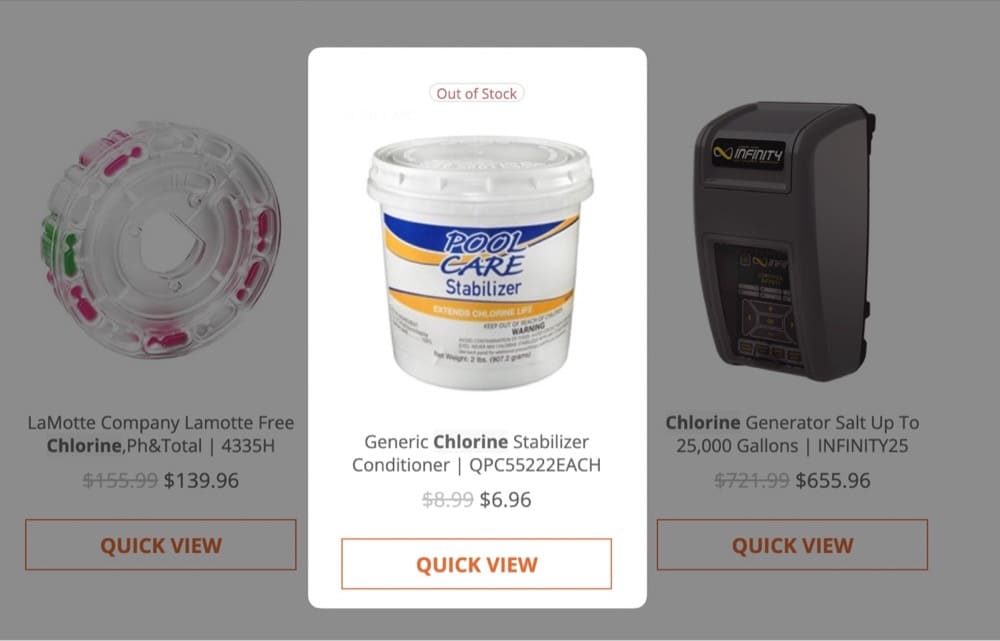

- 显示缺货的商品

此处显示:

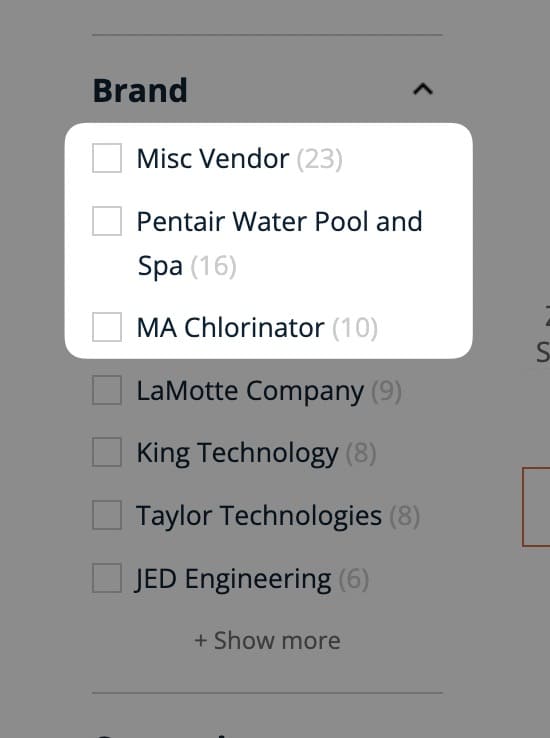

- 搜索结果所属的前 3 个类别(这可以稍后通过 VLOOKUP 来实现,但我更愿意在这里/一次全部完成)

此处显示:

以下问题有助于我理解数据:

- 我们是否为这些产品编号搜索显示了适量的搜索结果?

对于几乎所有其他类型的搜索,只有一个结果不是最佳的,但基于这些搜索,只显示 1 个结果是有意义的。 但是,非常重要的是,我们看到了这一结果!

- 哪些搜索结果返回的卡住产品最多?

对于返回大量结果的搜索也更相关。

- 哪些类别获得最多……

- 产品搜索?

- 有最缺货的结果?

- 返回的结果数量最少(这很可能会导致更高的退出)?

使用 Screaming Frog 模拟搜索结果

现在到了有趣的部分——使用 Screaming Frog!

我不会介绍如何使用 Screaming Frog 的任何方面。 这是一个非常复杂的工具,尽管我已经使用它近十年了,但我可能还可以用它做更多的事情。

他们的网站上有很棒的指南(您也可以在此下载)。:https://www.screamingfrog.co.uk/seo-spider/user-guide/(费用为每年 151.77 美元,而且价格非常低它可以做什么。)

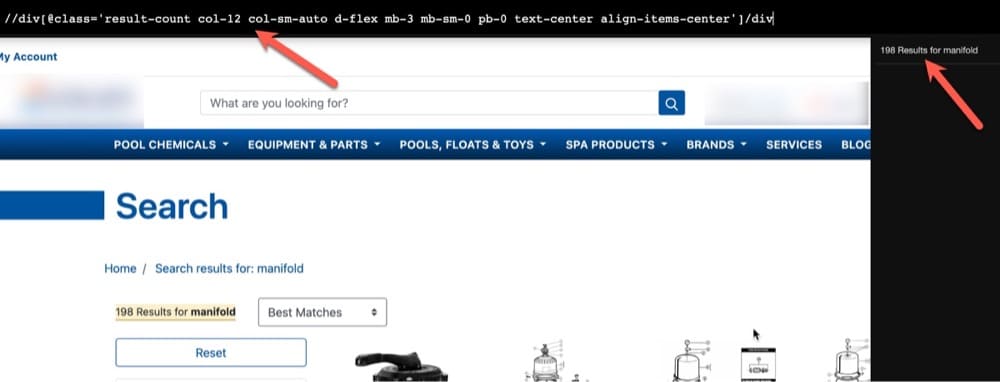

最后一个“注意细节”部分是在搜索后查看您网站的 URL 以查看模式:

了解这一点很重要,因为我们会将来自 Google Analytics 的搜索词附加到站点 URL 以匹配此模式。 我们将模拟用户使用爬虫搜索此内容并提取我们已经涵盖的感兴趣区域(搜索结果、缺货和类别)。

- 抓取 URL 中搜索词之前的所有内容:

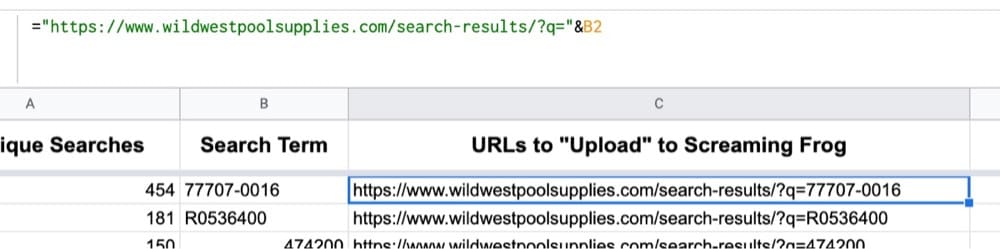

- 将该 URL 字符串与搜索词组合:

注意:如果您的搜索词中有空格,则必须使用高级正则表达式或 JS 在 URL 中添加 %20。 我个人使用 TextSoap 进行这些操作。

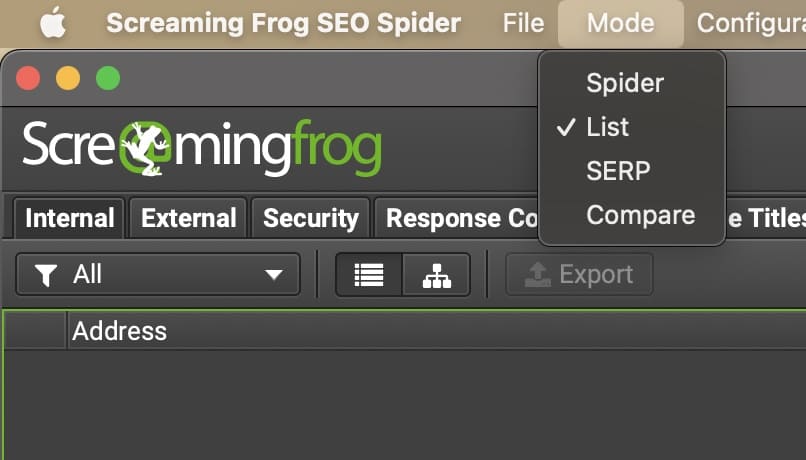

- 打开 Screaming Frog 并切换到 List 模式:

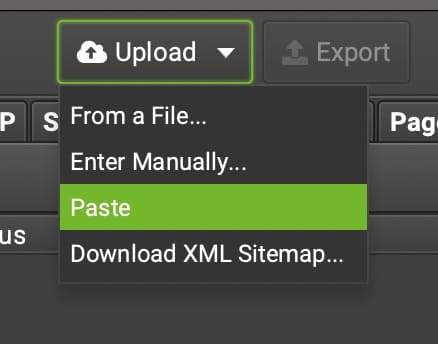

- 选择您希望如何上传您的 URL 列表(如果您的 URL 超过 10k,请不要粘贴它们,这将永远加载):

- 在运行爬虫之前,您需要想办法从站点中提取所需的元素。

我将在 SF 中显示搜索结果,其余的您可以选择要如何提取。

1.您需要提取搜索结果的数量,以了解搜索此关键字时返回的结果数量。 为此,我们将使用 XPATH(我通常在 SF 中选择的语言)。

2.我通常喜欢先尝试最简单的方法,然后只在需要时才检查元素。 #WorkSmarter 与 XPather chrome 扩展。

吉菲

3.这为我提供了我需要的 XPATH,以及我在 Screaming Frog 中很可能看到的“输出”的预览。

4.注意:我不会担心只提取结果的数量。 这是 Google 表格中的 5 秒清理时间。

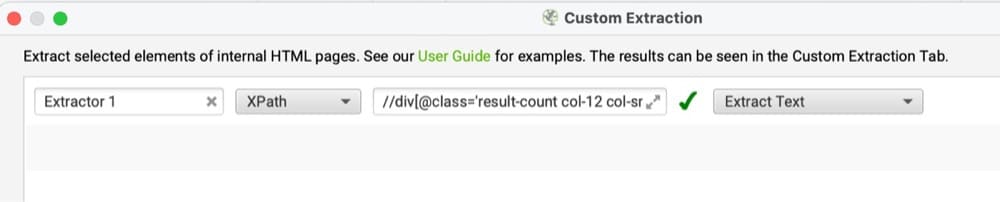

5.现在我可以在配置 → 自定义 → 提取部分下将其输入 SF,如下所示:

6.我会将输出更改为 Extract Text 以进一步清理它并删除不必要的 HTML。

7.单击确定后,您将能够抓取您之前(或可能尚未)上传的指定 URL。 (同样,我们上传 URL 的原因是为了避免抓取整个网站,只抓取我们关心的搜索词。)

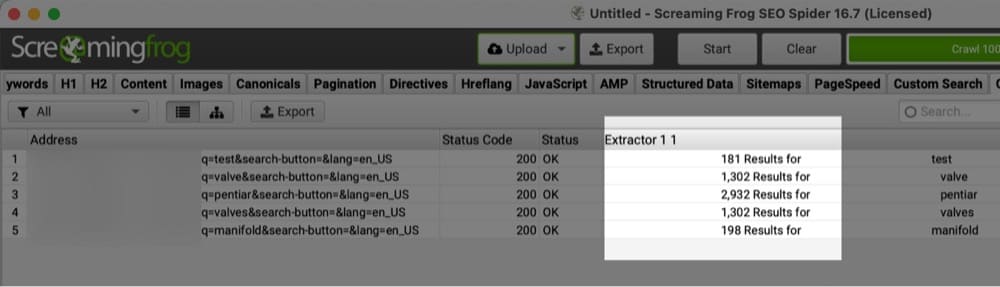

8.以下是一些 URL 的输出示例以及这些搜索词返回的搜索结果的数量:

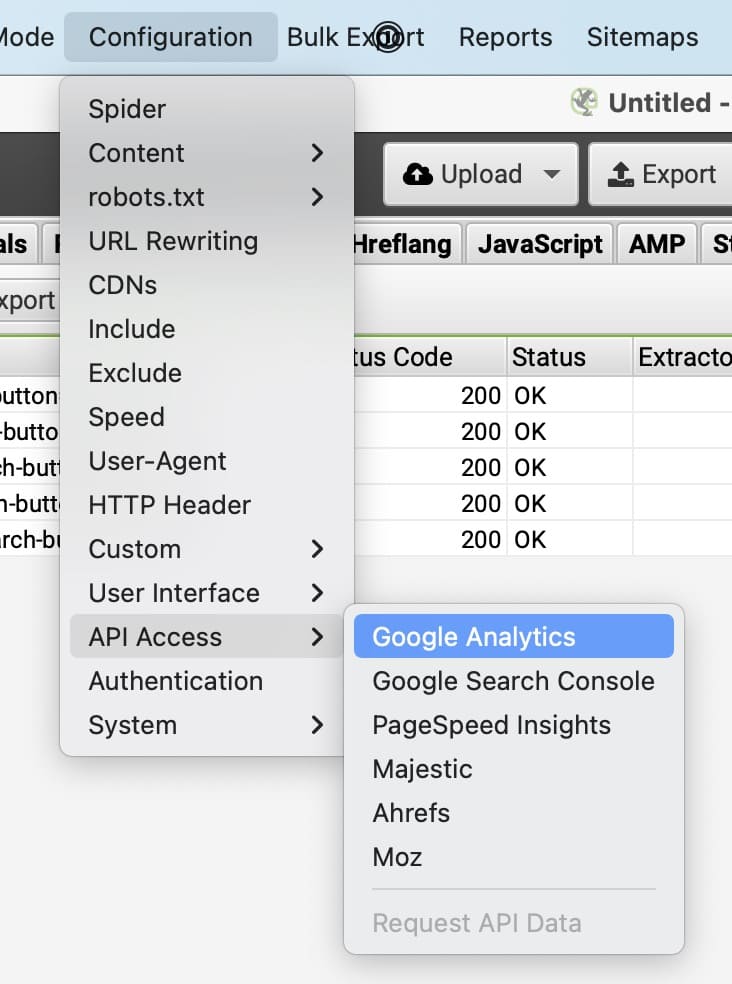

9.接下来,您可能想知道这些搜索发生的频率。 您可以在此处连接 Google Analytics 以查看相应 URL 的综合浏览量。

10.我个人觉得在这里创建一个高搜索页面与低返回结果的“比率”很有帮助。

此外,这些页面上的低结果数和高退出率之间是否存在相关性? (我看到当结果少于 10 个时会发生这种情况,这意味着搜索结果看起来并不“完整”,因为大多数网站每行的宽度不超过 5 个。)

11.您可能在此处使用的其他有用数据点(基于您的搜索结果和分面导航的显示方式):

哪些搜索结果返回的缺货结果最多? (如果您无法采取任何措施,例如在该产品有货时收到通知,您可能需要考虑将其从搜索结果中删除。)

将搜索词映射回类别(以及相关的子类别)。 帮助了解用户随时间推移的需求,并激发许多不同的见解——从新测试到对结果排序如何工作的模棱两可的关键字进行个性化。

Product # 搜索,就像我们之前展示的那样。 如果他们的产品# 没有返回任何内容,大多数人不会执行多次搜索。 这可能不是一个容易立即解决的问题,但您可以显示退出意图弹出窗口,以便在该产品重新入库时获得通知。

使用 URL 作为变量来传递您用于弹出式提供程序的任何形式,以便您知道他们所追求的产品#。

我可以继续讲下去,但希望这些示例有助于更好地了解如何抓取自己的搜索结果,以便更好地了解他们为用户提供的体验类型。

注意:您可能已经注意到我切换了从这里提取的站点。 当我开始写这篇博文时,第一个站点使用了不同的搜索提供程序,然后它发生了变化,我想展示一个基于 XPATH 与深入研究其他方法的更好示例(这通常是最可靠的方法,以及 CSS选择器)。

第二个注意事项:在 Google Analytics 中过滤掉您的爬虫的 IP 地址,这样您就不会将自己计入您的网页浏览量中。 如果您在窗口加载后 2-3 秒触发您的综合浏览量标签,则无需担心像这样的爬虫或机器人流量(感谢您,这是一个更有用的数据真相)。

扩展+自动化此过程的领域

你们中的一些人可能会说,“这不是自动化的,我不想手动执行此操作。”

这是一个完全正确的观点。 我个人不介意,因为我的大多数客户都没有返回数百万个搜索结果来保证每周(或更多)执行此操作。 这通常是我与 Google Analytics 一起执行的每月或每季度的任务,以查看趋势和模式是否正在发生变化。

如果你更懂技术,你可以坚持使用 Screaming Frog 并设置一个 VPS 解决方案来在云中运行自动抓取,并在完成后将结果推送到 Google BigQuery。 SF对此有很好的指导。

还有其他一些更“交钥匙”的解决方案,而且肯定更少动手,比如 ContentKing(我过去曾使用过它们),它还允许在达到某些阈值时发出“警报”。 (想想没有返回结果的产品编号搜索 = 电子邮件或 Slack 通知)。

使用 SEO 爬虫寻找的其他领域

希望这让您更加了解使用 SEO 爬虫获取优化见解的可能性。 (尖叫的青蛙只是其中之一,但我推荐的)。

内部搜索结果只是我使用爬虫的一小部分。 爬虫可以为您找到更多内容。 在与客户合作时,我以许多不同的方式使用它们。

如果您对此或其他任何与 CRO 相关的具体问题或意见,请随时通过 LinkedIn、Twitter 或电子邮件与我联系:[email protected]。