Поиск возможностей CRO с помощью поисковых роботов

Опубликовано: 2022-08-12

Люди все еще нужны, но, мальчик, могут ли краулеры помочь

Чем дольше я занимаюсь CRO, тем больше понимаю важность различных видов исследований. В течение многих лет я сильно увлекался (и до сих пор в какой-то степени) количественными данными. Достижение чистого и надежного сбора данных в практически идеальных настройках Google Analytics. Это приведет к лучшим программам CRO, верно? Это, безусловно, поможет вам начать с отличного места, но это только начало.

В этом посте я собираюсь поделиться внутренним рабочим процессом результатов поиска, который я разработал за годы моей аналитики и дней SEO, который поможет ускорить ваше исследование областей, на которых должна сосредоточиться ваша программа CRO.

Познакомьтесь с кричащей лягушкой.

Результаты поиска (внутренний поиск по сайту) Глубокое погружение

Мне было бы легко показать вам сопоставления намерений (как для намерения поисковика, так и для намерения SERP), чтобы показать, когда релевантность отсутствует (как для ключевых слов, так и для типов страниц). Возможно, это будет позже, но я думаю, что уже сделано немало.

Вместо этого я хочу поговорить о чем-то еще более близком к конверсии, а именно о результатах вашего внутреннего поиска по сайту.

Поиск по сайту — один из главных сигналов того, что ваши пользователи действительно чего-то хотят.

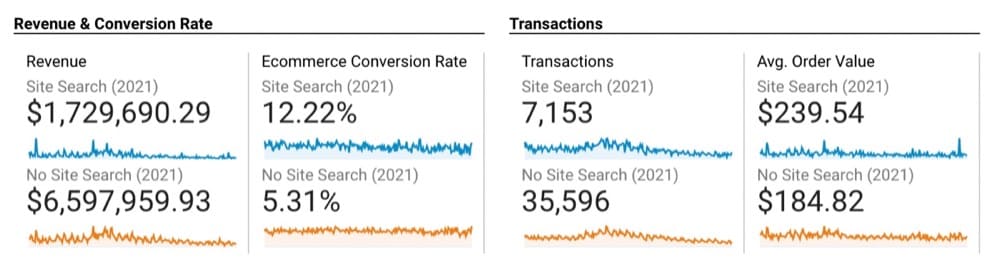

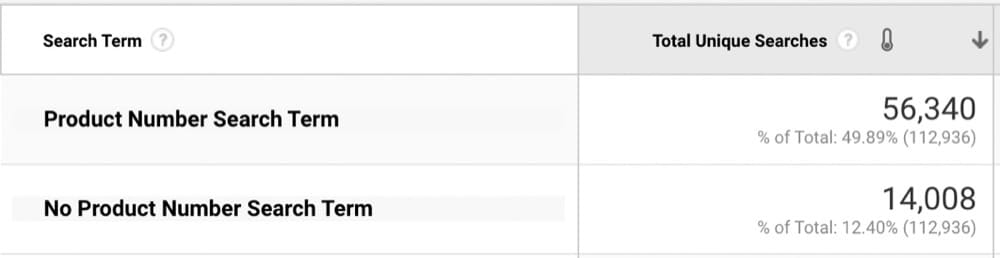

Здесь мы можем увидеть разницу между пользователями, которые ищут, и теми, кто этого не делает:

На 130 % больше конверсий при поиске пользователями не слишком удивительно, но это показывает силу обеспечения наилучшего возможного поиска.

Теперь давайте углубимся в условия поиска, чтобы убедиться, что опыт оптимизирован.

Моя первая рекомендация — загрузить все ваши поисковые запросы (последние 12 месяцев обычно имеют смысл, если вы не очень сезонны).

Затем пропустите их через кластерный инструмент, чтобы понять, как люди ищут на более высоком уровне (это даст вам лучшее направление, чем прочесывание тысяч KW).

(Перед кластеризацией убедитесь, что вы стандартизировали и очистили свои KW от орфографических ошибок и/или другой обработки регистров.)

Используйте =trim(clean(lower(cell-number))) для вашей формулы, чтобы очистить их в Google Sheets.

Теперь скопируйте и вставьте их в Keyword Grouper Pro от MarketBold (это бесплатно).

Чтобы сформировать группу, вы оцените, сколько исходя из того, что я использую 1000 ключевых слов для начала, поэтому, предположив, что 10 на группу дадут мне правильное количество групп здесь. Вы никогда не знаете, сколько групп вам нужно, но у вас должно быть достаточно, чтобы ваши пользователи выполняли поиск в зависимости от того, сколько вы загружаете (вы научитесь это делать по мере использования).

через GIPHY

Увидев сгруппированные ключевые слова, я бы сгруппировал их в несколько разных категорий в зависимости от того, как люди ищут:

- Номера деталей (нижняя часть воронки не более того)

- Торговые марки

- Типы широких категорий

Теперь я могу лучше ориентироваться в поисковых запросах GA, чтобы знать, что искать.

В этом сценарии, поскольку пользователи, которые ищут номера продуктов, имеют высокие покупательские намерения, я бы хотел начать с этого (а не просто смотреть на верхние «x» результаты поиска). С помощью простого регулярного выражения для выделения только номеров продуктов (более одного номера в условиях поиска) мы обнаруживаем, что 80% поисковых запросов содержат номер продукта.

Теперь нам нужно экспортировать результаты поиска из Google Analytics. Если у вас много условий поиска, вам может понадобиться использовать API или инструмент, такой как надстройка Google Analytics Google Sheets (это бесплатно).

Проверка результатов поиска (что мы ищем?)

По общему признанию, именно здесь я впервые начал убеждаться, что не попаду в кроличью нору. Но проделав это слишком много раз, чтобы сосчитать сейчас, я знал, что ищу.

«Проблемные области» здесь будут различаться в зависимости от того, какую платформу и поисковую систему вы используете. Для этого сценария меня в основном интересует:

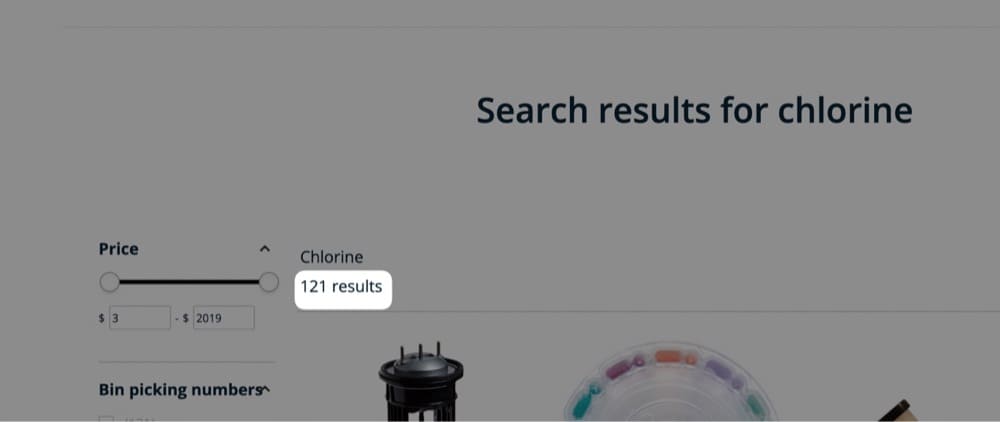

- количество отображаемых результатов

Здесь показано:

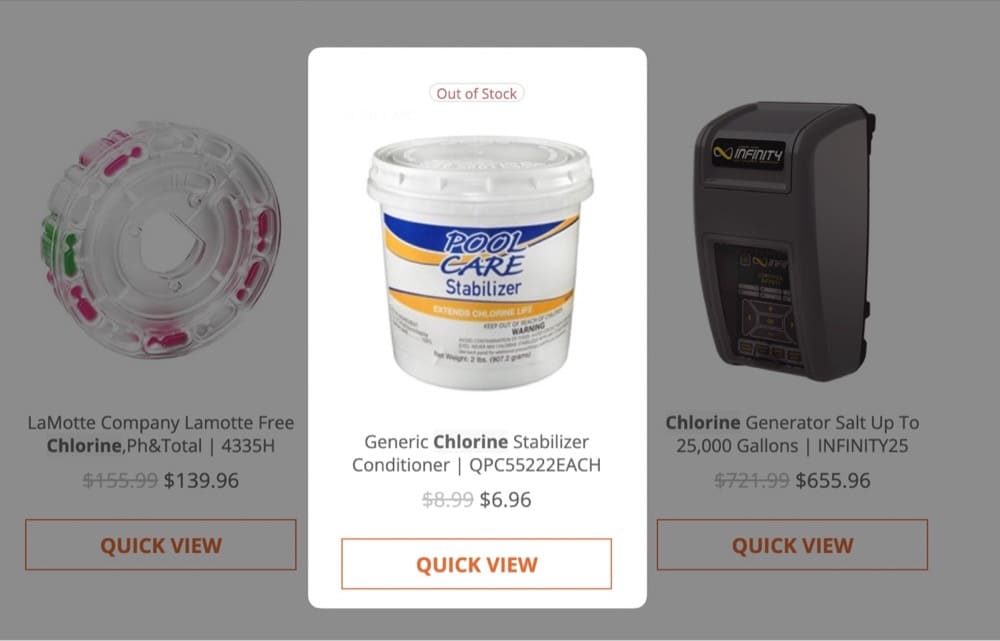

- Товары, которых нет в наличии

Здесь показано:

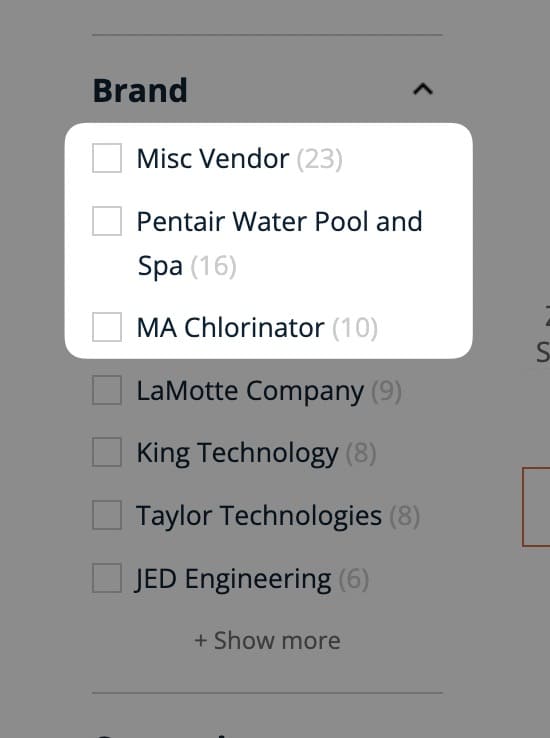

- 3 верхние категории, под которые попадают результаты поиска (этого можно добиться с помощью ВПР позже, но я бы предпочел сделать это здесь/все сразу)

Здесь показано:

Следующие вопросы помогают мне понять данные:

- Показываем ли мы правильное количество результатов поиска для этих запросов по номеру продукта?

Почти для всех других типов поиска наличие только одного результата было бы менее чем оптимальным, но на основе этих поисков имеет смысл показать только 1 результат. Но очень важно, что мы видим этот единственный результат, однако!

- Какие результаты поиска вернули больше всего зависших продуктов?

Также немного более актуален для поисков, которые возвращают много результатов.

- Какие категории получают больше всего…

- Поиск продукта?

- У вас больше всего нет в наличии результатов?

- Возвращается наименьшее количество результатов (что, скорее всего, приведет к большему количеству выходов)?

Использование Screaming Frog для имитации результатов поиска

Теперь начинается самое интересное — использование Screaming Frog!

Я не буду освещать какие-либо аспекты использования Screaming Frog. Это очень сложный инструмент, и хотя я использую его почти десять лет, я, вероятно, мог бы сделать с ним еще больше.

У них есть отличные руководства на их сайте (где вы также можете скачать его): https://www.screamingfrog.co.uk/seo-spider/user-guide/ (стоимость составляет 151,77 доллара в год и невероятно занижена для что он может сделать)

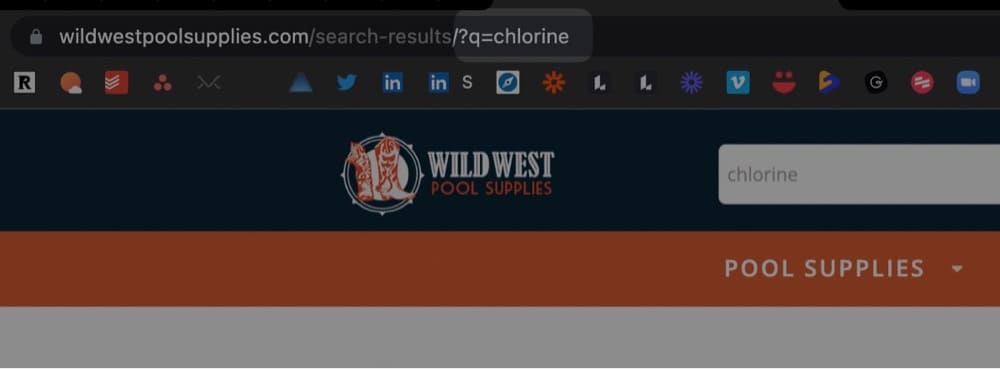

Последняя часть «внимания к деталям» — просмотр URL-адреса вашего сайта после поиска, чтобы увидеть шаблон:

Это важно знать, так как мы будем добавлять поисковый запрос из Google Analytics к URL-адресам сайта, чтобы соответствовать этому шаблону. Мы будем имитировать пользователя, ищущего это с помощью сканера, и извлекать области интереса, которые мы уже рассмотрели (результаты поиска, отсутствие на складе и категории).

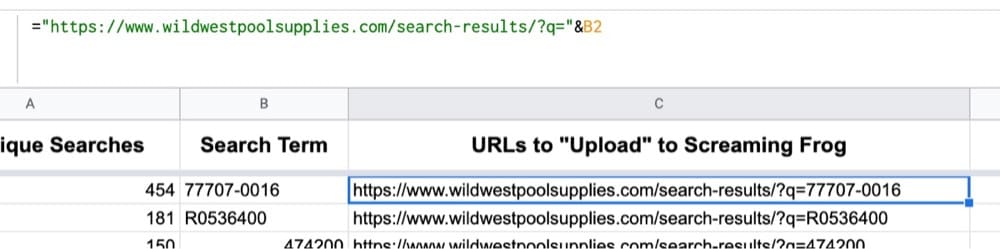

- Возьмите все, что находится перед вашим поисковым запросом в URL-адресе:

- Объедините эту строку URL с поисковым запросом:

Примечание: если в ваших условиях поиска есть пробелы, вам придется использовать расширенное регулярное выражение или JS, чтобы добавить %20 в URL-адрес. Я лично использую TextSoap для этих манипуляций.

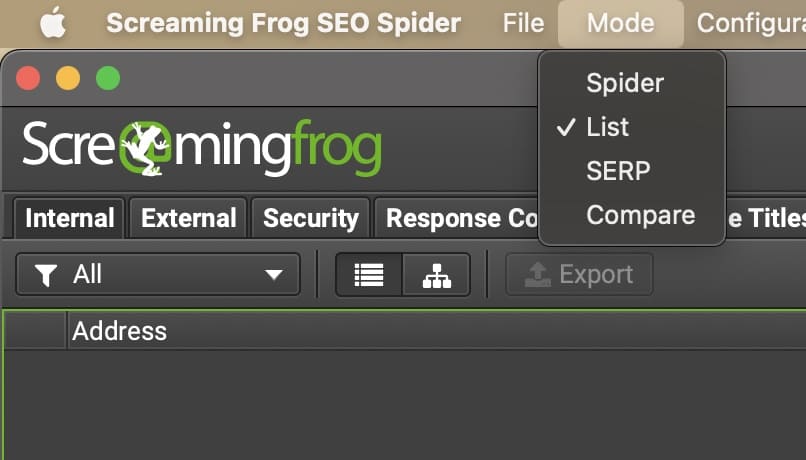

- Откройте Screaming Frog и переключитесь в режим списка:

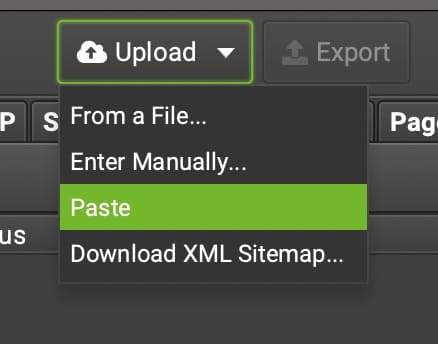

- Выберите, как вы хотите загрузить свой список URL-адресов (не вставляйте их, если у вас более 10 КБ, загрузка займет вечность):

- Прежде чем запускать поисковый робот, вам нужно выяснить, как извлечь необходимые элементы с сайта.

Я покажу результаты поиска здесь, в SF, а остальные вы можете выбрать, как вы хотите извлечь.

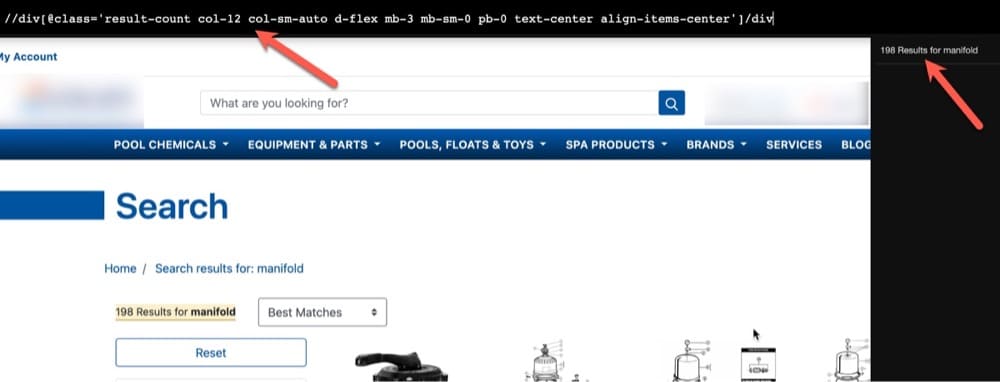

1. Вы захотите извлечь количество результатов поиска, чтобы узнать, сколько результатов возвращается при поиске по этому ключевому слову. Для этого мы будем использовать XPATH (я обычно выбираю язык в SF).

2. Обычно я предпочитаю сначала попробовать самый простой из возможных способов, а затем приступать к проверке элемента только тогда, когда это необходимо. #WorkSmarter с расширением XPather для Chrome.

GIPHY

3. Это дает мне нужный мне XPATH, а также предварительный просмотр «вывода» того, что я, скорее всего, увижу в Screaming Frog.

4. Примечание. Я не буду беспокоиться только об извлечении количества результатов. Это 5-секундная очистка в Google Таблицах.

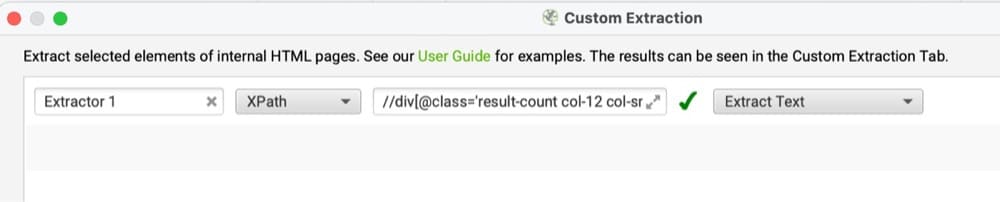

5. Теперь я могу ввести это в SF в разделе «Конфигурация» → «Пользовательский» → «Извлечение», как показано здесь:

6. Я изменю вывод на Извлечь текст, чтобы очистить его больше и исключить ненужный HTML.

7. После того, как вы нажмете OK, вы сможете сканировать указанные URL-адреса, которые вы ранее (или, возможно, еще не) загрузили. (Опять же, причина, по которой мы загрузили URL-адреса, заключалась в том, чтобы не сканировать весь сайт и сканировать только те поисковые запросы, которые нам интересны.)

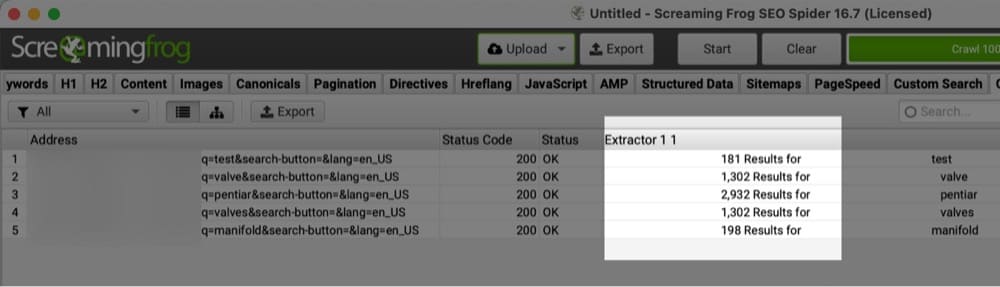

8. Вот пример вывода для нескольких URL-адресов и количества результатов поиска, возвращенных этими поисковыми запросами:

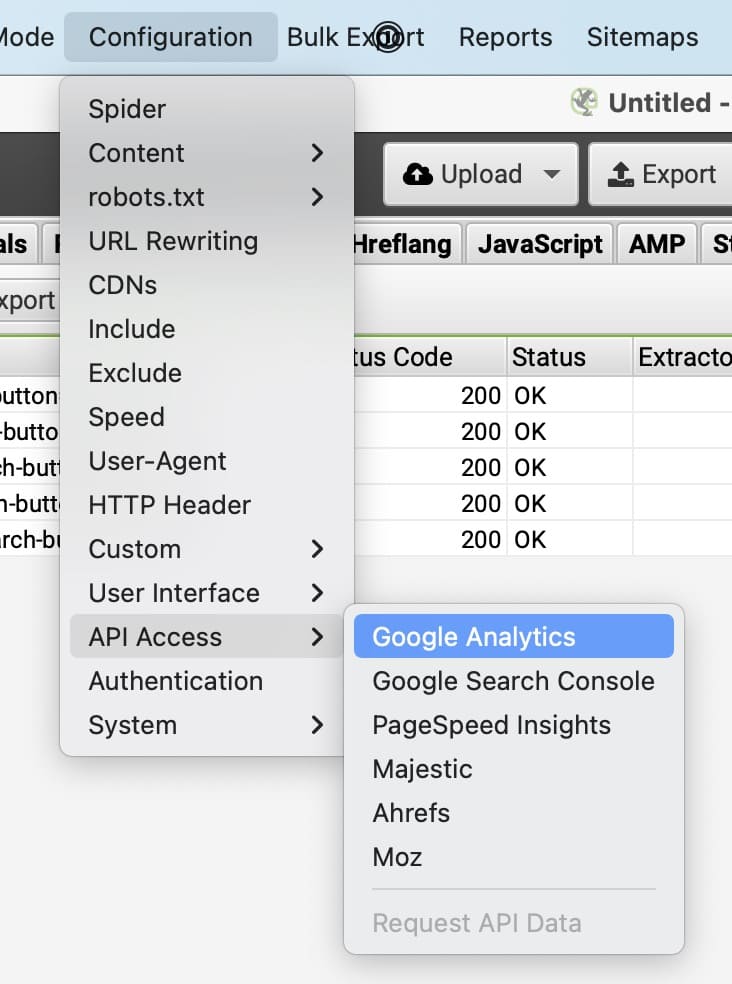

9. Затем вы, вероятно, захотите узнать, как часто происходят эти поиски. Здесь вы можете подключить Google Analytics, чтобы увидеть количество просмотров страниц для соответствующих URL-адресов.

10. Лично я считаю полезным создать «соотношение» высоких страниц поиска к низкому числу возвращаемых результатов.

Кроме того, существует ли корреляция между низким количеством результатов и большим количеством выходов на этих страницах? (Я вижу, что это происходит, когда результатов менее 10, что означает, что результаты поиска не выглядят «полными», поскольку на большинстве сайтов ширина каждой строки не превышает 5.)

11. Другие полезные данные, которые вы можете использовать здесь (в зависимости от того, как отображаются ваши результаты поиска и многогранная навигация):

Какие результаты поиска возвращают больше всего результатов, которых нет в наличии? (Если вы не можете предпринять какие-либо действия, например, получить уведомление о наличии товара на складе, возможно, вы захотите удалить это из результатов поиска.)

Сопоставление условий поиска с категориями (и подкатегориями, если это необходимо). Помогает понять спрос со временем со стороны пользователей и дает множество различных идей — от новых тестов до персонализации неоднозначных ключевых слов в том, как работает сортировка результатов.

Поиск продукта #, как мы показали ранее. Большинство людей не будут выполнять многократный поиск, # если их продукт ничего не возвращает. Это может быть нелегко исправить сразу, но вы можете показать всплывающее окно с намерением выйти, чтобы получить уведомление о том, когда этот продукт снова появится на складе.

Используйте URL-адрес в качестве переменной для передачи в любой форме, которую вы используете для своего поставщика всплывающих окон, чтобы вы знали, # какой продукт им нужен.

Я мог бы продолжить здесь, но, надеюсь, эти примеры помогли лучше понять, как вы можете очищать свои собственные результаты поиска, чтобы лучше понять, какой опыт они предоставляют пользователям.

Примечание. Возможно, вы заметили, что я переключил сайты, которые извлекаю отсюда. Когда я начал эту запись в блоге, первый сайт использовал другую поисковую систему, затем она изменилась, и я хотел показать лучший пример, основанный на XPATH, а не на других методах (обычно это самый надежный метод, наряду с CSS). селекторы).

Второе примечание: отфильтруйте IP-адрес вашего поискового робота в Google Analytics, чтобы не учитывать себя в количестве просмотров страниц. Если вы активируете тег просмотра страницы через 2-3 секунды после загрузки окна, вам не нужно беспокоиться о трафике сканеров или ботов, подобном этому (и слава вам, это гораздо более полезная правда данных).

Масштабирование + области автоматизации этого процесса

Некоторые из вас могут сказать: «Ну, это не автоматизировано, я не хочу делать это вручную».

Это совершенно верное замечание. Я лично не возражаю, потому что у большинства моих клиентов нет миллионов результатов поиска, чтобы оправдать это еженедельно (или чаще). Обычно это ежемесячная или ежеквартальная задача, которую я выполняю вместе с Google Analytics, чтобы увидеть, меняются ли тенденции и закономерности.

Если вы более техничны, вы можете придерживаться Screaming Frog и настроить решение VPS для запуска автоматического сканирования в облаке, отправляя результаты в Google BigQuery по завершении. У SF есть хорошее руководство по этому поводу.

Существуют и другие решения, более «под ключ» и определенно менее практичные, такие как ContentKing (я использовал их в прошлом), который также позволяет «предупреждать» при достижении определенных пороговых значений. (Вспомните, что поиск по номеру продукта не дал результатов = электронная почта или уведомление Slack).

Другие области, на которые стоит обратить внимание с помощью поискового робота SEO

Надеюсь, это открыло вам глаза на возможности использования поисковых роботов SEO для получения информации об оптимизации. (Кричащая лягушка — лишь одна из многих, но я рекомендую именно ее).

Результаты внутреннего поиска — лишь малая часть того, для чего я использую поисковые роботы. Поисковые роботы могут найти для вас гораздо больше. Я использую их по-разному, когда работаю со своими клиентами.

Если у вас есть конкретные вопросы или комментарии по этому или чему-либо другому, связанному с CRO, не стесняйтесь обращаться ко мне через LinkedIn, Twitter или по электронной почте: [email protected].