Генеративный ИИ в кибербезопасности: обзор

Опубликовано: 2024-03-01Генеративный ИИ определяется как модели глубокого обучения, которые могут создавать высококачественные тексты, изображения и другой контент на основе данных, на которых они обучались.

Поколение искусственного интеллекта дает множество преимуществ в цифровом пространстве. Ярким примером является включение функций искусственного интеллекта в мобильные приложения, чтобы сделать их более привлекательными.

В сфере кибербезопасности генеративный искусственный интеллект может анализировать данные, выявлять угрозы и рекомендовать решения для предотвращения вредоносных атак. В этом сообщении блога мы углубимся в то, как поколение ИИ может помочь укрепить меры кибербезопасности.

Преимущества использования искусственного интеллекта в сфере кибербезопасности

Использование генеративного ИИ в бизнесе имеет большой потенциал. Что касается кибербезопасности, Gen AI дает такие замечательные преимущества, как:

1. Улучшенное обнаружение угроз

Генеративный ИИ может беспрепятственно наблюдать и изучать закономерности в широком диапазоне данных, что позволяет специалистам по кибербезопасности постоянно выявлять и понимать угрозы кибербезопасности.

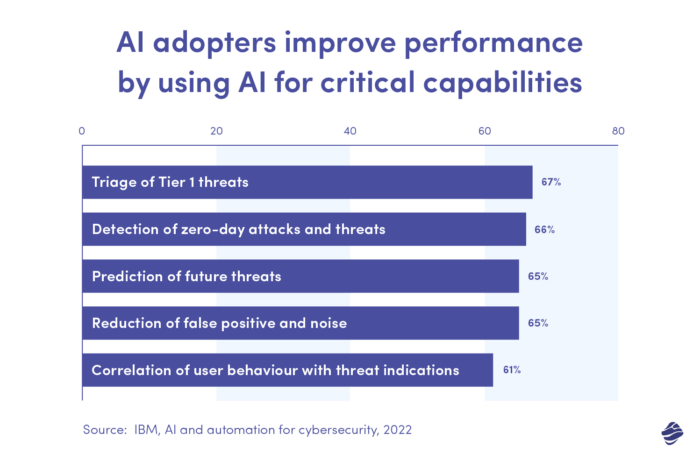

По данным исследования IBM, 66% пользователей ИИ сообщили, что генеративный ИИ помог им прогнозировать атаки и угрозы нулевого дня. Атаки нулевого дня относятся к новым угрозам, которые традиционные системы могут пропустить.

Еще 65% заявили, что Gen AI помогает коррелировать поведение пользователей для обнаружения угроз.

Благодаря Gen AI в сфере кибербезопасности будет гораздо проще выявить небольшие изменения в поведении, которые могут указывать на потенциальную атаку. Например, Gen AI может автоматически анализировать новые файлы и код для обнаружения подозрительного поведения. Или проанализируйте содержимое электронной почты, языковые шаблоны и информацию об отправителе, чтобы точно идентифицировать поддельные электронные письма.

2. Прогнозная аналитика

Поколение ИИ может делать точные прогнозы будущих результатов на основе анализа повторяющихся закономерностей в больших наборах данных, таких как журналы безопасности, сетевой трафик, информация об угрозах и т. д.

Например, Gen AI может анализировать закономерности предыдущих уязвимостей или атак и использовать их для прогнозирования возможных угроз, которые могут возникнуть в будущем. Это позволяет организациям и группам безопасности принимать меры по предотвращению таких атак.

3. Автоматические ответы

Основываясь на ранее обнаруженных закономерностях и атаках, Gen AI может генерировать автоматические ответы на различные типы угроз. Например, вы можете инициировать действия, которые блокируют вредоносные IP-адреса, корректируют правила брандмауэра против попыток вторжения или предотвращают распространение вредоносного ПО.

Используя генеративный искусственный интеллект в сфере кибербезопасности, вы также можете генерировать автоматические ответы для исправления уязвимостей безопасности перед атакой или перенаправления подозрительного трафика в ловушки для дальнейшего расследования.

Кроме того, Gen AI может автоматически создавать подробные отчеты после анализа журналов безопасности.

3 основные проблемы и риски использования генеративного искусственного интеллекта в кибербезопасности

Помимо преимуществ, существуют потенциальные риски и проблемы, связанные с использованием искусственного интеллекта поколения для кибербезопасности. К ним относятся:

1. Проблемы конфиденциальности данных

Обучение моделей генеративного ИИ или анализ существующих данных обычно означает, что вы предоставите инструментам ИИ большой объем информации от вашей организации. Так вы сможете получить более точные результаты.

Однако существует обеспокоенность по поводу того, как защищена конфиденциальность ваших данных. Например, существует вероятность того, что личная информация может быть использована не по назначению, если ее не контролировать, особенно если пренебрегаются этическими принципами и практикой управления данными.

Кроме того, модели искусственного интеллекта поколения хороши настолько, насколько хороши данные, на которых они обучаются. Таким образом, если используются предвзятые данные, существует вероятность того, что модель может пропустить определенные закономерности и сделать неточные или предвзятые прогнозы. В сфере кибербезопасности это может означать игнорирование определенных типов атак или недооценку определенных угроз.

2. Злонамеренное использование искусственного интеллекта

Инструменты Gen AI становятся все более доступными и доступными. В результате он доступен не только законной компании, занимающейся разработкой генеративного ИИ, но также может использоваться отдельными лицами со злыми намерениями.

Например, хакеры могут легко использовать генеративный искусственный интеллект для создания вредоносных кодов, нацеленных на слабые протоколы безопасности.

Кроме того, генеративный ИИ может использоваться для создания новых и сложных методов атак, что затрудняет выполнение традиционных мер безопасности.

Например, Gen AI может создавать весьма правдоподобные фальшивые электронные письма или веб-сайты, что затрудняет пользователям выявление и предотвращение мошенничества. Это означает, что ничего не подозревающие пользователи могут быть вынуждены предоставить конфиденциальную информацию или загрузить вредоносный контент.

3. Смещение рабочих мест

Эффективность — одно из главных преимуществ использования генеративного искусственного интеллекта в кибербезопасности. Эта технология может анализировать огромные объемы данных быстрее, чем традиционные методы кибербезопасности.

К сожалению, это также означает, что ИИ потенциально может заменить очень много рабочих мест. Фактически, в отчете Goldman Sachs говорится, что ИИ заменит 300 миллионов рабочих мест за счет автоматизации.

Эксперты по кибербезопасности, выполняющие повторяющиеся задачи, такие как обнаружение угроз и анализ вредоносного ПО, вероятно, будут первыми, кого затронет автоматизация поколения ИИ.

Однако не все так мрачно и обреченно. Человеческий опыт по-прежнему будет необходим. Лучшее решение, особенно для специалистов по кибербезопасности, — это переподготовка или повышение квалификации. Это особенно важно для профессионалов, выполняющих задачи начального уровня.

Для начала профессионалам необходимо освоиться с работой вместе с ИИ. Во-вторых, большему количеству организаций понадобятся эксперты, которые смогут разрабатывать надежные стратегии кибербезопасности, оптимизировать системы искусственного интеллекта и контролировать управление рисками.

Реальные применения и практические примеры использования искусственного интеллекта в кибербезопасности

Прежде чем мы продолжим, давайте кратко рассмотрим реальные примеры и варианты использования генеративного ИИ в кибербезопасности, где интеграция искусственного интеллекта (ИИ) стала важнейшим инструментом с огромным потенциалом. ИИ имеет множество применений в области кибербезопасности, которые могут помочь укрепить защиту, улучшить обнаружение угроз и повысить устойчивость цифровых инфраструктур к постоянно развивающимся киберугрозам. Давайте углубимся в примеры из реальной жизни, чтобы понять, как это можно использовать для снижения киберрисков.

Google использует генеративный искусственный интеллект не только для защиты от киберугроз в своей организации. Он также создает решения генеративного искусственного интеллекта, чтобы помочь другим организациям сделать то же самое.

Google также объявила о запуске инициатив по киберзащите, которые помогают улучшить кибербезопасность. Одной из таких инициатив является SAIF – Secure AI Framework, которую Google использовала в процессе разработки программного обеспечения.

SAIF — это концептуальная основа, целью которой является защита систем искусственного интеллекта от угроз и атак. Его можно использовать для борьбы с такими рисками, как кража конкретной модели ИИ, отравление данных с помощью генеративных результатов ИИ или вредоносный ввод посредством быстрого внедрения. SAIF также эффективен для мониторинга входных и выходных данных для обнаружения угроз и защиты от атак путем автоматизации защиты.

Также Google намерен выпустить Magika — инструмент кибербезопасности для определения типов файлов с целью обнаружения вредоносного ПО. Google успешно использовал этот инструмент для защиты своих продуктов, таких как Google Диск, Gmail и Безопасный просмотр.

PayPal

PayPal — это международная платежная платформа, которая упрощает транзакции для продавцов и покупателей. Для реализации мер кибербезопасности PayPal обучает передовые модели машинного обучения (ML) обнаружению мошеннической деятельности в режиме реального времени.

Обычно сеть PayPal предоставляет огромный объем данных о транзакциях, на которых ИИ может учиться. Результаты модели машинного обучения затем можно использовать для улучшения систем аутентификации и выявления мошеннических действий. Модель продолжает учиться и адаптироваться по мере роста набора данных PayPal.

ЭД&Ф Мэн Холдингс

ED&F — трейдер сырьевых товаров, который успешно использовал генеративный искусственный интеллект для обнаружения угроз. Они добились этого с помощью Cognito, платформы обнаружения угроз с искусственным интеллектом от Vectra.

ED&F предоставила подробную информацию о своей сетевой активности, включая связь между устройствами, передачу данных и действия пользователей. Затем Cognito использует эти данные для выявления уязвимостей и подозрительного поведения в режиме реального времени.

По словам Кармело Галло, менеджера по кибербезопасности ED&F, Cognito сыграла ключевую роль в выявлении рискованного поведения сотрудников, такого как несанкционированный удаленный доступ к данным и файлам. ED&F также обнаружила вредоносное ПО для управления и контроля, которое долгое время сохранялось в их системе.

Генеративный ИИ против традиционных методов кибербезопасности

Традиционные методы кибербезопасности основаны на системе, основанной на правилах, и ручном анализе.

Системы, основанные на правилах, обычно включают установку заранее определенных инструкций, которые сообщают системе, на что следует обращать внимание. Обычно это основано на уникальных шаблонах, проявляемых популярными вредоносными программами или нарушениями безопасности.

Когда эти правила отмечают подозрительную активность, вам обычно приходится вручную оценивать и устранять уязвимости. Традиционные методы кибербезопасности также во многом зависят от вмешательства человека и постоянных обновлений.

В отличие от традиционных методов, которые не справляются с большими базами данных, Gen AI может оценивать огромные объемы данных, что позволяет ему обнаруживать сложные закономерности, которые человек-аналитик может пропустить. Это также поможет вам более детально понять уязвимости.

Помимо анализа данных, генеративный ИИ может помочь в создании решений для потенциальных угроз, например, в создании безопасных паролей или разработке более эффективных протоколов безопасности. Итак, это более инициативно.

Хотя ИИ оказывается более эффективным инструментом для реализации более строгих мер кибербезопасности, вмешательство человека всегда будет необходимо. Таким образом, вы можете использовать сильные стороны обоих методов для достижения лучших результатов.

Например, вы можете использовать традиционные методы для проверки прогнозов ИИ и обеспечения большей точности. Вы также можете использовать рекомендации ИИ для улучшения настроек, которые вы настроили вручную.

7 новых тенденций в области искусственного интеллекта и кибербезопасности:

Генеративный искусственный интеллект в сфере кибербезопасности быстро развивается. Здесь мы исследуем несколько новых тенденций, которые могут сформировать будущее.

- Приоритизация ИИ-облака и безопасности . Мы наблюдаем интеграцию между системами ИИ и облачной инфраструктурой. Это должно облегчить обнаружение и предотвращение угроз в режиме реального времени.

- Расширение инструментов кибербезопасности на базе искусственного интеллекта . Поколение искусственного интеллекта будет изобретательным в создании поддельных систем или ловушек для обмана киберзлоумышленников. Способность этой технологии анализировать огромные объемы данных и выявлять закономерности также поможет создать новые решения в области кибербезопасности.

- Акцент на киберустойчивости : способность ИИ прогнозировать и исправлять уязвимости приведет к повышению устойчивости систем кибербезопасности. Эта технология поможет устранить слабые места до того, как злоумышленники смогут ими воспользоваться.

- Все более изощренные кибератаки, поддерживаемые поколением ИИ : поколение ИИ может облегчить масштабные кибератаки, что изначально было очень сложной задачей. Глубокие фейки также становятся все более эффективными, увеличивая риск социальной инженерии посредством персонализированных фишинговых кампаний.

- Использование автоматизации на базе искусственного интеллекта, позволяющей командам по кибербезопасности получать более качественную информацию : искусственный интеллект в конечном итоге возьмет на себя трудоемкие задачи, такие как просмотр журналов, а также обнаружение и анализ угроз. Это позволит экспертам сосредоточиться на более стратегических обязанностях, таких как принятие решений и разработка стратегий кибербезопасности.

Помимо улучшения кибербезопасности, эта тенденция показывает, что будущее требует сотрудничества между людьми-экспертами и системами искусственного интеллекта.

- Рост числа специализированных языковых моделей . Недавняя публикация Всемирного экономического форума предполагает, что большие языковые модели оказались весьма эффективными при обработке огромных объемов данных.

Однако такое широкое использование может не применяться к специализированным областям, таким как кибербезопасность. В результате мы, вероятно, увидим переход к более мелким и более специализированным языковым моделям, которые позволят командам получить доступ к более точной и действенной информации.

- Сосредоточьтесь на превентивном обнаружении угроз : мы видим Gen AI используется для повышения безопасности мобильных приложений, уделяя особое внимание упреждающему обнаружению угроз и реагированию в режиме реального времени.

Это одна из растущих тенденций искусственного интеллекта в мобильных приложениях. ИИ может наблюдать за поведением пользователей, чтобы обнаружить странности, которые могут указывать на нарушение безопасности. Некоторые примеры включают необычные попытки входа в систему или другую подозрительную активность.

Заглядывая в будущее искусственного интеллекта в сфере кибербезопасности, можно с уверенностью предсказать, что появятся более совершенные инструменты и платформы для борьбы с постоянно растущими угрозами, от которых страдает киберпространство.

Как внедрить ИИ поколения в кибербезопасность

Интеграция генеративного ИИ в вашу стратегию кибербезопасности — замечательный шаг в правильном направлении. Однако необходимо тщательное планирование и реализация.

Итак, на этом занятии мы рассмотрим несколько способов эффективного внедрения Gen AI в кибербезопасность:

- Начни с малого

Вместо того, чтобы пересматривать существующую систему безопасности, рассмотрите возможность начать с основ и со временем расширять ее.

Итак, сначала вам нужно определить варианты использования, которые более ценны для вашей организации. Это может быть исправление уязвимостей или улучшение реакции на атаки.

- Обучайте сотрудников и регулируйте использование ИИ

Затем обучите свою команду тому, как использовать Gen AI для обнаружения проблем и как интерпретировать результаты. Затем вы можете постепенно внедрять инструменты безопасности на основе искусственного интеллекта для таких задач, как обнаружение угроз в реальном времени и реагирование на инциденты.

Вы также хотите обновить свои политики и правила безопасности, чтобы способствовать использованию инструментов искусственного интеллекта. Например, покажите сотрудникам примеры того, что допустимо при использовании инструментов генеративного искусственного интеллекта в ваших мерах кибербезопасности.

Из-за возможности неправильного использования инструментов искусственного интеллекта и связанных с этим рисков безопасности рекомендуется принять меры для координации использования искусственного интеллекта поколения в вашей организации. Например, вы можете ограничить использование только инструментами, проверенными и одобренными вашим ИТ-отделом.

- Выберите правильную технологию искусственного интеллекта

Существуют различные технологии искусственного интеллекта, которые вы можете использовать в своей стратегии кибербезопасности. Вот некоторые примеры:

Машинное обучение (ML) , которое использует алгоритмы для обучения на основе данных и составления прогнозов. Это полезно, если вы хотите обнаруживать угрозы и прогнозировать уязвимости.

Обработка естественного языка (НЛП) – фокусируется на понимании человеческого языка и манипулировании им. Полезно для процессов обеспечения безопасности, таких как анализ электронной почты или журналов безопасности, а также автоматизация реагирования на инциденты.

Кроме того, у нас есть системы обнаружения аномалий (ADS) , которые выявляют отклонения от стандартных шаблонов данных. ADS может обнаруживать сетевые вторжения, необычное поведение пользователей или активность вредоносных программ.

Целесообразно использовать технологию, которая решает конкретные проблемы безопасности, на которые вы нацелены.

- Используйте высококачественные данные

Инвестируйте в сбор и подготовку высококачественных и объективных данных, соответствующих вашим потребностям. В идеале это должны быть данные, соответствующие вашему сценарию использования и ландшафту угроз. Вы также хотите использовать разнообразные варианты данных, чтобы избежать систематической ошибки в выходных данных.

Рассмотрите возможность использования смоделированных данных вместо любой информации, которая может быть конфиденциальной. Обязательно обеспечьте безопасность хранения данных и средств контроля доступа для защиты конфиденциальной информации.

- Мониторинг и адаптация

Наконец, киберугрозы постоянно развиваются, поэтому ваша реализация GenAI также должна адаптироваться. Регулярно отслеживайте его производительность, обновляйте данные и модели и решайте любые возникающие проблемы.

Вы также можете сотрудничать с компанией, которая предоставляет услуги генеративного искусственного интеллекта для более эффективной реализации.

Нормативные и этические соображения

Растущее использование генов искусственного интеллекта требует внедрения правил, особенно в том, что касается этического принятия и выявления рисков. В идеале использование инструментов ИИ должно соответствовать правилам, установленным существующими регулирующими органами.

Такие законы, как GDPR (Общие правила защиты данных) и CCPA (Калифорнийский закон о конфиденциальности потребителей), установили стандарты конфиденциальности пользователей и защиты данных с помощью моделей кибербезопасности на основе искусственного интеллекта. Некоторые из них включают в себя:

- Собирайте и используйте только те данные, которые необходимы для конкретных и законных целей.

- Внедрите эффективные меры для защиты пользовательских данных.

- Предоставляйте информацию, которая поможет пользователям понять, как работают платформы искусственного интеллекта.

В одном исследовании также освещаются хорошо известные принципы, определяющие этическое внедрение ИИ. К ним относятся справедливость, прозрачность, подотчетность и надежность.

Справедливость – это предполагает обеспечение того, чтобы технология ИИ была справедливой и беспристрастной, особенно в отношении данных, на которых ИИ обучается. Это предполагает принятие мер по предотвращению любой формы дискриминации по таким факторам, как пол, возраст или социально-экономический статус.

Прозрачность и подотчетность требуют, чтобы поставщики платформ ИИ честно рассказывали о том, как работают системы ИИ. Они также должны нести ответственность за ошибки или проблемы, возникающие при использовании этих решений ИИ. Пользователи должны понимать, как их данные используются или хранятся.

Надежность подчеркивает необходимость создания надежных, безопасных и устойчивых к ошибкам систем искусственного интеллекта.

Существует также дизайн, ориентированный на человека, который способствует созданию систем искусственного интеллекта с учетом потребностей человека, а не сосредоточения внимания на технических деталях.

Мнения и прогнозы экспертов по использованию искусственного интеллекта для кибербезопасности

Итак, что же эксперты по кибербезопасности говорят о генеративном искусственном интеллекте в кибербезопасности?

Кунле Фадейи, член Технологического совета Forbes, согласен с тем, что искусственный интеллект совершает революцию в кибербезопасности, предоставляя упреждающие меры безопасности, которые могут помочь защититься от кибератак. Он называет это «задуманной безопасностью», которая обычно предполагает выявление и устранение брешей в безопасности, которыми могут попытаться воспользоваться киберпреступники.

Майк Либерман, технический директор и соучредитель Kusari, также прогнозирует, что ИИ поможет компаниям решать проблемы кибербезопасности, позволяя им обнаруживать плохие шаблоны безопасности в заданном коде или конфигурации. По словам Либермана, ИИ будет обеспечивать руководство в более сложных сценариях безопасности. Однако инструменты ИИ следует использовать только в качестве сигналов, а не для принятия решений.

Наконец, эксперт по кибербезопасности и генеральный директор Logpoint Джеспер Зерланг рекомендует организациям включать стратегии кибербезопасности в общие бизнес-цели. Это связано с тем, что риск кибератак, вероятно, увеличится, поскольку предприятия полагаются на цифровые процессы.

Включение кибербезопасности в бизнес-цели позволит организациям активно защищать ценные бизнес-активы и укреплять доверие заинтересованных сторон.

В заключение: как использовать ИИ поколения для кибербезопасности

По мере развития технологий угрозы и потенциальные атаки продолжают насыщать цифровое пространство. Это приводит к необходимости более совершенных подходов к выявлению и защите предприятий и пользователей от вредоносной кибердеятельности. Это подводит нас к необходимости дополнить традиционные меры безопасности методами генеративного искусственного интеллекта.

Сегодня мы увидели, как Gen AI обеспечивает более быстрый и эффективный способ выявления угроз, прогнозирования проблем безопасности и автоматизации реагирования на инциденты. Мы также изучили эффективные способы внедрения искусственного интеллекта Gen в ваши меры кибербезопасности. Они включают в себя определение конкретных вариантов использования, выбор правильной технологии, обучение ваших сотрудников и постоянный мониторинг ваших мер безопасности.

Вам также следует принять к сведению этические соображения при использовании искусственного интеллекта для кибербезопасности и возникающие тенденции в области кибербезопасности с использованием искусственного интеллекта.

В целом, мы надеемся, что это руководство показало вам, как искусственный интеллект может помочь улучшить вашу безопасность. Используйте эту информацию для внедрения надежной системы кибербезопасности в вашей организации.