Ce este Robots.txt: definiție, importanță și exemple

Publicat: 2022-07-11S-ar putea să fi auzit despre Google care a accesat cu crawlere site-ul nostru și paginile de pe Internet și apoi le afișează pe pagina cu rezultatele căutării.

Ei bine, robots.txt îi spune Google ce site-uri își urmează algoritmii și care nu. În acest ghid, am împărtășit tot ce trebuie să știți despre robots.txt, exemple și cum funcționează.

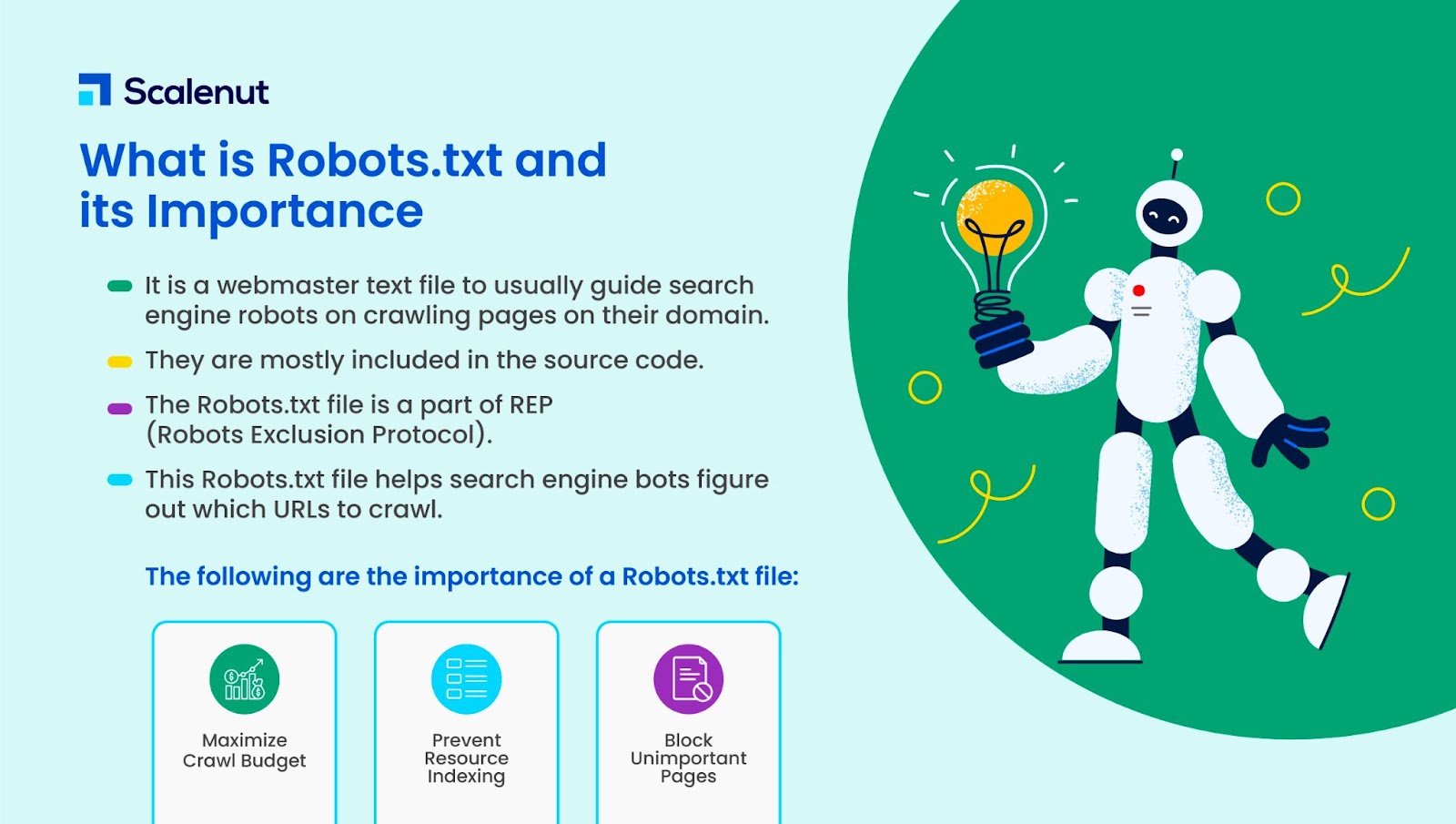

Ce este Robots.txt?

Robots.txt este fișierul text al unui webmaster pentru a ghida roboții web (de obicei roboții motoarelor de căutare) pe paginile accesate cu crawlere de pe domeniul lor. Un fișier robots.txt, cu alte cuvinte, este un set de instrucțiuni pentru roboți.

Robots.txt sunt incluse în codul sursă pentru majoritatea site-urilor web.

Fișierul robots.txt face parte din Robots Exclusion Protocol (REP). Acesta definește modul în care roboții accesează cu crawlere paginile web, găsesc și indexează conținutul și oferă acele informații persoanelor care le doresc.

Robots.txt îi ajută pe roboții motoarelor de căutare să înțeleagă ce adrese URL ar trebui să acceseze cu crawlere pe site-ul dvs.

De ce este important Robots.txt?

Există în principal trei motive pentru care vă poate ajuta.txt:

- Maximizați bugetul de accesare cu crawlere: bugetul de accesare cu crawlere este numărul de pagini pe care roboții Google le indexează într-un interval de timp. Robots.txt vă poate ajuta să blocați paginile de conținut neimportante sau duplicate și să vă concentrați numai pe paginile care sunt importante pentru dvs., maximizând bugetul de accesare cu crawlere și sporind vizibilitatea.

- Evitați indexarea resurselor: Robots.txt poate indexa sau de-indexa resursele, cum ar fi PDF-uri sau imagini. Astfel, paginile noindex sau protejate prin parolă pot fi folosite pentru a bloca paginile sau resursele. Puteți verifica paginile indexate folosind consola de căutare Google și puteți vedea dacă roboții accesează cu crawlere paginile pe care doriți să le indexați.

- Blocați pagini neimportante: există unele pagini pe site-ul dvs. pe care nu doriți să le afișați în rezultatele căutării Google. Acestea ar putea fi pagina de conectare sau versiunea în etape/tester a site-ului dvs. Folosind robots.txt, puteți bloca aceste pagini și vă puteți concentra numai pe paginile care contează.

Exemple Robots.txt

Câteva exemple de robots.txt sunt:

Agent utilizator: Googlebot

Nu permiteți: /nogooglebot/

Agent utilizator: *

Permite: /

Harta site-ului: http://www.example.com/sitemap.xml

În mod similar, pentru motorul de căutare Bing, merge:

Agent utilizator: Bingbot

Nu permiteți: /example-subfolder/blocked-page.html

Sintaxa ajută crawler-ul să evite accesarea cu crawlere a unei anumite pagini.

Este demn de remarcat faptul că fiecare subdomeniu are nevoie de propriul fișier robots.txt.

De exemplu, în timp ce www.cloudflare.com are propriul fișier, toate subdomeniile Cloudflare (blog.cloudflare.com, community.cloudflare.com și așa mai departe) au nevoie și de al lor.

Cum funcționează un fișier Robots.txt?

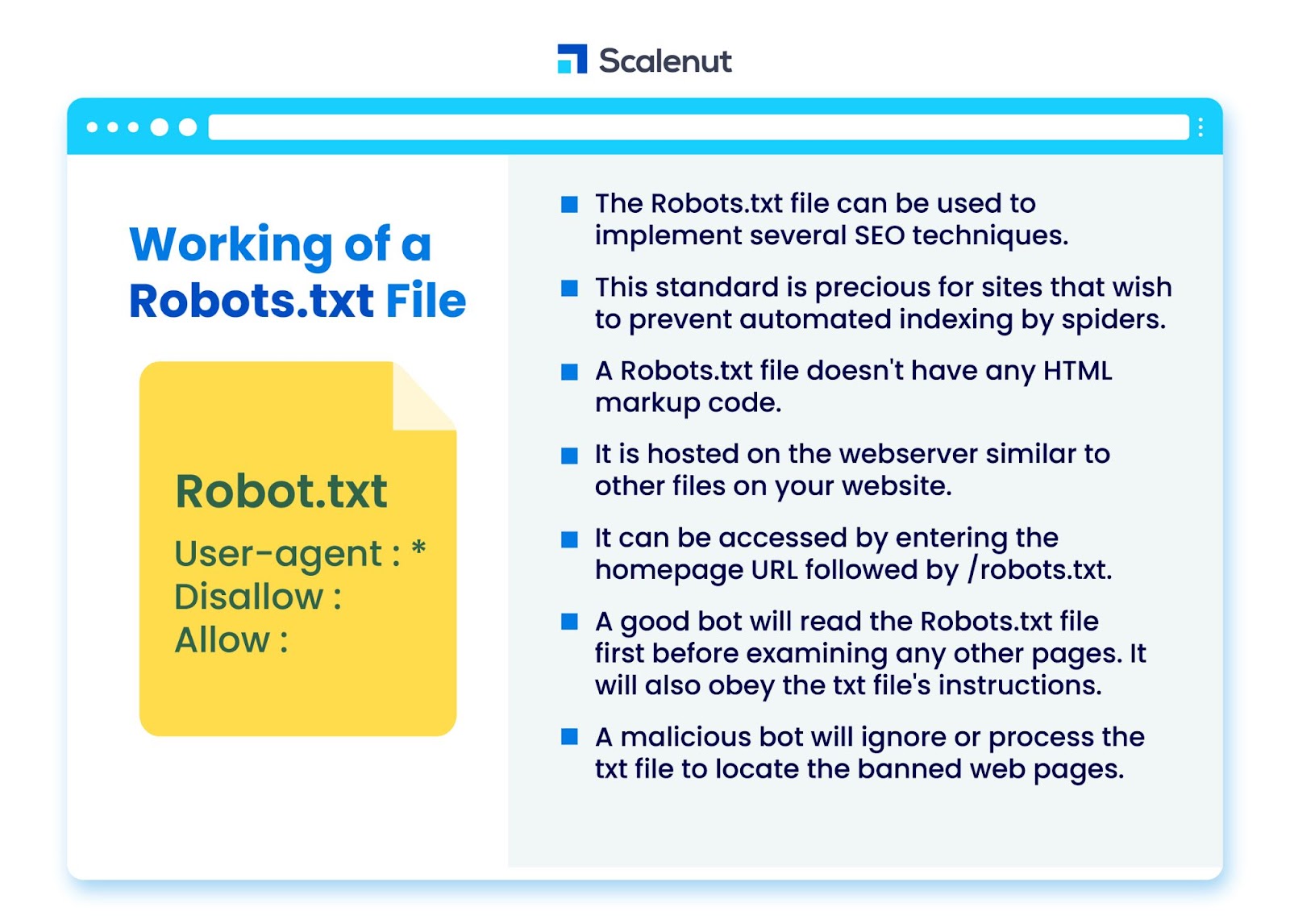

Fișierul robots.txt poate fi folosit pentru a implementa mai multe tehnici de optimizare pentru motoarele de căutare (SEO), cum ar fi paginile neindexate sau robots txt interzice toate sau anumite părți ale site-ului prin programe bot.

Standardul este deosebit de valoros pentru site-urile care doresc să împiedice păianjenii să-și indexeze conținutul prin procese automate, cum ar fi software-ul de căutare și clasare a paginilor folosind crawlerele web automate.

Un robots.txt este un fișier fără cod de markup HTML. Este găzduit pe serverul web, la fel ca și alte fișiere de pe site-ul dvs.

Poate fi accesat introducând adresa URL a paginii de pornire urmată de /robots.txt. Un exemplu general este https://www.xyz.com/robots.txt.

Deoarece fișierul nu este legat în altă parte de pe site, este puțin probabil ca vizitatorii să-l întâlnească, dar majoritatea robotilor de crawler web îl vor căuta înainte de a indexa restul site-ului.

Un bot bun, cum ar fi un crawler Google sau un bot de feed de știri, va citi mai întâi fișierul robots.txt înainte de a examina orice alte pagini de pe un site și va respecta instrucțiunile.

Un bot rău intenționat fie va ignora, fie va procesa fișierul robots.txt pentru a găsi paginile web interzise.

Blocarea Robots.txt

Robots.txt constă în instrucțiuni pentru a informa roboții cu privire la orice reguli de blocare de pe un site web care poate fi căutat altfel, indexat de Googlebot, care au scopul de a împiedica crawler-ul să acceseze pagini cu anumit conținut.

Nu afectează utilizatorii obișnuiți sau roboții care doar navighează pe site-uri fără a le accesa cu crawlere.

De-a lungul timpului, site-urile web au blocat aplicațiile mobile, JavaScript și alte părți ale site-ului lor folosind această metodă, permițând în același timp unele elemente precum imaginile.

Ce protocoale sunt folosite într-un fișier Robots.txt?

Un protocol este un format de transmitere a instrucțiunilor sau comenzilor în rețea. Fișierele Robots.txt folosesc o varietate de protocoale. Protocolul principal este cunoscut sub numele de Robots Exclusion Protocol.

Îi indică pe roboți ce site-uri web și resurse să evite.

Protocolul sitemaps este un alt protocol care este utilizat pentru fișierele robots.txt. Acesta poate fi considerat ca un protocol pentru includerea roboților.

Sitemaps-urile informează crawlerele web despre paginile pe care le pot accesa. Acest lucru vă ajută să vă asigurați că un robot cu crawler nu trece cu vederea nicio pagină crucială.

Ce este Sitemap?

Harta site-ului este un fișier XML care descrie informațiile utilizate de crawlerele web pentru a afișa paginile site-ului dvs. Harta site-ului listează toate adresele URL de pe site-ul dvs. web, inclusiv titlurile și descrierile acestora, precum și alte informații conexe.

Acest document ajută motoarele de căutare să indexeze corect aceste articole, astfel încât vizitatorii să le poată găsi rapid folosind motoarele de căutare sau alte sisteme de navigare.

Ce este un User-Agent?

User-agent user-agent: *disallow: /nogooglebot/ user-agent user-agent: Googlebot

Nu permiteți toate regulile robots.txt, indiferent de user-agent. Acest lucru va împiedica orice crawler web să acceseze site-ul dvs. Acesta este cel mai adesea folosit de site-urile web sensibile la preocupările privind confidențialitatea (și, prin urmare, nu doresc ca datele utilizatorilor lor să fie expuse).

Numele obișnuite ale agenților utilizator bot pentru motorul de căutare includ:

Google :

- Googlebot

- Googlebot-Imagine (pentru imagini)

- Googlebot-News (pentru știri)

- Googlebot-Video (pentru video)

Bing:

- Bingbot

- MSNBot-Media (pentru imagini și video)

Baidu:

- Baiduspider

Ce este un fișier .txt?

TXT este o extensie de fișier text acceptată de multe editoare de text.

Nu există o astfel de definiție statică a unui fișier text, în timp ce există mai multe formate populare, inclusiv ASCII (un format multiplatform) și ANSI (utilizat pe platformele DOS și Windows). TXT este o abreviere pentru TeXT. Text/plain este tipul MIME.

În fișierul text robots.txt, fiecare regulă specifică un model de adrese URL care pot fi accesate de către toate crawlerele sau numai crawlerele specificate.

Fiecare linie trebuie să înceapă cu un singur două puncte (:) și să conțină 1–3 rânduri, ignorând liniile goale. Fiecare linie este interpretată ca un nume de fișier, care poate fi absolut sau relativ la directorul în care este plasat.

Roboții web sunt la fel cu Robots.txt?

Este posibil ca unele motoare de căutare să nu accepte directivele txt.

Instrucțiunile din fișierele robots.txt nu pot obliga crawlerele să vă viziteze site-ul; depinde de crawler să le urmeze. În schimb, Googlebot și alți crawler-uri web bine-cunoscute urmează regulile dintr-un fișier robots.txt.

Cum se implementează Robots.txt?

Un fișier robots.txt poate fi implementat în aproape orice editor de text. Notepad, TextEdit, vi și emacs, de exemplu, toate pot genera fișiere robots.txt legitime.

Următoarele sunt regulile de urmat robots.txt:

- Numele fișierului ar trebui să fie robots.txt.

- Un fișier robots.txt poate fi utilizat pentru a restricționa accesul la subdomenii (de exemplu, https://website.example.com/robots.txt) sau la porturi non-standard.

- Un fișier robots.txt trebuie să fie în format UTF-8 (care include ASCII). Google poate respinge caractere care nu se află în intervalul UTF-8, potențial invalidând reglementările robots.txt.

- Fișierul robots.txt se găsește de obicei în directorul rădăcină al gazdei site-ului web la care este aplicat. Pentru a activa accesarea cu crawlere pe toate adresele URL, cum ar fi https://www.example.com/, fișierul robots.txt trebuie găsit la https://www.example.com/robots.txt. Nu poate fi plasat într-un subdirector (de exemplu, https://example.com/pages/robots.txt).

Limitările unui fișier Robots.txt

Iată limitările fișierului robots.txt:

- Toate motoarele de căutare nu acceptă Robots.txt: fișierele Robots.txt nu pot obliga crawlerele să vă viziteze site-ul; depinde de crawler să le urmeze. În timp ce Googlebot și alți crawler-uri web de încredere vor urma instrucțiunile dintr-un fișier robots.txt, alți crawler-uri s-ar putea să nu.

- Diferiții crawler interpretează diferit sintaxa: deși paianjenii web reputați aderă la directivele dintr-un fișier robots.txt, fiecare crawler poate interpreta directivele în mod diferit.

- O pagină interzisă poate fi indexată dacă este legată de alte pagini: deși Google nu va accesa cu crawlere și nu va indexa conținutul restricționat de un fișier robots.txt, poate găsi și indexa o adresă URL interzisă dacă este legată din alte locații de pe internet.

Drept urmare, adresa URL și, probabil, alte informații disponibile public, cum ar fi textul ancora în linkurile către pagină, pot apărea în continuare în rezultatele căutării Google.

FAQ

Î1. Unde merge robots.txt pe un site?

Răspuns: Un fișier robots.txt este de obicei plasat în directorul rădăcină al site-ului dvs. web, dar poate fi oriunde pe site-ul dvs. la care doriți să restricționați accesul.

Q2. Este necesar un fișier robots.txt?

Răspuns: Răspunsul scurt este nu. Un fișier robots.txt nu este necesar pentru un site web. Dacă un robot vă vizitează site-ul web și nu are un fișier robots.txt, va accesa cu crawlere și va indexa paginile așa cum ar fi în mod normal. Fișierul .txt este necesar doar dacă doriți mai mult control asupra a ceea ce este accesat cu crawlere.

Q3. Este robots.txt sigur?

Răspuns: Fișierul robots.txt nu reprezintă un risc de securitate în sine, iar utilizarea sa corectă poate reprezenta o bună practică din motive care nu sunt de securitate. Nu trebuie să vă așteptați ca toți roboții web să urmeze instrucțiunile din fișier.

Î4. Este ilegal să accesați robots.txt?

Răspuns: Un fișier robots.txt este o licență care este implicită de proprietarul site-ului web. Dacă cunoașteți fișierul robots.txt, atunci continuarea răzuirii site-ului lor fără permisiune poate fi considerată acces neautorizat sau hacking.

Î5. Ce este întârzierea accesării cu crawlere în robots txt?

Răspuns: Directiva crawl-delay este o modalitate de a le spune crawlerilor să încetinească, astfel încât serverul web să nu fie supraîncărcat.

Concluzie

Robots.txt este un fișier simplu care are multă putere. Dacă știi cum să-l folosești bine, poate ajuta SEO. Crearea tipului potrivit de robots.txt înseamnă că vă îmbunătățiți SEO și experiența utilizatorului.

Boții vor putea să vă prezinte conținutul în SERP-uri așa cum doriți să fie văzut dacă le permiteți să acceseze cu crawlere lucrurile corecte.

Dacă sunteți dispus să aflați mai multe despre SEO și factori importanți, consultați multe alte bloguri Scalenut.