Găsirea de oportunități CRO folosind crawlerele SEO

Publicat: 2022-08-12

Oamenii sunt încă necesari, dar, băiete, pot ajuta crawlerii

Cu cât fac CRO mai mult, cu atât îmi dau seama de importanța diferitelor tipuri de cercetare. Timp de mulți ani, am fost greoi (și încă sunt într-o oarecare măsură) în datele cantitative. Obținerea unei colectări de date curate și fiabile în configurații Google Analytics aproape perfecte. Asta va duce la cele mai bune programe CRO, nu? Cu siguranță te începe într-un loc grozav, dar este doar un început.

În această postare, voi împărtăși un flux de lucru cu rezultatele căutării interne pe care l-am dezvoltat de-a lungul anilor din zilele mele de analiză și SEO, care vă va ajuta să vă accelerați cercetarea în domeniile pe care programul dvs. CRO ar trebui să se concentreze.

Faceți cunoștință cu Screaming Frog.

Rezultatele căutării (Căutare internă pe site) Deep Dive

Mi-ar fi ușor să vă arăt mapări ale intențiilor (atât pentru intenția de căutare, cât și pentru intenția SERP) pentru a afișa când lipsește relevanța (atât pentru cuvintele cheie, cât și pentru tipurile de pagină). Poate că asta va veni mai târziu, dar cred că s-a făcut destul de mult.

În schimb, vreau să vorbesc despre ceva și mai aproape de conversie, rezultatele căutării interne pe site-ul tău.

Căutarea pe site este unul dintre cele mai mari semnale că utilizatorii dvs. doresc cu adevărat ceva.

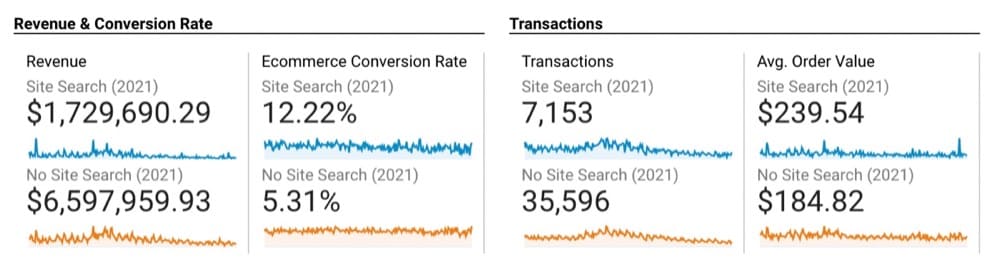

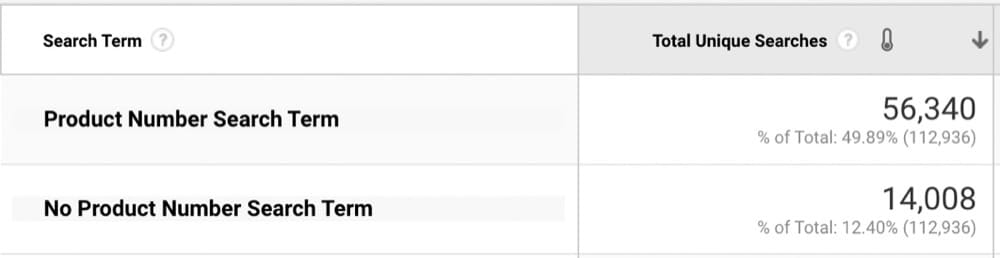

Putem vedea diferența aici de pe acest site de aprovizionare pentru piscine de la utilizatorii care caută față de cei care nu fac:

Cu 130% mai multe conversii atunci când utilizatorii caută nu este prea surprinzător, dar arată puterea de a oferi cea mai bună experiență de căutare posibilă.

Acum să cercetăm termenii de căutare pentru a ne asigura că experiența este optimizată.

Prima mea recomandare este să descărcați toți termenii de căutare (ultimele 12 luni au, de obicei, cel mai bun sens, dacă nu sunteți foarte sezonier).

Apoi, rulați-le printr-un instrument de cluster pentru a înțelege modul în care oamenii caută la un nivel superior (acest lucru vă va oferi o direcție mai bună decât să parcurgeți mii de KW).

(Înainte de grupare, asigurați-vă că standardizați și curățați KW-urile pentru greșeli de ortografie și/sau tratarea diferită a cazurilor.)

Utilizați =trim(clean(lower(cell-number))) pentru formula dvs. pentru a le curăța în Foi de calcul Google.

Acum, copiați și inserați-le în Keyword Grouper Pro de la MarketBold (acesta este gratuit).

Pentru a forma un grup, vei estima câte pe baza că folosesc 1.000 de cuvinte cheie pentru a începe, așa că dacă ghicesc că 10 per grup îmi va oferi cantitatea potrivită de grupuri aici. Nu știi niciodată cu adevărat câte grupuri vrei, dar ar trebui să ai destule pentru a fi reprezentativ pentru utilizatorii tăi care caută în funcție de numărul pe care îl încarci (vei deveni mai bun la asta odată cu folosirea).

prin GIPHY

Văzând cuvintele cheie grupate, le-aș grupa în câteva categorii diferite, în funcție de modul în care oamenii caută:

- Numerele piesei (nu primește mult mai mult fundul pâlniei decât atât)

- Nume de marcă

- Tipuri de categorii largi

Acum, pot fi mai vizat cu termenii de căutare GA pentru a știu ce să caut.

În acest scenariu, deoarece utilizatorii care caută numere de produse au o intenție mare de cumpărare, aș dori să încep de acolo (și nu doar să mă uit la primele rezultate ale căutării „x”). Cu niște Regex simple pentru a izola doar numerele de produs (mai mult de un număr în termenii de căutare), aflăm că 80% dintre căutări conțin un număr de produs

Acum vom dori să exportăm rezultatele căutării noastre din Google Analytics. Dacă aveți o mulțime de termeni de căutare, poate fi necesar să utilizați API-ul sau un instrument precum suplimentul Google Analytics Google Sheets (este gratuit).

Inspectarea rezultatelor căutării (ce căutăm?)

Desigur, aici am început prima dată să mă asigur că nu cobor într-o groapă de iepure. Dar făcând asta de prea multe ori ca să le număr acum, știam ce caut

„Zonele cu probleme” de aici vor varia în funcție de platforma și furnizorul de căutare pe care îl utilizați. Pentru acest scenariu, mă interesează în principal:

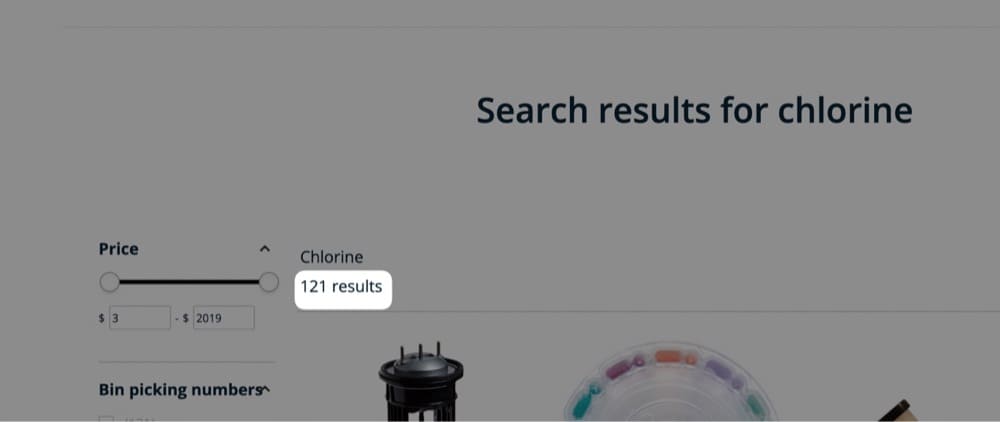

- numărul de rezultate afișate

Afișat aici:

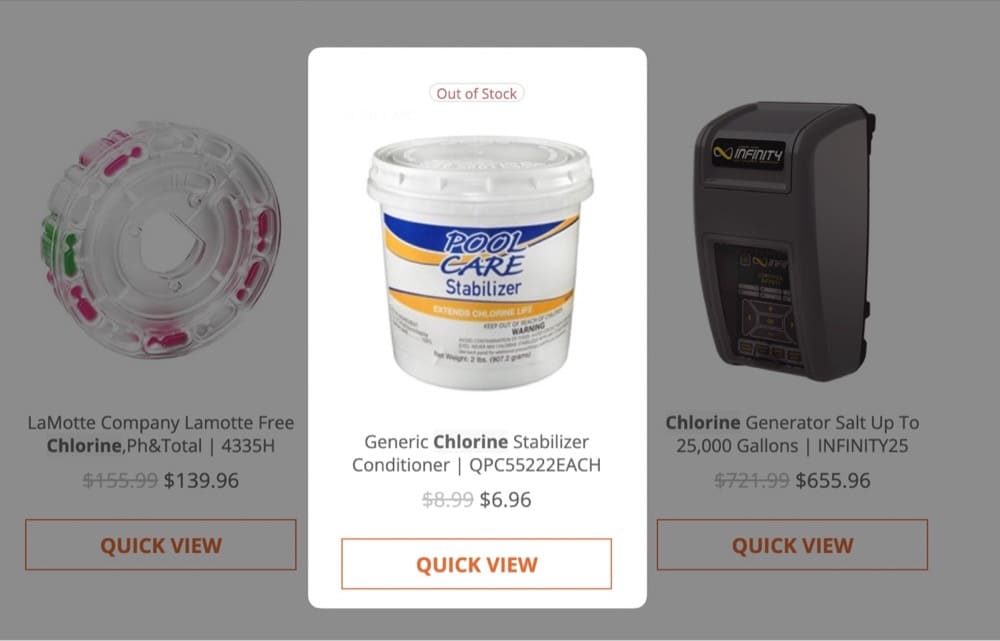

- Articole care se afișează epuizate

Afișat aici:

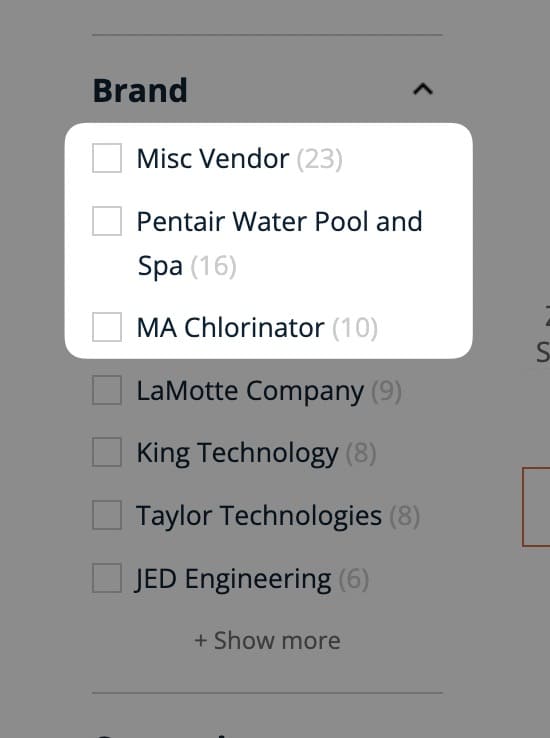

- Primele 3 categorii în care se încadrează rezultatele căutării (acest lucru s-ar putea realiza cu o CĂUTARE VOLTARĂ mai târziu, dar aș prefera să fac acest lucru aici/în același timp)

Afișat aici:

Următoarele întrebări mă ajută să înțeleg datele:

- Afișăm cantitatea potrivită de rezultate de căutare pentru aceste căutări de numere de produs?

Cu aproape toate celelalte tipuri de căutări, a avea un singur rezultat ar fi mai puțin decât optim, dar pe baza acestor căutări, este logic să afișați doar un rezultat. Dar destul de important că vedem acel rezultat, totuși!

- Ce rezultate de căutare au returnat cel mai mult din produsele blocate?

De asemenea, ceva mai relevant pentru căutările care returnează o mulțime de rezultate.

- Ce categorii primesc cel mai mult...

- Căutări de produse?

- Ai cele mai epuizate rezultate din stoc?

- S-a returnat cea mai mică cantitate de rezultate (care, mai mult decât probabil, va duce la ieșiri mai mari)?

Utilizarea Screaming Frog pentru a imita rezultatele căutării

Acum vine partea distractivă - folosind Screaming Frog!

Nu voi acoperi niciun aspect al modului de utilizare a Screaming Frog. Este un instrument foarte complex și, deși îl folosesc de aproape un deceniu, probabil că aș putea face mai multe cu el.

Au ghiduri grozave pe site-ul lor (care este și locul în care îl descărcați): https://www.screamingfrog.co.uk/seo-spider/user-guide/ (costul este de 151,77 USD pe an și este incredibil de sub preț pentru ce poate face.)

Ultima bucată „atenție la detalii” este să te uiți la adresa URL a site-ului tău după ce ai căutat pentru a vedea modelul:

Acest lucru este important de știut, deoarece vom adăuga termenul de căutare din Google Analytics la adresele URL ale site-ului pentru a se potrivi cu acest model. Vom imita un utilizator care caută acest lucru cu crawler-ul și va extrage zonele de interes pe care le-am acoperit deja (rezultate de căutare, stoc epuizat și categorii).

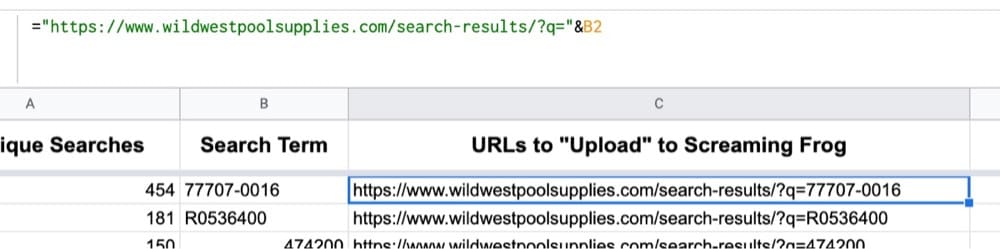

- Luați totul înainte de termenul de căutare din adresa URL:

- Combinați acel șir URL cu termenul de căutare:

Notă: dacă aveți spații în termenii de căutare, va trebui să utilizați Regex sau JS avansat pentru a adăuga un %20 în adresa URL. Eu personal folosesc TextSoap pentru aceste manipulări.

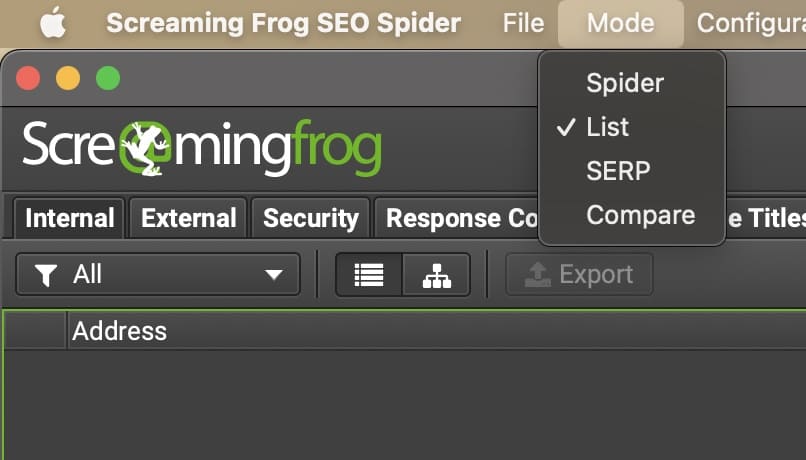

- Deschideți Screaming Frog și treceți la modul Listă:

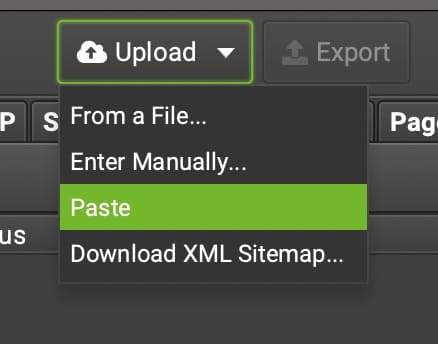

- Alegeți cum doriți să încărcați lista de adrese URL (nu le lipiți dacă aveți peste 10.000, încărcarea va dura o veșnicie):

- Înainte de a rula crawler-ul, veți dori să găsiți o modalitate de a extrage elementele necesare de pe site.

Voi afișa rezultatele căutării aici în SF și restul puteți alege cum doriți să extrageți.

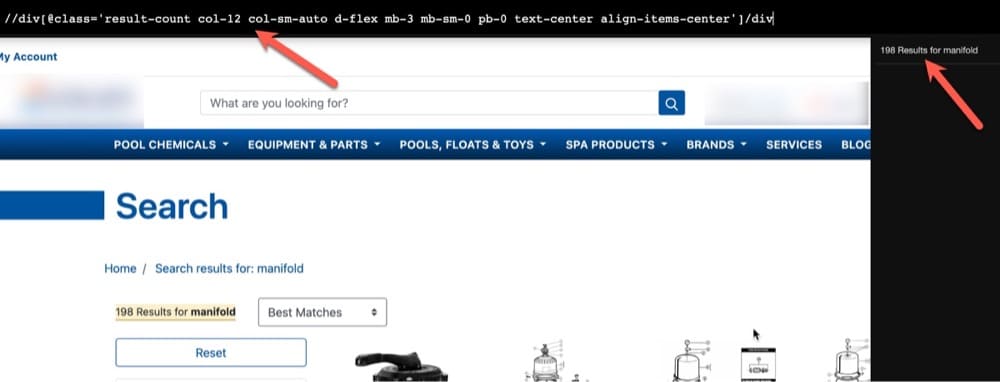

1. Veți dori să extrageți numărul de rezultate ale căutării pentru a afla câte rezultate revin atunci când acest cuvânt cheie este căutat. Pentru a face asta, vom folosi XPATH (limbajul ales de mine, de obicei, în SF).

2. De obicei, îmi place să încerc mai întâi cel mai simplu mod posibil, apoi să inspectez elementul doar când este nevoie. #WorkSmarter cu extensia Chrome XPather.

GIPHY

3. Acest lucru îmi oferă XPATH-ul de care am nevoie, împreună cu o previzualizare a „ieșirii” a ceea ce voi vedea mai mult ca sigur în Screaming Frog.

4. Notă: nu îmi voi face griji doar pentru extragerea numărului de rezultate. Aceasta este o curățare de 5 secunde în Foi de calcul Google.

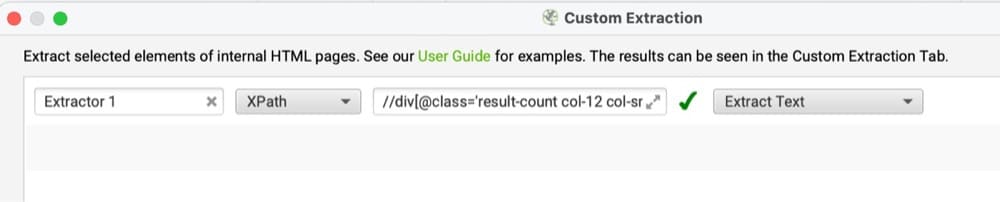

5. Acum pot introduce acest lucru în SF în secțiunea Configurare → Personalizat → Extracție, văzută aici:

6. Voi schimba rezultatul în Extract Text pentru a-l curăța mai mult și a exclude HTML inutil.

7. După ce faceți clic pe OK, veți putea accesa cu crawlere adresele URL specificate pe care le-ați încărcat anterior (sau poate nu încă). (Din nou, motivul pentru care am încărcat adrese URL a fost pentru a evita accesarea cu crawlere a întregului site și pentru a accesa cu crawlere numai termenii de căutare care ne interesează.)

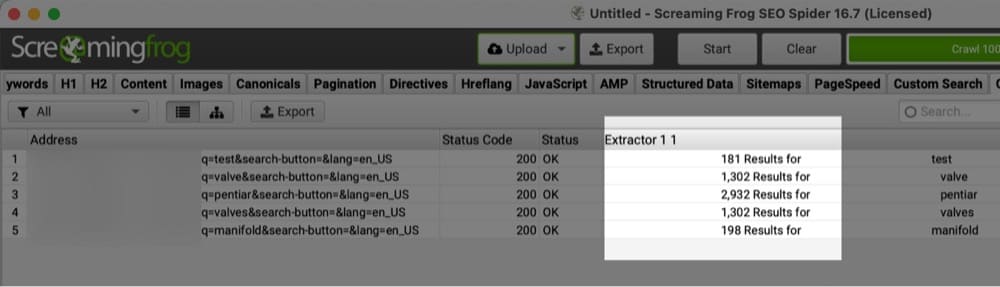

8. Iată un eșantion de rezultat pentru câteva adrese URL și numărul de rezultate ale căutării pe care le-au returnat termenii de căutare:

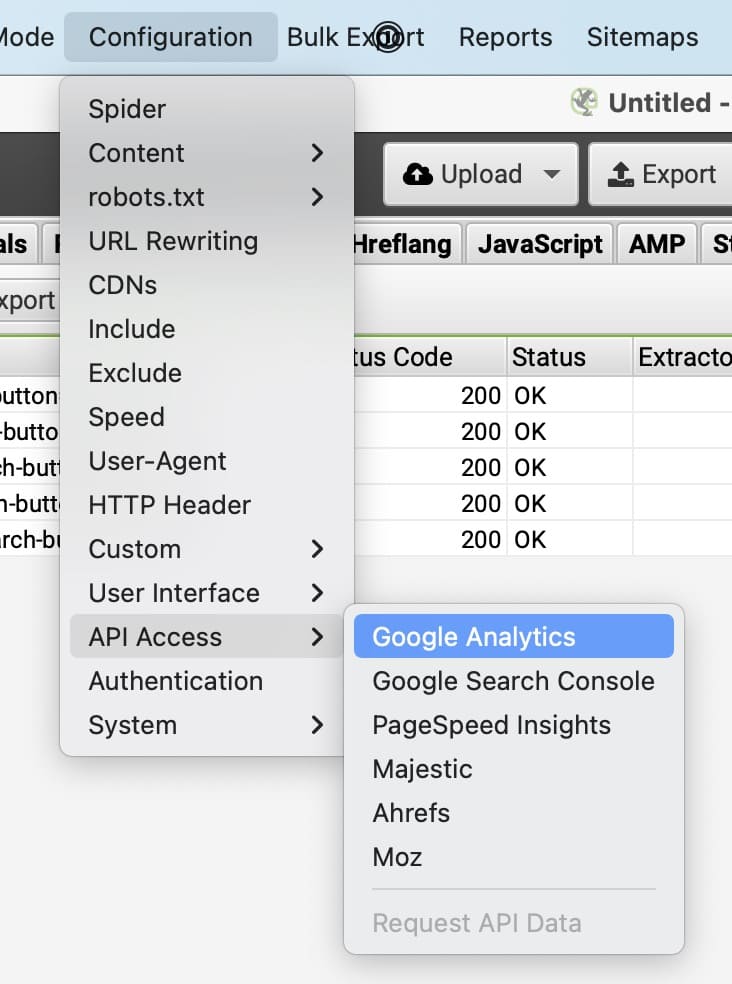

9. În continuare, probabil că ați dori să știți cât de des au loc acele căutări. Aici puteți conecta Google Analytics pentru a vedea numărul de afișări de pagină pentru adresele URL corespunzătoare.

10. Personal, consider că este util aici să creez un „raport” dintre paginile de căutare ridicate și numărul scăzut de rezultate returnate.

De asemenea, există o corelație între un număr scăzut de rezultate și ieșiri mari pe acele pagini? (Văd că acest lucru se întâmplă atunci când există mai puțin de 10 rezultate, ceea ce ar însemna că rezultatele căutării nu par „pline”, deoarece majoritatea site-urilor nu au mai mult de 5 lățime pe rând.)

11. Alte puncte de date utile pe care le-ați putea folosi aici (pe baza modului în care sunt afișate rezultatele căutării și navigarea cu fațete):

Ce rezultate de căutare aduc cele mai epuizate rezultate din stoc? (Dacă nu puteți lua nicio măsură, cum ar fi să primiți notificări când produsul respectiv este în stoc, vă recomandăm să eliminați acest lucru din rezultatele căutării.)

Maparea termenilor de căutare înapoi la categorii (și subcategorii, dacă este relevant). Ajută la înțelegerea cererii de-a lungul timpului din partea utilizatorilor și alimentează o mulțime de perspective diferite – de la noi teste până la personalizarea cuvintelor cheie ambigue în modul în care funcționează sortarea rezultatelor.

Căutări cu numărul de produse, așa cum am arătat mai devreme. Majoritatea oamenilor nu vor efectua căutări multiple dacă produsul lor # nu returnează nimic. S-ar putea să nu fie o soluție ușoară imediat, dar ați putea afișa o fereastră pop-up cu intenția de ieșire pentru a primi notificări când produsul respectiv este din nou în stoc.

Utilizați adresa URL ca variabilă pentru a transmite sub orice formă utilizați pentru furnizorul dvs. de pop-up, astfel încât să știți ce produs urmărește.

Aș putea continua aici, dar sperăm că aceste exemple au ajutat să pictați o imagine mai bună a modului în care vă puteți analiza propriile rezultate de căutare pentru o perspectivă mai bună asupra tipului de experiență pe care o oferă utilizatorilor.

Notă: S-ar putea să fi observat că am schimbat site-urile pe care le extrag de aici. Când am început această postare pe blog, primul site folosea un alt furnizor de căutare, apoi s-a schimbat și am vrut să arăt un exemplu mai bun bazat pe XPATH vs. scufundarea în alte metode (aceasta este de obicei cea mai fiabilă metodă, împreună cu CSS). selectoare).

A doua notă: filtrați adresa IP a crawlerului dvs. în Google Analytics, astfel încât să nu vă numărați în numărul de afișări de pagină. Dacă declanșați eticheta de afișare a paginii la 2-3 secunde după ce se încarcă fereastra, nu trebuie să vă faceți griji cu privire la traficul cu crawler sau bot ca acesta (și felicitări pentru dvs., acesta este un adevăr mult mai util al datelor).

Scalare + zone de automatizare a acestui proces

Unii dintre voi ar putea spune: „Ei bine, acest lucru nu este automat, nu vreau să fac asta manual.”

Acesta este un punct total valabil. Personal, nu mă deranjează pentru că majoritatea clienților mei nu au milioane de rezultate de căutare returnate pentru a justifica acest lucru săptămânal (sau mai multe). Aceasta este de obicei o sarcină lunară sau trimestrială pe care o fac împreună cu Google Analytics pentru a vedea dacă tendințele și modelele se schimbă.

Dacă sunteți mai tehnic, puteți rămâne cu Screaming Frog și puteți configura o soluție VPS pentru a rula crawleri automate în cloud, împingând rezultatele la Google BigQuery după finalizare. SF are un ghid frumos despre asta.

Există și alte soluții care sunt mai „la cheie” și cu siguranță mai puțin practice, cum ar fi ContentKing (le-am folosit în trecut), care permite și „alerte” dacă sunt atinse anumite praguri. (Gândiți-vă la căutări de numere de produs fără rezultate returnate = e-mail sau notificare Slack).

Alte zone de căutat cu un crawler SEO

Sperăm că acest lucru ți-a deschis puțin mai mult ochii asupra posibilităților de a utiliza crawlerele SEO pentru a obține informații despre optimizare. (Screaming Frog fiind doar una dintre multe, dar cea pe care o recomand).

Rezultatele căutării interne sunt doar o mică parte din ceea ce folosesc crawlerele. Există multe altele pe care crawlerele le pot găsi pentru tine. Le folosesc în multe moduri diferite când lucrez cu clienții mei.

Dacă aveți întrebări sau comentarii specifice despre acest lucru sau despre orice altceva legat de CRO, nu ezitați să mă contactați prin LinkedIn, Twitter sau prin e-mail: [email protected].