Autenticitate, Dalle-2 și Midjourney și fascinația noastră pentru imagini și artă generate de AI

Publicat: 2022-08-04Acest articol este despre tehnologia din spatele platformelor precum Dalle-2 și Midjourney și de ce creatorii Open AI ar trebui să vă plătească bani - nu să vă taxeze...

Din ce în ce mai mulți oameni de pe internet numesc Dalle-2 și Open AI drept înșelătorie. Motivul este că Dalle-2 se transformă brusc într-un serviciu monetizat, în care trebuie să achiziționați credite, dacă utilizați platforma dincolo de limita beta.

DALLE 2 este doar una dintre multele platforme noi care vă oferă acces la conținutul generat de AI și susțin că îl puteți utiliza în scopuri comerciale. Alte platforme includ Midjourney, Jasper Art, Nightcafe, Starry AI și Craiyon. Ne vom concentra asupra Dalle 2 în această postare pe blog, dar sunt aproape identice, când vine vorba de provocările și problemele legale.

Înșelătoria este o declarație destul de dură, în opinia noastră, dar există o problemă evidentă în utilizarea datelor pe care le-au creat alți oameni (fotografii, videoclipuri, adnotări, oameni de pe imagini etc.) și apoi începerea să le vindă acelorași oameni.

Această problemă poate fi trecută cu vederea de mulți dintre noi, deoarece suntem pur și simplu fascinați de noua tehnologie. Ceva care este total de înțeles.

Cu toate acestea, chiar dacă DALL-E 2 la sfârșitul zilei este doar o mașină avansată de recunoaștere a modelelor, ieșirea sa nu este neutră, iar modelele nu provin de la aer curat.

Ele se bazează pe tone de date, unde există mai multe întrebări juridice care trebuie puse. Întrebări care sunt importante pentru dvs., ca potențial utilizator al imaginilor pe care le generați.

Imagine creată de DALLE-2

Imagine creată de DALLE-2

Modelele AI nu pot fi comparate cu ființele umane

Ar trebui să începeți prin a citi acest articol genial din Engadget, înainte de a începe să luați în considerare utilizarea imaginilor DALL-E 2 în scopuri comerciale.

În articolul Engadget ei subliniază un alt lucru foarte important. Și anume faptul că DALL-E 2 și OpenAI NU renunță la propriul drept de a comercializa imaginile pe care utilizatorii le creează folosind DALL-E. În principiu, înseamnă că puteți genera imagini pe care apoi le vor vinde comercial altora.

Aceasta arată că intențiile sunt foarte diferite de analogia folosită uneori, unde promotorii DALLE-2 o vor compara cu un student care citește opera unui autor consacrat. În acest exemplu, elevul poate învăța stilurile și tiparele autorului și mai târziu le poate găsi aplicabile în alte contexte și le poate reutiliza acolo.

Cu toate acestea, nu este vorba despre un creier uman care folosește memoria creativă pentru a crea noi lucrări creative. Este vorba despre o mașină de recunoaștere a modelelor care reutiliza și, în unele cazuri, reproduce datele de antrenament în imagini care sunt apoi folosite sau chiar vândute comercial. Sunt pur și simplu două lumi diferite – atât metaforic cât și literal vorbind.

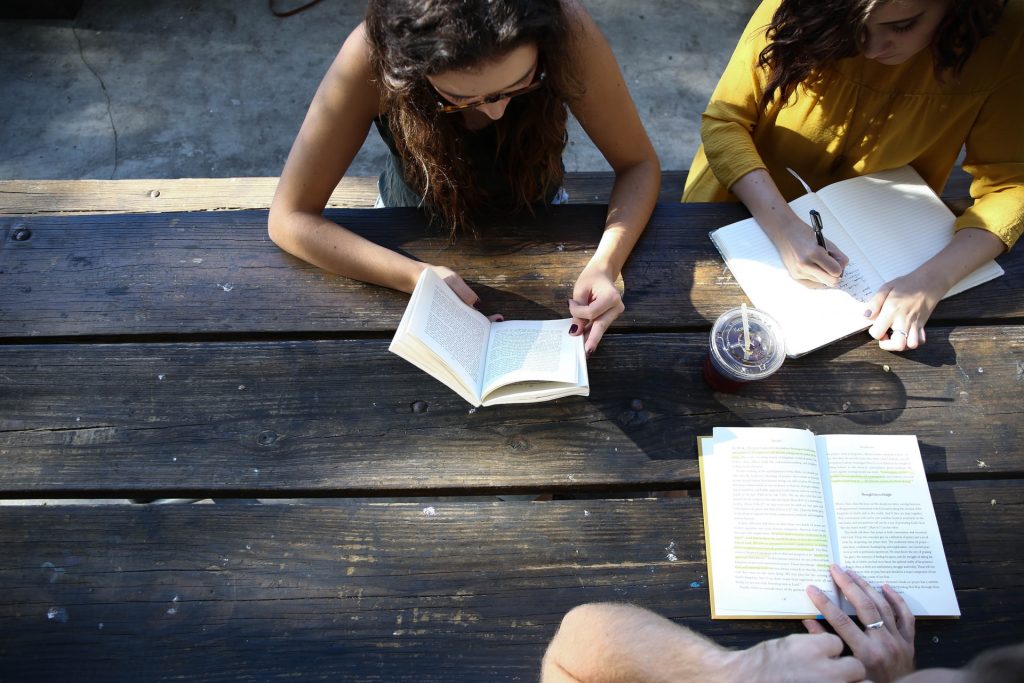

Fotografie reală din lumea reală

Fotografie reală din lumea reală

Promisiunea de autenticitate a JumpStory

Acest articol este pentru persoanele care doresc să înțeleagă la un nivel mai profund cum funcționează această nouă tehnologie de generare a imaginii AI. Dar înainte de a începe doar câteva cuvinte despre motivul pentru care JumpStory nu construiește în prezent o mașină similară.

Desigur, ni s-a pus această întrebare de mai multe ori. Nu în ultimul rând, având în vedere că deja folosim AI în compania noastră și din moment ce avem acces la milioane de imagini autentice.

Totuși, aceasta nu este o discuție tehnologică pentru noi, ci una etică. O discuție care a dus la Promisiunea noastră de autenticitate.

Suntem în mod fundamental împotriva unui viitor, în care imaginile generate de AI devin mai degrabă norma decât excepția. Spune-ne de modă veche, dar credem că lumea REALĂ este frumoasă.

Suntem mândri că fotografiile și videoclipurile noastre înfățișează ființe umane reale în diferite forme și dimensiuni. Nu suntem împotriva utilizării AI, dar nu credem că ar trebui folosită pentru a genera oameni sau realități false.

Tehnologii precum mediile sintetice și DALL-E 2 pot fi fascinante la suprafață, dar prezintă și un risc real. Ei riscă să estompeze liniile dintre real și fals, ceea ce va reprezenta o amenințare fundamentală la adresa încrederii dintre ființele umane.

Acesta este motivul pentru care JumpStory nu folosește inteligența artificială pentru a genera imagini false, ci folosește AI pentru a identifica ce imagini sunt originale, autentice și – desigur – legale pentru a fi utilizate în scopuri comerciale.

Acestea sunt imaginile pe care le găsiți folosind serviciul nostru și am numit abordarea noastră „Inteligentă autentică”.

Înțelegerea modului în care sunt generate imaginile AI

Destul despre JumpStory și problemele legale cu DALL-E 2 pentru moment. Să ne uităm la modul în care imaginile AI sunt generate pe platforme precum DALLE-2, Imagen, Crayion (fostul Dall-E Mini), Midjourney etc... Folosind DALLE-2 ca exemplu cel mai popular în prezent.

Pentru început, DALLE-2 poate îndeplini diferite tipuri de sarcini, dar ne vom concentra pe sarcina de a genera imagini în această postare pe blog.

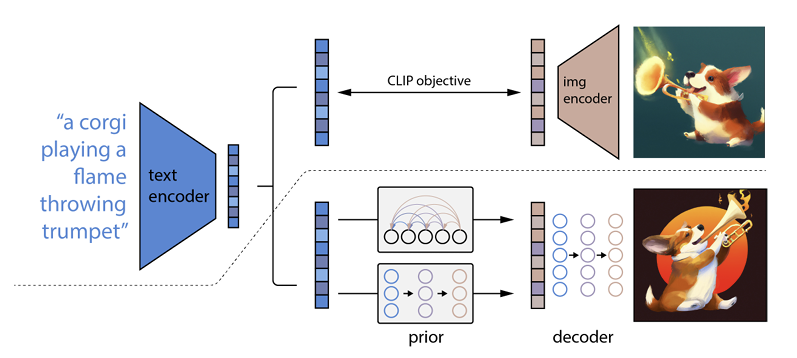

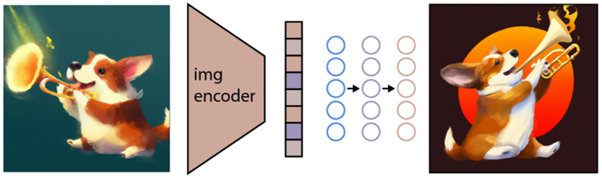

Cum funcționează este că un prompt text este introdus într-un codificator de text. Acest codificator este antrenat pentru a mapa promptul la un spațiu de reprezentare. Ulterior, un așa-numit model anterior mapează textul codificat la o codificare a imaginii corespunzătoare care captează informațiile semantice ale promptului de codificare a textului.

(Dacă acest lucru devine deja un pic tocilar, îmi pare foarte rău, dar va deveni și mai rău)

Pasul final pentru codificatorul de imagine este generarea unei imagini care vizualizează informațiile semantice pe care le-a primit codificatorul. Acestea sunt elementele de bază ale mașinilor precum Open AI.

Relația dintre text și imagini

DALL-E 2 și tehnologiile similare sunt adesea denumite generatoare de text în imagine. Motivul este capacitatea lor de a primi o intrare de text și de a furniza o ieșire de imagine.

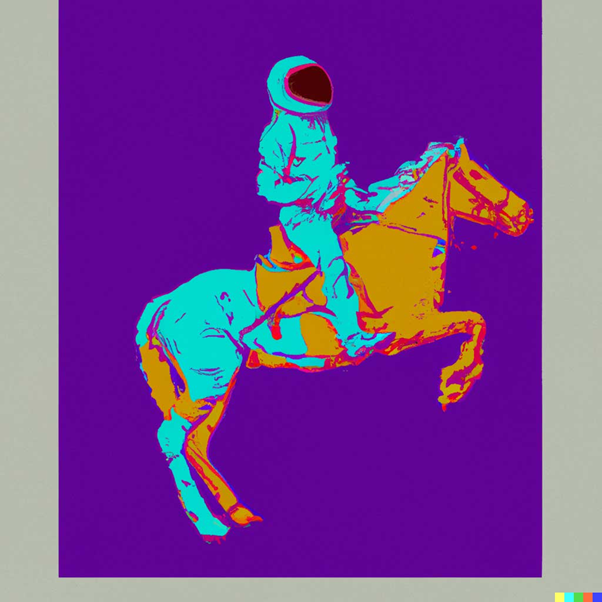

Pentru a vă da un exemplu, acesta este „Un astronaut călare pe un cal în stilul lui Andy Warhol:

sursa: DALLE-2

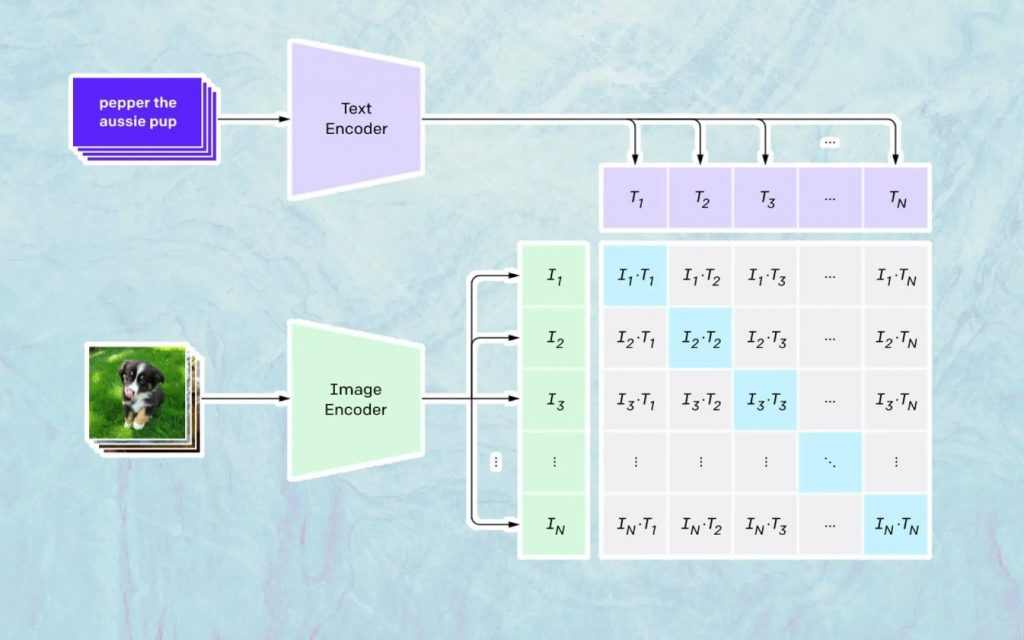

Ceea ce se întâmplă aici se bazează pe modelul Open AI numit CLIP. CLIP este prescurtarea de la „Contrastive Language-Image Pre-training” și este un model foarte complex antrenat pe milioane de imagini și subtitrări.

Ceea ce CLIP este deosebit de bun este să înțeleagă cât de mult se leagă un anumit text cu o anumită imagine. Cheia aici nu este legendă, ci cât de legată este o anumită legendă cu o anumită imagine.

Acest tip de tehnologie este numit „contrastiv”, iar ceea ce este capabil să facă CLIP este să învețe semantica din limbajul natural. Modul în care CLIP a învățat acest lucru este printr-un proces, în care obiectivul este de a (acum citând documentația tehnologică): „să maximizeze simultan similitudinea cosinus între perechile de imagine/legendă codificate corecte și să minimizeze asemănarea cosinusului dintre N 2 – N imagine codificată incorectă. perechi de subtitrare.”

Generarea imaginilor

Așa cum este descris mai sus, modelul CLIP învață un spațiu de reprezentare în care poate determina modul în care sunt legate codificările imaginilor și textelor.

Următoarea sarcină este să folosiți acest spațiu pentru a genera imagini. În acest scop, Open AI a dezvoltat un alt model numit GLIDE, care este capabil să utilizeze intrarea din CLIP și – folosind un model de difuzie – să realizeze generarea imaginii.

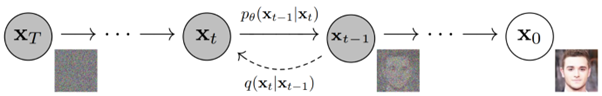

Pentru a explica pe scurt ce este un model de difuzie, este practic un model care învață să genereze date inversând un proces de zgomot gradual. Ne pare rău că acest lucru devine acum foarte tehnic, așa că pentru a cita o descriere găsită în documentația Open AI:

„Procesul de zgomot este văzut ca un lanț Markov parametrizat care adaugă treptat zgomot unei imagini pentru a o corupe, în cele din urmă (asimptotic) rezultând zgomot pur gaussian. Modelul de difuzie învață să navigheze înapoi de-a lungul acestui lanț, eliminând treptat zgomotul pe o serie de pași de timp pentru a inversa acest proces.”

Dacă doriți să aprofundați și mai mult în tehnologie, vă recomandăm să citiți acest articol excelent al lui Ryan O'Connor.