Estatísticas de testes A/B: por que as estatísticas são importantes na experimentação

Publicados: 2020-11-16

Um guia rápido para estatísticas e testes A/B: os termos que você precisa conhecer

É quase impossível conduzir um experimento de teste A/B razoável sem ter domínio das estatísticas.

Embora uma plataforma como o Convert Experiences possa cuidar de toda a medição estatística, raciocínio e análise para você, ter um entendimento básico de alguns termos estatísticos certamente o ajudará.

Vamos começar com o básico.

Amostra e população

Usar todo o tráfego do seu site para testes A/B daria, em teoria, uma ideia geral de sua população. No entanto, isso pode ser um uso subótimo dos recursos, pois a população em sua totalidade é impossível de capturar. É aqui que as amostras são úteis. Embora existam diferentes métodos de amostragem, o uso de uma abordagem de amostragem aleatória ajuda a garantir que não haja vieses inerentes na seleção da amostra. Essa abordagem é inspirada na prática médico-farmacêutica dos Ensaios Controlados Randomizados.

Média, mediana e moda

Em termos mais simples, a média representa a média, a mediana representa os valores situados no meio quando todos os números estão alinhados linearmente (o percentil 50 na distribuição), e a moda é o valor mais repetido. Esses três termos são úteis quando você está analisando as estatísticas resumidas de um teste A/B.

Variação e Desvio Padrão

Estes são conceitos muito importantes que medem a dispersão nos pontos de dados. Em outras palavras, quão longe os dados estão da média. O Desvio Padrão é a raiz quadrada da Variação. É por isso que o Desvio Padrão é um melhor juiz de dispersão, pois mantém a mesma unidade de medida que a média. Por exemplo, a altura média de homens adultos nos EUA é de 70 polegadas com um desvio padrão de 3 polegadas. Se usássemos Variação neste exemplo, o valor seria 9 polegadas quadradas, então é menos intuitivo. Pense no Desvio Padrão como o desvio “normal” dos dados.

Hipótese Nula e Alternativa

UMA A Hipótese Nula apela ao status quo. Sua Hipótese Nula afirmaria que qualquer mudança que você observou nos dados, por exemplo, o aumento, é devido à pura aleatoriedade. Uma hipótese alternativa seria que a alteração não é aleatória, mas indica um efeito causal, o que significa que suas alterações tiveram um impacto sobre seus usuários.

Por exemplo, suponha que você esteja tentando detalhar o melhor título para sua página de destino. Você tem uma variante de controle e uma variante alternativa. Você executa um teste A/B e obtém taxas de conversão diferentes para ambos, então há um aumento (positivo ou negativo). A hipótese nula aqui seria que a diferença se deve à aleatoriedade. A Hipótese Alternativa afirmaria que a mudança é atribuível a uma determinada variante.

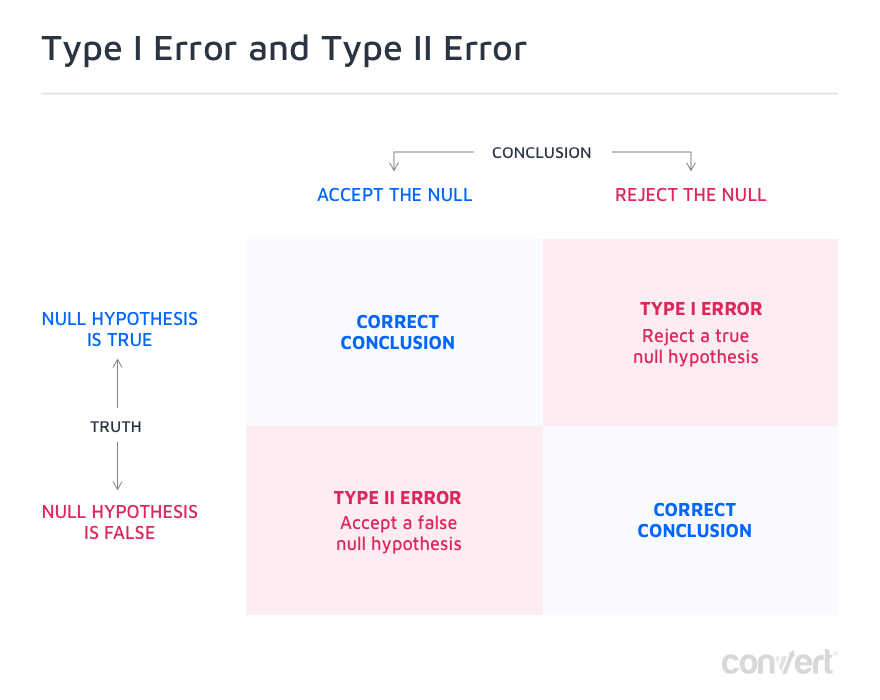

Ao executar um teste A/B, você obterá um dos quatro resultados a seguir:

- Você rejeita a hipótese nula.

- Você falha em rejeitar a Hipótese Nula.

- Você rejeita falsamente a hipótese nula.

- Você falha falsamente em rejeitar a Hipótese Nula.

Idealmente, os resultados a e b devem ser aqueles a serem almejados, pois esses são os cenários com os quais você pode aprender algo. É assim que você pode melhorar seu produto e, finalmente, aumentar seus resultados. Os resultados c e d correspondem aos erros abaixo.

Erros Tipo I e Tipo II

As duas últimas opções nos resultados possíveis do seu teste A/B são erros Tipo I e Tipo II, também conhecidos como falsos positivos e falsos negativos.

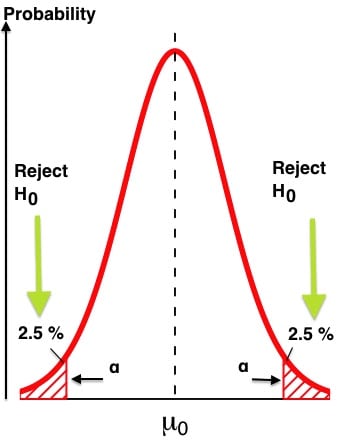

Um erro do tipo I ocorre quando você rejeita falsamente uma hipótese nula verdadeira. Ou seja, a mudança que você observou foi devido ao acaso, mas você concluiu o contrário, então é um falso positivo. Na maioria dos casos, tudo o que é necessário para diminuir os falsos positivos é aumentar o nível de confiança necessário para alcançar significância estatística. Isso geralmente é definido como 95%, mas para experimentos de missão crítica, você pode querer configurá-lo para 99% de confiança, o que reduzirá as chances de cometer esse erro para apenas 1%.

Os erros do tipo II são exatamente o oposto. Aqui, você falha em rejeitar uma falsa hipótese nula. Isso significa que houve um impacto real, positivo ou negativo, na taxa de conversão, mas não pareceu ser estatisticamente significativo e você declarou falsamente que foi por acaso. Na maioria das vezes, isso se deve à falta de poder estatístico.

Na linguagem do poder estatístico, a letra grega α representa os erros do Tipo I e β representa os erros do Tipo II. É fácil ficar confuso entre poder estatístico e significância estatística.

Esta tabela deixa claro:

Confiança Estatística

Quanto mais visitantes seu teste recebe, mais sua confiança estatística aumenta, até chegar a 99% se você deixá-lo rodar por tempo suficiente. Mas geralmente, a menos que seja de missão crítica, um nível de confiança de 95% é considerado bom o suficiente para a maioria dos testes A/B (garantindo que a chance de fazer um falso positivo, ou seja, erro Tipo I é de 5% no máximo).

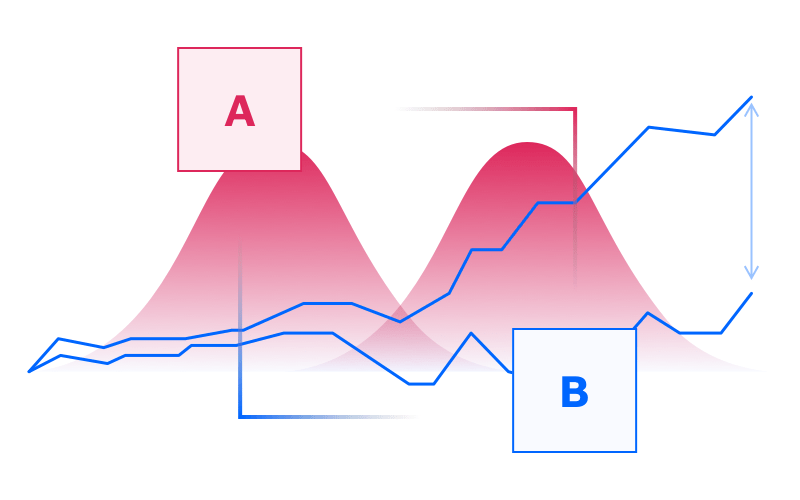

Poder Estatístico

O poder estatístico refere-se à probabilidade de detectar um efeito quando ele existe.

Poder Estatístico e Confiança Estatística são conceitos relacionados que trabalham juntos para medir a evolução de um teste A/B. Idealmente, ambos devem passar os valores limite antes de terminar o teste (mais sobre isso abaixo).

Intervalo de Confiança e Margem de Erro

Geralmente, o resultado do seu experimento de teste A/B seria algo como "A taxa de conversão é 3% +/- 1%". Nesta declaração, o '1%' representa sua margem de erro. Em suma, este é o desvio nos resultados de conversão que é razoável para manter os resultados do teste aceitáveis. Quanto menor a margem de erro, mais confiáveis se tornam os resultados do teste. À medida que você aumenta o tamanho da amostra, notará que a margem de erro diminui.

Se você executar testes A/B com o Convert Experiences, terá acesso ao Relatório de experiência que detalha a variação, a taxa de conversão, a melhoria, a confiança e as conversões em visitantes mensais únicos . Você deve atingir pelo menos 97% de confiança para declarar um vencedor. Por padrão, a plataforma Convert foi otimizada para começar a relatar as análises do experimento somente depois que cinco conversões forem alcançadas. Para garantir a confiabilidade dos testes, o Convert usa testes Z de duas caudas.

No início da experiência, se uma das variantes apresentar um desempenho significativamente melhor, você ainda deve continuar com a duração estipulada do teste. Os primeiros resultados podem ser causados por ruído ou aleatoriedade.

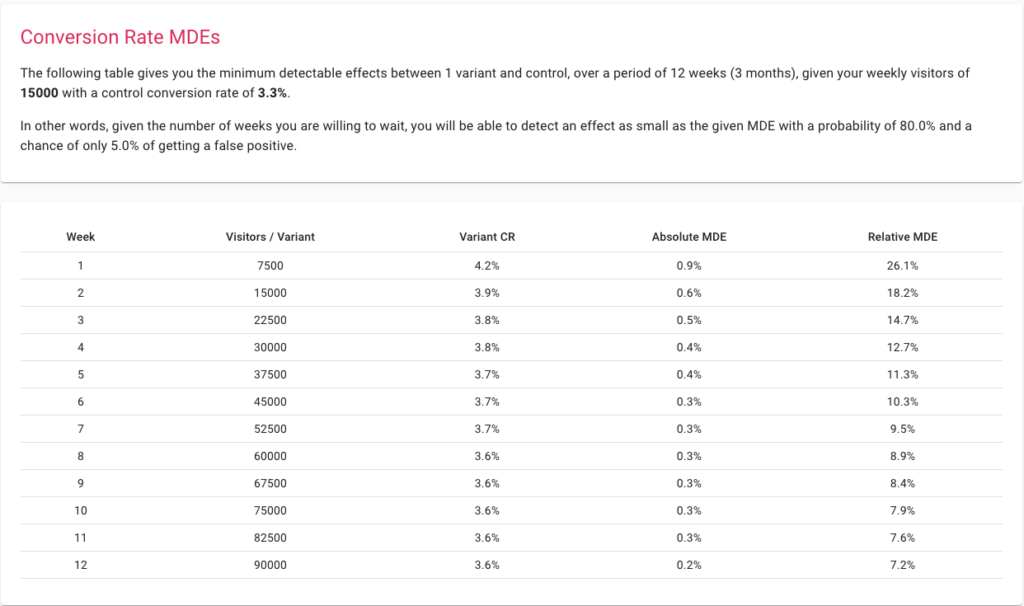

Efeitos mínimos detectáveis

O MDE é o aumento mínimo a ser alcançado, acima do qual vale a pena implementar a mudança. Preparar-se para um teste escolhendo um MDE baixo permite que seu experimento capture alterações mais granulares. Definir um MDE mais alto significa que seu experimento pode detectar apenas alterações importantes e, portanto, funcionar mesmo com tamanhos de amostra menores. O problema aqui é que fazer uma mudança drástica para gerar um aumento grande o suficiente, na maioria dos casos, não será possível, a menos que seu site nunca tenha sido otimizado antes.

A melhor maneira de pensar sobre MDE é usar nossa calculadora de tamanho de amostra. Comece inserindo seu tráfego e conversões semanais e veja o que pode ser alcançado ao longo de um período de tempo.

Valor P

Cassie Kozyrkov, cientista-chefe de decisões do Google, cunhou uma definição muito simples para explicar o valor-p: “Quanto menor o valor-p, mais ridícula a hipótese nula parece!”

O que é o valor P em testes A/B?

O valor-p é definido como a probabilidade de observar um resultado como extremo ou mais extremo do que o observado, assumindo que a hipótese nula é verdadeira. Portanto, o valor-p é um dispositivo matemático para verificar a validade da hipótese nula. Quanto menor o valor-p, mais certeza temos de que devemos rejeitar a hipótese nula.

A forma como a usamos é comparando-a com o nível de significância. Digamos que temos um nível de significância de 5%, que corresponde diretamente a um nível de confiança de 95%, então assim que o valor p se tornar inferior a 5/100 = 0,05, podemos dizer que nosso teste atingiu significância estatística e pode rejeitar a hipótese nula.

Se quisermos ter ainda mais certeza, definimos nosso nível de significância para 1% e esperamos que o valor p caia abaixo de 0,01. Isso equivaleria a 99% de confiança em nossos resultados.

Distribuição de tráfego

A Distribuição de Tráfego ajuda a alocar uma certa porcentagem de tráfego para o experimento. Suponha que você tenha 100 visitantes em seu site todos os meses. A partir disso, você pode optar por alocar 30% do tráfego para o experimento. Por padrão, cada variante em seu teste A/B receberá uma parcela igual do tráfego. Portanto, se você tiver duas variantes, cada uma receberá 15% do tráfego.

Usar o Convert Experiences ajuda você a configurar essa alocação de tráfego em apenas alguns cliques. À medida que seu processo de experimentação evolui, você pode criar mais variantes e otimizar a alocação para atender às suas necessidades.

Como as estatísticas podem ajudar nos testes A/B?

Por que você não pode simplesmente comparar o desempenho da variante A e B?

A execução de um experimento de teste A/B usando até mesmo uma plataforma conveniente como o Convert Experiences requer alguns recursos em termos de tempo e energia. Então, não faria sentido apenas criar duas variantes, medir suas respectivas taxas de conversão e escolher aquela com melhor desempenho?

Embora pareça pragmático e engenhoso, pode levar a conclusões erradas e até mesmo a resultados mal interpretados, pois nenhum teste estatístico foi executado nos dados. Portanto, observar uma mudança não é suficiente, é preciso saber quanto tempo esperar para ter certeza dessa mudança e, para isso, é preciso realizar um teste estatístico como teste Z, teste T ou teste G.

Observar apenas o tamanho do elevador ou do efeito não o ajudará:

uma. Determinar os prováveis fatores causais associados à conquista de uma variante

Um teste A/B, por design, o obrigaria a escolher duas variantes que têm apenas algumas diferenças de material. Para um conjunto maior de diferenças, você geralmente optaria por um teste multivariado mais extenso.

O teste A/B opera com a regra de que, desde o início, você conhece as variáveis dependentes e independentes do experimento. Por exemplo, se você criar dois conjuntos com CTAs diferentes colocados no mesmo layout, saberá que a diferença nos CTAs é o fator causal se puder refutar a hipótese e ver uma mudança nas conversões.

Se você simplesmente executar duas variantes totalmente diferentes, mesmo que obtenha uma tração relativamente melhor em uma, isso não o ajudará a obter insights sobre seu público ou determinar por que funciona.

b. Diferenciar entre aleatoriedade e causalidade

A estrutura de um teste A/B exigiria uma Hipótese Nula e uma Hipótese Alternativa. A Hipótese Nula geralmente investigaria a aleatoriedade sendo o fator causal e não a eficácia de uma de suas variantes, na determinação das taxas de conversão. Uma Hipótese Nula não é refutada quando a significância estatística não é alcançada a tempo, e qualquer variabilidade subsequente é assumida como resultado de aleatoriedade. Por outro lado, se você pode rejeitar a Hipótese Nula, significa que há uma alta probabilidade (no nível de confiança definido, por exemplo, 95% ou 99%) de você ter descoberto um fator causal com impacto positivo ou negativo no conversões.

c. Alocar custos apenas para as alterações com maior probabilidade de conversões aprimoradas

Os testes A/B realizados também viriam com medidas estatísticas como níveis de significância, intervalos de confiança e margens de erros. Tais conceitos analíticos não existem na maioria das análises ad hoc.

Tomemos, por exemplo, uma comparação entre duas páginas de envio de formulários com algumas diferenças materiais no layout e na exibição das informações. Um tem um desempenho relativamente melhor do que o outro. Agora, como você determina que você será capaz de replicar os resultados? Como você não tem dados que mostrem a significância dos resultados do experimento, não há como julgar se os resultados do experimento podem ser replicados ou não.

Avaliando e Eliminando Sua Exposição a Erros Tipo I e Tipo II para Testes A/B

Erros do tipo I (uma hipótese nula verdadeira é rejeitada ou um falso positivo) e erros do tipo II (uma hipótese nula falsa não é rejeitada ou um falso negativo) podem ter sérias consequências nos ativos de mercado que você está otimizando com testes A/B.

Nenhuma ferramenta pode mostrar explicitamente um erro Tipo I ou Tipo II, mas pode ajudá-lo a minimizá-los, por exemplo, garantindo que um nível de confiança de 95% ou mais seja alcançado e que o poder estatístico tenha atingido pelo menos 80%

Suponha que você faça duas variantes da página final em seu ciclo de compra, mostre-a para cerca de 10.000 visitantes em 10 dias e obtenha os resultados. Você vê um desempenho melhor para uma variante e, portanto, a aplica em seu site de comércio eletrônico.

O problema aqui é que você conhecerá um erro Tipo I ou Tipo II em seu experimento de teste A/B depois de não conseguir replicar os resultados de seu experimento na realidade. Existem maneiras melhores de garantir que você não tenha erros Tipo I e Tipo II em seu teste A/B.

Primeiro, certifique-se de que o tamanho da amostra seja grande o suficiente para garantir experimentos estatísticos sólidos. Você pode usar a calculadora do Convert para obter o tamanho de amostra correto.

Em seguida, certifique-se de ter um nível de significância de pelo menos 95% e não pare o teste até que seu poder atinja 80%. Com o MDE correto e o comprimento do experimento fornecido pela calculadora, você pode ter certeza de controlar os erros do Tipo I ou do Tipo II. O primeiro é diretamente influenciável pelo nível de significância que você define e o segundo pelo poder estatístico com o qual você está disposto a conviver. Idealmente, seu nível de confiança deve ser superior ou igual a 95% e seu poder estatístico deve ter acumulado pelo menos 80%. Em ambos os casos, quanto mais, melhor. Se ambos os parâmetros atingirem 99%, garante-se que o risco de erros do Tipo I ou II é bem controlado e inferior a 1%.

Tanto a descoberta quanto a eliminação de tais problemas só são possíveis devido ao pensamento estatístico sobre o qual o teste A/B opera.

Determinando se seu experimento de teste A/B é escalável ou não

No exemplo acima, mesmo que você veja uma variante vencer sua alternativa ao longo de um mês, não será possível dimensionar seu experimento facilmente. Isso ocorre porque o tamanho da amostra de 10.000 visitantes foi bastante pequeno.

As estatísticas de teste A/B fornecem muitos guias heurísticos para garantir que seu teste seja escalável e seus resultados também. As saídas de cada experimento de teste A/B abrirão caminho para mais testes no futuro.

Primeiro, comece garantindo que você tenha tráfego suficiente todos os meses para testar qualquer variante dos elementos de interface do usuário ou UX da sua plataforma. Os especialistas da Convert recomendam tráfego de pelo menos 10.000 visitantes e 1.000 conversões em cada variante para obter resultados estatisticamente sólidos. Depois de tê-los, certifique-se de não estar testando vários elementos de uma vez, permitindo que o teste seja executado por uma duração considerável e possa atingir um nível razoável de significância.

Se você tiver um pequeno conjunto de visitantes, ainda poderá realizar testes A/B em campanhas de e-mail, campanhas de mídia social e até grupos de anúncios do Google. Ou você pode optar por um MDE alto para obter informações amplas sobre seu público.

Como tornar os experimentos econômicos

Alocar qualquer porcentagem do seu tráfego para um teste A/B é um custo. Você está mostrando uma página possivelmente abaixo do ideal ou elemento UX para seu público e, portanto, pode estar perdendo alguma receita potencial. Embora o teste A/B dê a você uma ideia definitiva para dimensionar um elemento ou página mais otimizada que possa recuperar essas prováveis receitas perdidas, esse custo pode ser usado como uma restrição para otimizar seu processo de teste.

Depois de realizar um teste A/B, você pode passar para um teste A/B/n onde terá várias outras variantes a serem testadas.

Muitas calculadoras gratuitas disponíveis on-line mostram o tamanho da amostra que você precisa para obter resultados precisos deste teste. Essas calculadoras funcionam com uma suposição simplista – calcule o tamanho da amostra para um teste A/B e multiplique-o pelo número de variantes do experimento. Esta é uma maneira ineficiente de proceder. Nossa calculadora oferece opções eficientes de correção de múltiplas comparações, como Šidak, portanto, sempre use as ferramentas certas em cada etapa de sua experimentação para garantir que você obtenha os resultados necessários sem perder os dólares extras incorridos com erros de cálculo.

Comece a planejar seus testes com a Calculadora de Testes A/B da Convert

Estimando e controlando a aleatoriedade em sua amostra

Embora existam vários princípios matemáticos complexos de aleatoriedade, a maioria deles indica a mesma característica – imprevisibilidade.

A aleatoriedade pode ser percebida como o oposto da causalidade claramente definida. Em vez de saber quais elementos foram responsáveis pela maior conversão, você precisa confiar em alguns fatores externos indefinidos como os prováveis fatores causais para os resultados. Como você não controla esses fatores externos, não pode replicar os resultados do teste em escala.

Se você não estiver usando um processo de teste A/B estatisticamente sólido, não se preocuparia em examinar o impacto da aleatoriedade. Mas, a aleatoriedade ainda existirá. Você pode acabar aplicando capital em um ativo de marketing que converte durante o teste, mas não funciona em escala. Pior, você pode acabar diluindo o impacto do seu funil de conversão existente.

As estatísticas de teste A/B podem ajudá-lo a resolver esse problema. Ao formular uma hipótese, você está criando um cenário em que a aleatoriedade pode ser o motivo dos resultados alterados. Se você pode refutar esse cenário, você refutou essencialmente a aleatoriedade como a causa de melhores conversões. Com mais testes à frente no processo com foco em outras áreas do funil de conversão, você pode eliminar ainda mais o espaço para aleatoriedade no processo de otimização de conversão.

O ideal seria definir um Critério de Avaliação Global (OEC) com uma métrica principal e outras métricas de proteção e executar experimentos para otimizar as primeiras e garantir que as últimas não se degradem. Por exemplo, você quer aumentar as taxas de conversão (métrica primária), mas não quer que o engajamento do usuário diminua, pois isso indicaria clientes insatisfeitos.

Um ótimo livro, provavelmente o livro mais importante sobre experimentação até hoje, é Trustworthy Online Controlled Experiments: A Practical Guide to A/B Testing, de Ron Kohavi, Diane Tang, Ya Xu.

Garantindo que você não precisa de um teste multivariado mais abrangente

Ferramentas abrangentes, como o Convert Experiences, podem ajudá-lo a executar vários testes A/B. Embora isso possa parecer uma funcionalidade trivial, pode ajudá-lo a entender se você precisa de um teste multivariado mais abrangente ou se os resultados do seu teste A/B são satisfatórios o suficiente.

Tudo isso depende do que você faz logo após ter entendido os resultados do teste. Você começa a implantar a página ou elemento vencedor ou faz mais testes? Se o tamanho da amostra, o nível de significância e o MDE forem satisfatórios, normalmente você poderá implantar a alternativa vencedora. Se você estiver do outro lado, poderá usar mais testes para encontrar a causa das diferentes taxas de conversão.

Por exemplo, suponha que você esteja testando se um determinado CTA em sua página de destino está ajudando ou não com melhores conversões. Você executa seu teste A/B e tem um vencedor claro. Mas, algumas medidas estatísticas como o nível de significância não são satisfeitas. Então, você pega a variante vencedora e cria outra variante para realizar outro teste A/B.

Se os resultados forem replicados, você pode ter mais confiança na variante vencedora. Se você não conseguir replicar os níveis de conversão do primeiro teste, talvez seja necessário um teste multivariado para encontrar o elemento responsável pelo aumento nas conversões.

O teste A/B pode ajudá-lo a evitar a dependência de dados auto-relatados

Mesmo a menor das variáveis pode ter um grande impacto no comportamento do usuário detectado. Por exemplo, o efeito de cintilação tem um impacto considerável nas taxas de conversão. A cintilação é a situação em que sua página de destino padrão é exibida antes da página variante quando um visitante faz parte do tráfego de amostra usado para testes A/B. Isso pode levar a resultados poluídos – mesmo quando você está executando um processo analiticamente consistente.

Quando pode haver possíveis problemas com processos estatísticos e analíticos, como testes A/B, a execução de um processo autorrelatado só pode levar a resultados abaixo do ideal ou até mesmo falsos. Os processos de autorrelato são frequentemente poluídos por vários vieses e dados ruidosos, pois toda a responsabilidade de lembrar as preferências e relatá-las é deixada para o usuário, que não tem nenhum incentivo para ser honesto. Além disso, existem vieses de ordenação e outros fatores externos que podem levar a dados defeituosos.

O teste A/B coloca você na cadeira de observação e elimina a necessidade de qualquer forma de relatório do usuário. Com ferramentas como o Convert, você nem precisa se preocupar com a cintilação.

Tomada de Decisões Organizacionais Orientadas a Dados

Um experimento de teste A/B não deixa espaço para suposições no processo. A cada etapa, sua plataforma de teste está coletando observações, registrando dados e realizando análises. Dessa forma, independentemente das preferências de seus superiores, investidores ou agências, os resultados obtidos seriam orientados por dados.

Quando há várias partes interessadas envolvidas no processo, é fácil que o resultado final fique abaixo do ideal. O teste A/B é um processo analítico, que elimina o espaço para qualquer tomada de decisão hierárquica ou pensamento tendencioso.

Por exemplo, sua agência pode recomendar uma revisão da interface do usuário para sua página de destino, pois isso aumentará as faturas do mês e, se feito corretamente, pode até não prejudicar suas conversões. No entanto, com um teste A/B, se sua Hipótese Nula permanecer forte, você saberá de fato que tais mudanças não são necessárias por enquanto. Como você tem os dados para sustentar seu raciocínio, não precisa sucumbir à postura nem mesmo à liderança em sua empresa. Isso também pode ajudá-lo a combater o HiPPO (opinião da pessoa mais bem paga). Os dados não mentem e um teste A/B é a melhor prova que você tem à sua disposição.

Entendendo os resultados do experimento com cálculos transparentes

Compreender os resultados do seu teste A/B é quase tão importante quanto executar um teste estatisticamente rigoroso. Qualquer ferramenta pode executar o teste, comparar as alternativas e lançar um vencedor em você. O que você precisa é de uma indicação de uma relação causal. Embora as medidas estatísticas possam destacar isso, o Convert Experiences foi projetado para transparência nos cálculos.

A plataforma tem 99,99% de tempo de atividade, permite mais de 90 integrações de terceiros, permite rastreamento de metas de terceiros e suporta verificações de código e erros. Dessa forma, ao final do processo de teste, você terá uma ideia clara de qual elemento é o vencedor, por que é mais preferível e se precisa de mais testes para ter mais confiança em escalá-lo.

Colocando as estatísticas A/B em uso para avançar em direção à maturidade do CRO

O que é maturidade de CRO e como os testes A/B estatisticamente sólidos podem ajudá-lo a chegar lá?

Embora a Otimização da Taxa de Conversão possa parecer uma maneira isolada de pensar, ela requer mudanças baseadas em processos em toda a empresa, tentando se concentrar mais nas conversões. O desafio é que o CRO é um campo relativamente novo. Em uma pesquisa de 2018, cerca de 62% dos profissionais de marketing trabalhavam em CRO há menos de 4 anos.

Um especialista em CRO da Shopify criou uma hierarquia de como as empresas tendem a transcender a maturidade do CRO. À medida que você se aprofunda nessa hierarquia, você descobrirá como a experimentação estatística sólida é fundamental para evoluir seus processos organizacionais:

1. Realização de pesquisas qualitativas e quantitativas para identificar pontos de contato abaixo do ideal

Seu painel do Google Analytics geralmente ajudará você a explorar as páginas ou pontos de contato na experiência do consumidor que exigem atenção imediata. Resolver um problema específico, como altas taxas de rejeição na página inicial, carrinhos abandonados, preenchimento incompleto de formulários e pular assinaturas de e-mail, pode ser usado como ponto de partida para otimizar o funil de conversão.

2. Formulando ideias de teste e experimentação com base na pesquisa realizada anteriormente

As estatísticas de testes A/B podem ajudar você a entender o desempenho de referência do seu site e até mesmo da concorrência. Você pode usar isso para entender quais elementos estão atrasados e iniciar variantes de teste A/B que podem ter um desempenho melhor.

3. Executando testes e experimentando ideias com as mais altas prioridades

Ao configurar suas ideias de teste A/B no Convert Experiences, você definirá métricas como MDE. Essas métricas ajudarão você a priorizar os testes que terão o máximo impacto no seu negócio, no que diz respeito à alocação de recursos necessária para executar o experimento.

4. Analisando e Registrando os Resultados dos Testes

Depois de ter realizado o teste, torna-se fundamental entender por que você obteve os resultados que está vendo. É aqui que plataformas como o Convert Experiences podem ajudá-lo a filtrar entre aleatoriedade e causalidade de alta probabilidade. Com seus cálculos transparentes, o Convert Experiences ajudará você a entender por que sua variante vencedora tem melhor desempenho.

5. Criando Testes de Acompanhamento

Depois de realizar os testes A/B e obter os resultados, você pode passar para testes multivariados mais abrangentes ou realizar um teste A/B com outra variante. O Convert facilita a realização de um conjunto variado de testes estatísticos que podem ajudá-lo a aumentar sua confiança em apoiar a variante vencedora.

O Modelo de Maturidade CRO se concentra em um processo holístico em toda a Estratégia e Cultura, Ferramentas e Tecnologia, Pessoas e Habilidades e Processo e Metodologia de uma empresa, onde o progresso da empresa é rastreado em vários níveis de maturidade, como Iniciante, Aspirante, Progressivo, Estratégico, e Transformador.

O Convert Experiences traz uma análise de dados rigorosa para o seu processo de teste A/B, não requer codificação para conduzir os testes, fornece resultados visualmente e analiticamente acessíveis e é transparente sobre os resultados dos testes. Com a plataforma no centro de seus planos de teste A/B, a maturidade do CRO da sua empresa pode avançar para os estágios de transformação com maior facilidade.

Testes A/B em ação: estudos de caso comparativos

1. Como usar o Google Analytics e converter experiências para geração de hipóteses

O Google Analytics pode ser um ótimo ponto de partida para entender as possíveis áreas de melhoria em seu website. Queda repentina no tráfego, altas taxas de rejeição em comparação com os tempos de página etc. podem ser fortes indicadores de possíveis problemas.

Mapeie todos os desafios que você vê em seus relatórios do Google Analytics. Paralelo a isso, faça uma pesquisa qualitativa em seu site, redes sociais e campanhas de e-mail perguntando ao seu público o que eles estão procurando. Além disso, você pode usar o Hotjar para entender como os visitantes estão navegando nos elementos de cada página.

Com base em todos esses dados, você pode criar variantes perspicazes e executar testes A/B. Se você já estiver usando o Convert Experiences, também poderá usar a ferramenta de geração de hipóteses Convert Compass para agilizar ainda mais o processo.

2. Aumentando as conversões de carrinhos abandonados por meio de testes A/B

Carrinhos abandonados são caros para o seu site e bastante inconvenientes para seus visitantes, pois ambos investiram tempo e recursos significativos para chegar a esse ponto, mas a conversão não funcionou.

Usando o Convert Experiences integrado a outras plataformas, você pode formular uma abordagem estruturada para enfrentar esse desafio.

- Primeiro, comece integrando o Convert Experiences ao seu Shopify, WooCommerce, PrestaShop, BigCommerce ou qualquer outra plataforma de comércio eletrônico que você esteja usando.

- Em seguida, use o Google Analytics para definir metas em suas plataformas e use ferramentas como Hotjar ou Crazy Egg para avaliar o possível problema.

- Com o Convert Experiences, você pode usar esses dados, formular hipóteses e executar testes A/B de maneira organizada. Os clientes observaram um aumento de receita de mais de 26% usando uma abordagem semelhante.

O Convert Experiences integra-se a mais de 100 ferramentas. Confira nosso banco de dados para descobrir se nos integramos com as ferramentas em sua pilha de tecnologia atual. Se não o fizermos, envie-nos uma mensagem e nós construímos!

3. Otimização da página de destino

As páginas de destino são bastante centrais para todo o processo de conversão. Para extrair o máximo valor de suas páginas de destino, você pode usar uma variedade de ferramentas como Google Analytics, Adobe Analytics, Kissmetrics, Baidu Analytics ou outras ferramentas líderes para o caso de uso. O Convert Experiences se integra perfeitamente a essas plataformas para ajudá-lo a filtrar páginas de destino de baixa conversão.

Em seguida, você pode usar a integração Hotjar e Convert para entender quais elementos da sua página não estão funcionando. Com ferramentas avançadas, como mapas de calor, você pode obter uma compreensão visual de como os visitantes estão acessando os diferentes elementos da sua página. Passado isso, você pode usar o Convert Compass para gerar hipóteses e depois executar testes na plataforma.

Depois de realizar seu teste, você pode usar a integração entre o Convert e as principais plataformas de criação de páginas de destino, como LanderApp, Instapage ou Hubspot CMS. Essas integrações ajudarão você a realizar experimentos de teste A/B fáceis em suas páginas de destino.

Usando o mesmo fluxo de trabalho, os especialistas em CRO encontraram incrementos de conversão de 27% com as taxas de adição ao carrinho subindo 13%.

Alcançando um ROI mais alto com testes A/B 'higiênicos'

- Limite de tráfego do site : a Convert recomenda que você tenha tráfego de pelo menos 10.000 visitantes e conversões acima de 1.000 disponíveis para cada variante testada.

- Usando a ferramenta certa para testes A/B : Não ter a plataforma de teste certa pode gerar resultados poluídos, fazer com que você execute testes abaixo do ideal ou causar restrições severas em seus recursos. O Convert Experiences foi projetado para eliminar esses parâmetros-chave, garantindo ao mesmo tempo que o processo de teste seja acessível, transparente e contínuo.

Agora você pode executar testes no Convert Experiences gratuitamente por até 15 dias. Você terá uma ideia clara de como é uma plataforma transparente, sem oscilações e transparente que se integra às suas outras ferramentas de análise de conversão.

- Definindo Objetivos de Teste : Seus objetivos como empresa devem estar alinhados. Por exemplo – enquanto você está otimizando para o máximo de inscrições, algumas outras unidades em sua equipe não devem otimizar os processos consequentes para o máximo de vendas. UX incoerente pode causar mais danos do que um UX sub-ótimo.

Portanto, mantenha a uniformidade de metas entre todo o conjunto de membros da equipe. No nível de teste, certifique-se de definir o tamanho da amostra, duração, significância estatística, hipótese e MDE claramente antes, durante e depois de executar seu teste A/B.

- Excluindo o tráfego interno: quando você está executando um teste A/B, muitos dos membros de sua equipe visitam as páginas ou pontos na jornada do cliente para avaliar objetivamente a página. Isso pode trazer ruído aos resultados do seu teste.

O Convert Experiences foi projetado para filtrar esse tráfego e focar apenas nos segmentos de público que você definiu, para gravar, agregar e analisar dados no processo de teste A/B.

Considerações finais sobre estatísticas de testes A/B

O teste A/B é um exercício analítico rigoroso que só pode ser executado com rigor estatístico. Sem as estatísticas construídas no processo, o teste A/B é pura suposição.

O Convert Experiences possibilita que você tenha experimentos de teste A/B simplificados, acessíveis, confiáveis e eficientes em termos de recursos. While the process of A/B testing can seem a little overwhelming at first, it certainly unlocks value in the form of the right insight and analytical proven ideas it gives you. Make sure you never run an A/B test in isolation – it has to be followed up with more tests, and even multivariate tests.

With consistent optimization and unlimited tests made available by Convert Experiences, you can expect your enterprise to become a more analytical and data-driven operation in no time.