Autenticidade, Dalle-2 e Midjourney e nosso fascínio por imagens e arte geradas por IA

Publicados: 2022-08-04Este artigo é sobre a tecnologia por trás de plataformas como Dalle-2 e Midjourney, e por que os criadores da Open AI deveriam estar pagando dinheiro – não cobrando nada…

Mais e mais pessoas na internet estão chamando Dalle-2 e Open AI de fraude. O motivo é que o Dalle-2 agora de repente se transforma em um serviço monetizado, onde você precisa comprar créditos, se usar a plataforma além do limite beta.

DALLE 2 é apenas uma das muitas novas plataformas que oferecem acesso a conteúdo gerado por IA e afirmam que você pode usá-lo para fins comerciais. Outras plataformas incluem Midjourney, Jasper Art, Nightcafe, Starry AI e Craiyon. Vamos nos concentrar em Dalle 2 neste post do blog, mas eles são quase idênticos, quando se trata de desafios e problemas legais.

Golpe é uma afirmação bastante dura em nossa opinião, mas há um problema óbvio em usar dados que outras pessoas criaram (fotos, vídeos, anotações, pessoas nas imagens etc.) e depois começar a vendê-los de volta para as mesmas pessoas.

Este problema pode ser ignorado por muitos de nós, porque estamos simplesmente fascinados pela nova tecnologia. Algo totalmente compreensível.

No entanto, embora DALL-E 2 no final do dia seja apenas uma máquina avançada de reconhecimento de padrões, sua saída não é neutra e os padrões não vêm do ar fresco.

Eles são baseados em toneladas de dados, onde há várias perguntas legais a serem feitas. Perguntas que são importantes para você como um usuário em potencial das imagens que você gera.

Imagem criada por DALLE-2

Imagem criada por DALLE-2

Modelos de IA não podem ser comparados a seres humanos

Você deve começar lendo este artigo brilhante no Engadget, antes de começar a considerar o uso de imagens DALL-E 2 para fins comerciais.

No artigo do Engadget eles apontam outra coisa muito importante. Ou seja, o fato de que DALL-E 2 e OpenAI NÃO estão abrindo mão de seu próprio direito de comercializar imagens que os usuários criam usando DALL-E. Basicamente, o que significa que você pode gerar imagens que eles venderão comercialmente para outras pessoas.

Isso mostra que as intenções são muito diferentes da analogia às vezes usada, onde os promotores do DALLE-2 irão compará-lo a um aluno lendo a obra de um autor consagrado. Neste exemplo, o aluno pode aprender os estilos e padrões do autor e mais tarde achá-los aplicáveis em outros contextos e reutilizá-los lá.

No entanto, não se trata de um cérebro humano usando a memória criativa para criar novos trabalhos criativos. Trata-se de uma máquina de reconhecimento de padrões que reutiliza e, em alguns casos, reproduz dados de treinamento em imagens que são usadas ou mesmo vendidas comercialmente. São simplesmente dois mundos diferentes – tanto metaforicamente quanto literalmente falando.

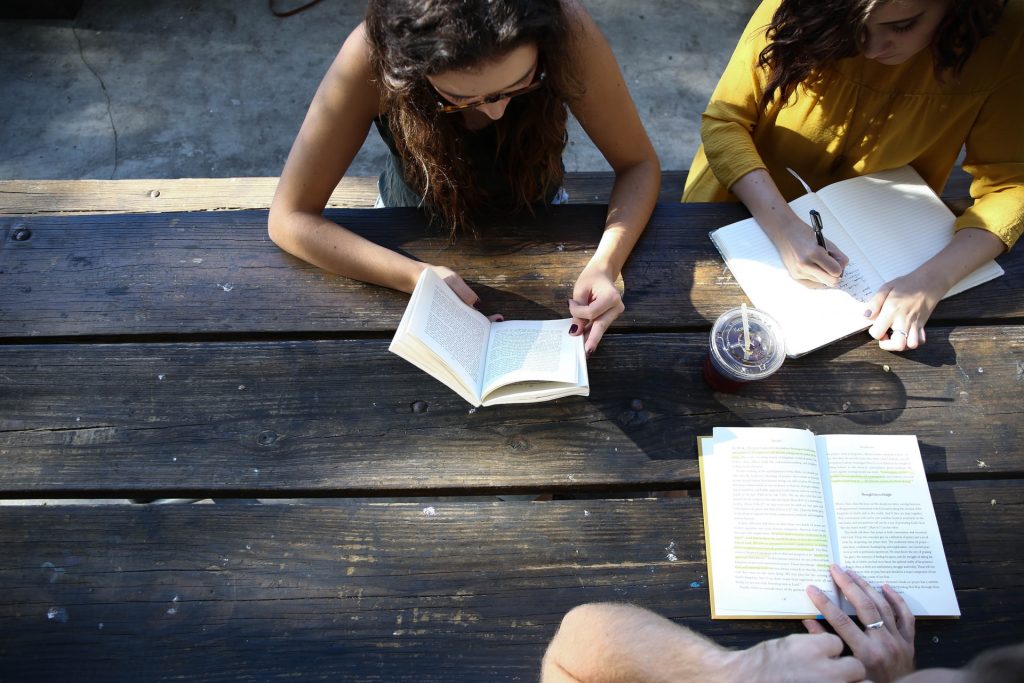

Foto real do mundo real

Foto real do mundo real

Promessa de autenticidade da JumpStory

Este artigo é para as pessoas que desejam entender em um nível mais profundo como funciona essa nova tecnologia de geração de imagens de IA. Mas antes de começarmos, apenas algumas palavras sobre por que a JumpStory não está atualmente construindo uma máquina semelhante.

Claro, já nos fizeram essa pergunta várias vezes. Ainda mais considerando que já estamos usando IA em nossa empresa e porque temos acesso a milhões de imagens autênticas.

No entanto, esta não é uma discussão tecnológica para nós, mas ética. Uma discussão que resultou em nossa Promessa de Autenticidade.

Somos fundamentalmente contra um futuro, onde imagens geradas por IA se tornem a norma e não a exceção. Nos chame de antiquados, mas acreditamos que o mundo REAL é lindo.

Estamos orgulhosos de que nossas fotos e vídeos retratam seres humanos reais em diferentes formas e tamanhos. Não somos contra o uso da IA, mas não achamos que ela deva ser usada para gerar pessoas ou realidades falsas.

Tecnologias como mídia sintética e DALL-E 2 podem ser fascinantes na superfície, mas também representam um risco real. Eles correm o risco de borrar as linhas entre o real e o falso, o que será uma ameaça fundamental à confiança entre os seres humanos.

É por isso que a JumpStory não usa inteligência artificial para gerar imagens falsas, mas usa IA para identificar quais imagens são originais, autênticas e – claro – legais para uso comercial.

Estas são as imagens que você encontra usando nosso serviço, e chamamos nossa abordagem de 'Inteligência Autêntica'.

Entendendo como as imagens de IA são geradas

Chega de JumpStory e das questões legais com DALL-E 2 por enquanto. Vejamos como as imagens de IA são geradas em plataformas como DALLE-2, Imagen, Crayion (anteriormente Dall-E Mini), Midjourney etc. … Usando DALLE-2 como o exemplo mais badalado atualmente.

Para começar, o DALLE-2 pode realizar diferentes tipos de tarefas, mas vamos nos concentrar na tarefa de geração de imagens neste blogpost.

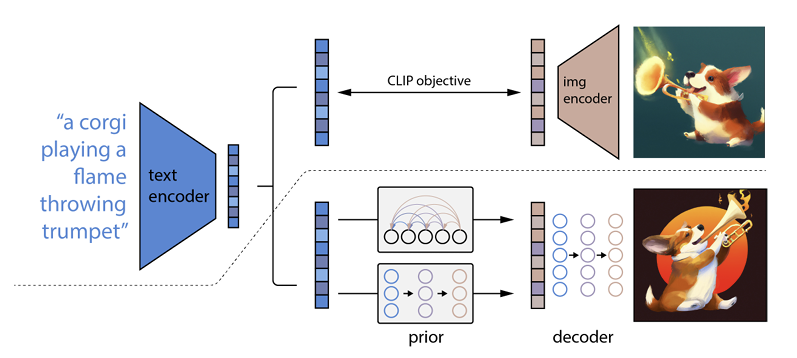

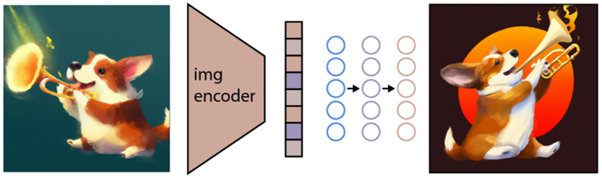

Como funciona é que um prompt de texto é inserido em um codificador de texto. Este codificador é treinado para mapear o prompt para um espaço de representação. Em seguida, um chamado modelo anterior mapeia o texto codificado para uma codificação de imagem correspondente que captura as informações semânticas do prompt de codificação de texto.

(Se isso já está ficando meio nerd, sinto muito, mas vai ficar ainda pior)

A etapa final para o codificador de imagem é gerar uma imagem que visualize a informação semântica que o codificador recebeu. Este é o básico de máquinas como Open AI.

A relação entre o texto e o visual

DALL-E 2 e tecnologias semelhantes são frequentemente chamadas de geradores de texto para imagem. A razão é sua capacidade de receber uma entrada de texto e entregar uma saída de imagem.

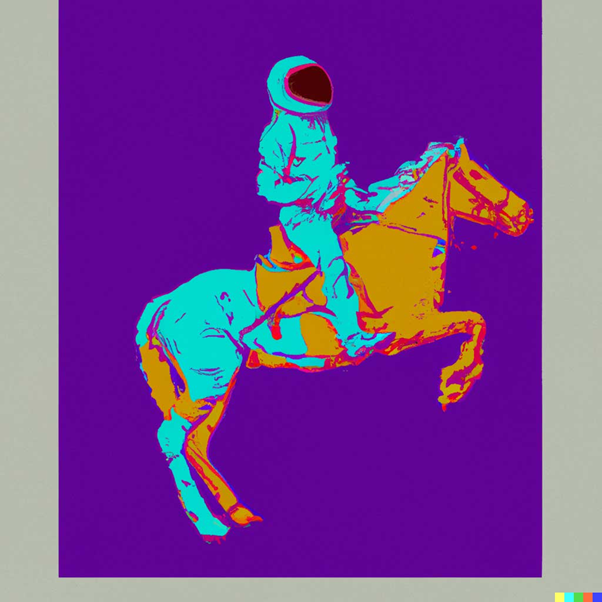

Para dar um exemplo, isso é “Um astronauta andando a cavalo no estilo de Andy Warhol:

fonte: DALLE-2

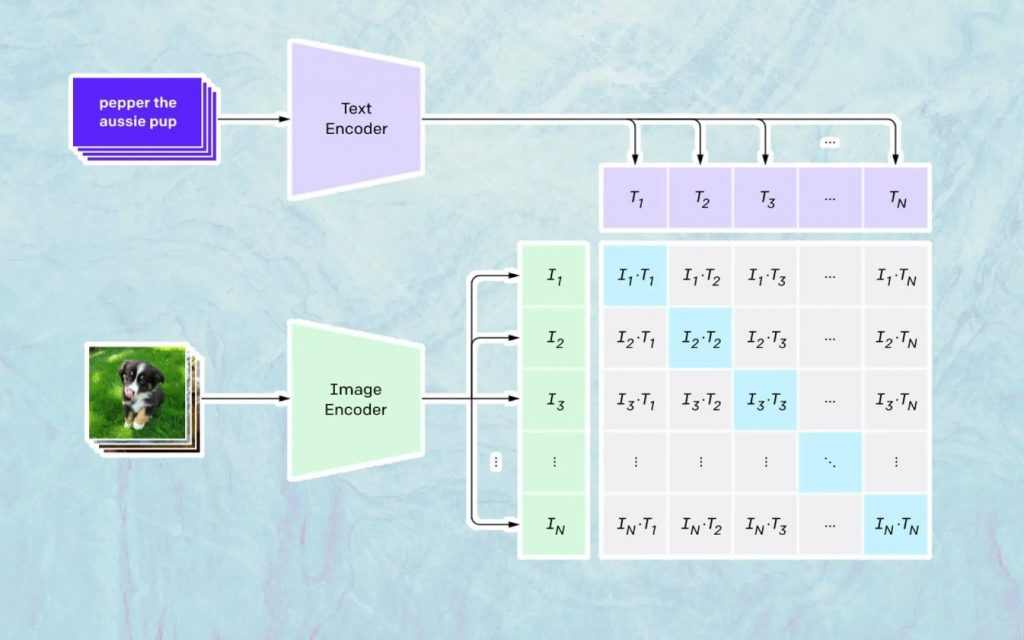

O que acontece aqui é baseado no modelo da Open AI chamado CLIP. CLIP é a abreviação de “Contrastive Language-Image Pre-training” e é um modelo muito complexo treinado em milhões de imagens e legendas.

O que o CLIP é especialmente bom é entender o quanto um determinado texto se relaciona com uma determinada imagem. A chave aqui não é a legenda, mas o quão relacionada uma determinada legenda está com uma determinada imagem.

Esse tipo de tecnologia é chamada de 'contrastiva', e o que o CLIP é capaz de fazer é aprender semântica a partir da linguagem natural. A forma como o CLIP aprendeu isso é através de um processo, onde o objetivo é (agora citando a documentação tecnológica): “simultaneamente maximizar a similaridade de cosseno entre N pares imagem/legenda codificada correta e minimizar a similaridade de cosseno entre N 2 – N imagem codificada incorretamente /caption pares.”

Gerando as imagens

Conforme descrito acima, o modelo CLIP aprende um espaço de representação no qual pode determinar como as codificações de imagens e textos estão relacionadas.

A próxima tarefa é usar este espaço para gerar imagens. Para isso, a Open AI desenvolveu outro modelo chamado GLIDE, que é capaz de usar a entrada do CLIP e – usando um modelo de difusão – realizar a geração da imagem.

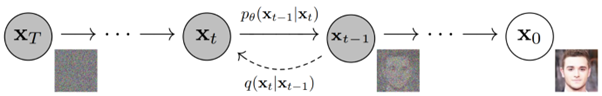

Para explicar brevemente o que é um modelo de difusão, é basicamente um modelo que aprende a gerar dados revertendo um processo gradual de ruído. Desculpe por isso agora se tornar muito técnico, então para citar uma descrição encontrada na documentação do Open AI:

“O processo de ruído é visto como uma cadeia de Markov parametrizada que gradualmente adiciona ruído a uma imagem para corrompê-la, eventualmente (assintoticamente) resultando em ruído gaussiano puro. O Modelo de Difusão aprende a navegar para trás ao longo dessa cadeia, removendo gradualmente o ruído ao longo de uma série de passos de tempo para reverter esse processo.”

Se você quiser se aprofundar ainda mais na tecnologia, recomendamos a leitura deste excelente artigo de Ryan O'Connor.