Generatywna sztuczna inteligencja w cyberbezpieczeństwie: przegląd

Opublikowany: 2024-03-01Generatywną sztuczną inteligencję definiuje się jako modele głębokiego uczenia się, które mogą tworzyć wysokiej jakości teksty, obrazy i inne treści w oparciu o dane, na których zostali przeszkoleni.

Gen AI prezentuje wiele zalet w przestrzeni cyfrowej. Godnym uwagi przykładem jest włączenie funkcji sztucznej inteligencji do aplikacji mobilnych, aby uczynić je bardziej wciągającymi.

W cyberbezpieczeństwie generatywna sztuczna inteligencja może analizować dane, identyfikować zagrożenia i rekomendować rozwiązania zapobiegające złośliwym atakom. W tym poście na blogu przyjrzymy się bliżej, w jaki sposób sztuczna inteligencja generacji może pomóc we wzmocnieniu środków cyberbezpieczeństwa.

Korzyści ze sztucznej inteligencji Gen w cyberbezpieczeństwie

Wykorzystanie generatywnej sztucznej inteligencji w biznesie niesie ze sobą ogromny potencjał. Jeśli chodzi o cyberbezpieczeństwo, sztuczna inteligencja generacji zapewnia niezwykłe korzyści, takie jak:

1. Ulepszone wykrywanie zagrożeń

Generacyjna sztuczna inteligencja może bezproblemowo obserwować i uczyć się wzorców w szerokim zakresie danych, umożliwiając specjalistom ds. cyberbezpieczeństwa ciągłą identyfikację i zrozumienie zagrożeń cyberbezpieczeństwa.

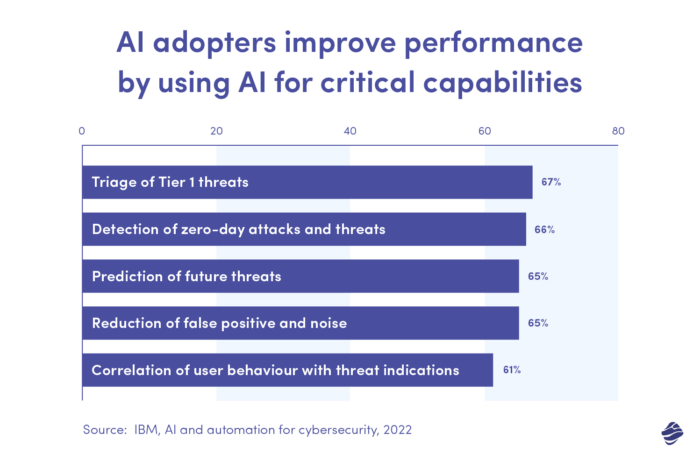

Z badań przeprowadzonych przez IBM wynika, że 66% użytkowników sztucznej inteligencji wykazało, że generatywna sztuczna inteligencja pomogła im przewidywać ataki i zagrożenia typu zero-day. Ataki dnia zerowego odnoszą się do nowszych zagrożeń, które tradycyjne systemy mogą przeoczyć.

Kolejne 65% stwierdziło, że sztuczna inteligencja generacji pomaga w korelacji zachowań użytkowników w celu wykrywania zagrożeń.

Dzięki sztucznej inteligencji generacji w cyberbezpieczeństwie znacznie łatwiej będzie zidentyfikować niewielkie różnice w zachowaniu, które mogą wskazywać na potencjalny atak. Na przykład sztuczna inteligencja generacji może automatycznie analizować nowe pliki i kod w celu wykrycia podejrzanych zachowań. Lub przeanalizuj treść e-maili, wzorce językowe i informacje o nadawcy, aby dokładnie zidentyfikować fałszywe e-maile.

2. Analityka predykcyjna

Sztuczna inteligencja generacji może dokładnie przewidywać przyszłe wyniki na podstawie analizy powtarzalnych wzorców w dużych zbiorach danych, takich jak dzienniki bezpieczeństwa, ruch sieciowy, analiza zagrożeń i tak dalej.

Na przykład sztuczna inteligencja generacji może analizować wzorce z poprzednich luk lub ataków i wykorzystywać je do przewidywania możliwych zagrożeń, które mogą pojawić się w przyszłości. Dzięki temu organizacje i zespoły ds. bezpieczeństwa mogą wdrożyć środki zapobiegające takim atakom.

3. Automatyczne odpowiedzi

W oparciu o wcześniej zaobserwowane wzorce i ataki, sztuczna inteligencja generacji może generować automatyczne reakcje na różne typy zagrożeń. Na przykład możesz uruchomić działania blokujące złośliwe adresy IP, dostosować reguły zapory sieciowej przed próbami włamań lub zapobiec rozprzestrzenianiu się złośliwego oprogramowania.

Wykorzystując generatywną sztuczną inteligencję w cyberbezpieczeństwie, możesz także generować automatyczne odpowiedzi w celu załatania luk w zabezpieczeniach przed atakiem lub przekierowania podejrzanego ruchu do Honeypotów w celu dalszego zbadania.

Dodatkowo Gen AI może automatycznie generować szczegółowe raporty po przeanalizowaniu logów bezpieczeństwa.

3 główne wyzwania i ryzyko związane ze stosowaniem generatywnej sztucznej inteligencji w cyberbezpieczeństwie

Oprócz korzyści istnieją potencjalne zagrożenia i wyzwania związane z wykorzystaniem sztucznej inteligencji generacji do celów cyberbezpieczeństwa. Obejmują one:

1. Obawy dotyczące prywatności danych

Szkolenie modeli generatywnych AI lub analizowanie istniejących danych zazwyczaj oznacza, że dostarczasz narzędziom AI wiele informacji ze swojej organizacji. W ten sposób możesz uzyskać dokładniejsze wyniki.

Istnieją jednak obawy dotyczące sposobu ochrony prywatności danych. Istnieje na przykład prawdopodobieństwo, że dane osobowe nie zostaną odpowiednio wykorzystane – szczególnie w przypadku zaniedbania wytycznych etycznych i praktyk w zakresie zarządzania danymi.

Ponadto modele sztucznej inteligencji generacji są tak dobre, jak dane, na których są trenowane. Jeśli zatem zostaną użyte tendencyjne dane, istnieje możliwość, że w modelu pominie się określone wzorce i będzie można uzyskać niedokładne lub stronnicze przewidywania. W cyberbezpieczeństwie może to oznaczać przeoczenie poszczególnych typów ataków lub niedocenianie niektórych zagrożeń.

2. Sztuczna inteligencja wykorzystywana w złośliwy sposób

Narzędzia AI generacji stają się coraz bardziej dostępne i niedrogie. W rezultacie jest on dostępny nie tylko dla legalnej firmy zajmującej się generatywnym rozwojem sztucznej inteligencji, ale może być również używany przez osoby fizyczne o złych zamiarach.

Na przykład hakerzy mogą z łatwością wykorzystać generatywną sztuczną inteligencję do tworzenia złośliwych kodów atakujących słabe protokoły bezpieczeństwa.

Ponadto generatywną sztuczną inteligencję można wykorzystać do tworzenia nowych i wyrafinowanych metod ataków, co utrudnia dotrzymanie kroku tradycyjnym środkom bezpieczeństwa.

Na przykład sztuczna inteligencja Gen. AI może tworzyć wysoce wiarygodne fałszywe e-maile lub strony internetowe, co utrudnia użytkownikom identyfikację i unikanie oszustw. Oznacza to, że niczego niepodejrzewający użytkownicy mogą zostać nakłonieni do podania poufnych informacji lub pobrania szkodliwych treści.

3. Zmiana pracy

Wydajność to jedna z największych zalet wykorzystania generatywnej sztucznej inteligencji w cyberbezpieczeństwie. Technologia ta może analizować ogromne ilości danych szybciej niż tradycyjne techniki cyberbezpieczeństwa.

Niestety oznacza to również, że sztuczna inteligencja może potencjalnie zastąpić tak wiele stanowisk pracy. W rzeczywistości raport Goldman Sachs wyjaśnia, że sztuczna inteligencja zastąpi 300 milionów stanowisk pracy poprzez automatyzację.

Eksperci ds. cyberbezpieczeństwa zajmujący się powtarzalnymi zadaniami, takimi jak wykrywanie zagrożeń i analiza złośliwego oprogramowania, prawdopodobnie jako pierwsi odczują automatyzację sztucznej inteligencji gen.

Jednak to nie koniec mroku i zagłady. Nadal potrzebna będzie specjalistyczna wiedza człowieka. Najlepszym rozwiązaniem, szczególnie dla specjalistów ds. cyberbezpieczeństwa, jest przekwalifikowanie lub podniesienie kwalifikacji. Jest to szczególnie istotne dla profesjonalistów zajmujących się zadaniami na poziomie podstawowym.

Na początek profesjonaliści będą musieli oswoić się z pracą ze sztuczną inteligencją. Po drugie, więcej organizacji będzie potrzebować ekspertów, którzy będą w stanie opracować solidne strategie cyberbezpieczeństwa, zoptymalizować systemy sztucznej inteligencji i nadzorować zarządzanie ryzykiem.

Zastosowania w świecie rzeczywistym i studia przypadków sztucznej inteligencji Gen w cyberbezpieczeństwie

Zanim przejdziemy dalej, przyjrzyjmy się pokrótce przykładom z życia codziennego i przypadkom użycia generatywnej sztucznej inteligencji w cyberbezpieczeństwie, gdzie integracja sztucznej inteligencji (AI) stała się kluczowym narzędziem o ogromnym potencjale. Sztuczna inteligencja ma liczne zastosowania w cyberbezpieczeństwie, które mogą pomóc we wzmocnieniu zabezpieczeń, usprawnieniu wykrywania zagrożeń i zwiększeniu odporności infrastruktury cyfrowej na stale zmieniające się zagrożenia cybernetyczne. Przyjrzyjmy się bliżej przykładom z życia wziętym, aby zrozumieć, w jaki sposób można je wykorzystać do ograniczenia zagrożeń cybernetycznych.

Google nie tylko wykorzystuje generatywną sztuczną inteligencję do ochrony przed zagrożeniami cybernetycznymi w swojej organizacji. Tworzy także rozwiązania generatywnej sztucznej inteligencji, aby pomóc innym organizacjom zrobić to samo.

Google ogłosił także uruchomienie inicjatyw związanych z cyberobroną, które pomagają poprawić cyberbezpieczeństwo. Jedną z takich inicjatyw jest SAIF – Secure AI Framework, z którego Google korzystał w procesie tworzenia oprogramowania.

SAIF to ramy koncepcyjne, których celem jest ochrona systemów AI przed zagrożeniami i atakami. Można go wykorzystać do zapobiegania zagrożeniom, takim jak kradzież określonego modelu sztucznej inteligencji, zatruwanie danych poprzez generatywne wyniki sztucznej inteligencji lub złośliwe dane wejściowe poprzez natychmiastowe wstrzykiwanie. SAIF jest również skuteczny w monitorowaniu wejść i wyjść w celu wykrywania zagrożeń i ochrony przed atakami poprzez automatyzację obrony.

Google zamierza także wypuścić Magikę, narzędzie cyberbezpieczeństwa służące do identyfikowania typów plików w celu wykrywania złośliwego oprogramowania. Firma Google z powodzeniem wykorzystała to narzędzie do ochrony swoich produktów, takich jak Dysk Google, Gmail i Bezpieczne przeglądanie.

PayPal

PayPal to międzynarodowa platforma płatnicza, która ułatwia transakcje sprzedawcom i klientom. Aby wdrożyć środki cyberbezpieczeństwa, PayPal szkoli zaawansowane modele uczenia maszynowego (ML) w celu wykrywania oszukańczych działań w czasie rzeczywistym.

Zazwyczaj sieć PayPal udostępnia ogromną ilość danych transakcyjnych, z których sztuczna inteligencja może się uczyć. Wyniki modelu ML można następnie wykorzystać do ulepszenia systemów uwierzytelniania i wychwytywania nieuczciwych działań. Model uczy się i dostosowuje w miarę powiększania się zbioru danych PayPal.

Holdingi ED&F Man

ED&F to firma zajmująca się handlem towarami, która z powodzeniem wykorzystała generatywną sztuczną inteligencję do wykrywania zagrożeń. Osiągnęli to za pomocą Cognito, platformy wykrywania zagrożeń AI firmy Vectra.

Firma ED&F dostarczyła szczegółowe informacje na temat swojej aktywności sieciowej, w tym komunikacji między urządzeniami, transferu danych i działań użytkowników. Cognito następnie wykorzystuje te dane do identyfikowania luk w zabezpieczeniach i podejrzanych zachowań w czasie rzeczywistym.

Według menedżera ds. cyberbezpieczeństwa w ED&F, Carmelo Gallo, Cognito odegrało kluczową rolę w pomaganiu w identyfikowaniu ryzykownych zachowań pracowników, takich jak nieautoryzowany zdalny dostęp do danych i plików. Firma ED&F odkryła także szkodliwe oprogramowanie służące do dowodzenia i kontroli, które przez długi czas pozostawało w ich systemie.

Generatywna sztuczna inteligencja a tradycyjne metody cyberbezpieczeństwa

Tradycyjne metody cyberbezpieczeństwa rozwijają się w oparciu o system oparty na regułach i ręczną analizę.

Systemy oparte na regułach zazwyczaj obejmują ustawienie predefiniowanych instrukcji, które mówią systemowi, na co ma uważać. Zwykle opiera się to na unikalnych wzorcach charakterystycznych dla popularnego złośliwego oprogramowania lub naruszeń bezpieczeństwa.

Gdy te reguły sygnalizują podejrzaną aktywność, zazwyczaj należy ręcznie ocenić i usunąć luki. Tradycyjne metody cyberbezpieczeństwa również w dużym stopniu zależą od interwencji człowieka i ciągłych aktualizacji.

W przeciwieństwie do tradycyjnych metod, które radzą sobie z dużymi bazami danych, sztuczna inteligencja generacji może ocenić ogromną porcję danych, umożliwiając jej wykrycie złożonych wzorców, które mógłby przeoczyć ludzki analityk. Pomaga to również w bardziej szczegółowym zrozumieniu luk w zabezpieczeniach.

Oprócz analizowania danych, generatywna sztuczna inteligencja może pomóc w tworzeniu rozwiązań potencjalnych zagrożeń — na przykład generując bezpieczne hasła lub projektując bardziej wydajne protokoły bezpieczeństwa. Jest więc bardziej proaktywny.

Choć sztuczna inteligencja okazuje się skuteczniejszym narzędziem do wdrażania silniejszych środków cyberbezpieczeństwa, zawsze konieczna będzie interwencja człowieka. Możesz więc wykorzystać mocne strony obu metod, aby uzyskać lepsze wyniki.

Możesz na przykład użyć tradycyjnych metod, aby zweryfikować przewidywania AI i zapewnić większą dokładność. Możesz także skorzystać z rekomendacji AI, aby ulepszyć skonfigurowane ręcznie konfiguracje.

7 pojawiających się trendów w sztucznej inteligencji i cyberbezpieczeństwie:

Generatywna sztuczna inteligencja w cyberbezpieczeństwie szybko ewoluuje. W tym artykule przyjrzymy się kilku pojawiającym się trendom, które mogą ukształtować przyszłość.

- Priorytetyzacja AI Cloud i bezpieczeństwa : obserwujemy integrację systemów AI z infrastrukturą chmurową. Powinno to ułatwić wykrywanie zagrożeń i zapobieganie im w czasie rzeczywistym.

- Rozwój narzędzi cyberbezpieczeństwa opartych na sztucznej inteligencji generacji : sztuczna inteligencja generacji będzie zaradna w tworzeniu fałszywych systemów lub pułapek miodu w celu oszukania cyberprzestępców. Zdolność tej technologii do analizowania ogromnych ilości danych i identyfikowania wzorców pomoże również w tworzeniu nowatorskich rozwiązań w zakresie cyberbezpieczeństwa.

- Nacisk na odporność cybernetyczną : zdolność sztucznej inteligencji do przewidywania i łatania luk w zabezpieczeniach zwiększy odporność systemów cyberbezpieczeństwa. Technologia ta pomoże naprawić słabe punkty, zanim atakujący będą mogli je wykorzystać.

- Coraz bardziej wyrafinowane cyberataki wspomagane przez sztuczną inteligencję generacji : sztuczna inteligencja generacji może ułatwiać ataki cybernetyczne na dużą skalę, co początkowo było bardzo trudne. Głębokie podróbki również stają się naprawdę dobre, zwiększając ryzyko inżynierii społecznej poprzez spersonalizowane kampanie phishingowe.

- Wykorzystanie automatyzacji opartej na sztucznej inteligencji umożliwiającej zespołom ds. cyberbezpieczeństwa uzyskiwanie lepszych informacji : sztuczna inteligencja ostatecznie przejmie czasochłonne zadania, takie jak przeglądanie dzienników oraz wykrywanie i analiza zagrożeń. Umożliwi to ekspertom skupienie się na bardziej strategicznych obowiązkach, takich jak podejmowanie decyzji i opracowywanie strategii cyberbezpieczeństwa.

Oprócz poprawy cyberbezpieczeństwa trend ten pokazuje, że przyszłość wymaga współpracy między ekspertami a systemami sztucznej inteligencji.

- Wzrost liczby specjalistycznych modeli językowych : Niedawna publikacja Światowego Forum Ekonomicznego sugeruje, że duże modele językowe są dość skuteczne w przetwarzaniu ogromnych ilości danych.

Jednak to szerokie zastosowanie może nie mieć zastosowania do wyspecjalizowanych dziedzin, takich jak cyberbezpieczeństwo. W rezultacie prawdopodobnie nastąpi przejście na mniejsze i bardziej wyspecjalizowane modele językowe, które umożliwią zespołom dostęp do bardziej precyzyjnych i przydatnych spostrzeżeń.

- Skoncentruj się na proaktywnym wykrywaniu zagrożeń : widzimy to Sztuczna inteligencja generacji wykorzystywana jest do zwiększania bezpieczeństwa aplikacji mobilnych poprzez skupienie się na proaktywnym wykrywaniu zagrożeń i reagowaniu w czasie rzeczywistym.

To jeden z rosnących trendów AI w aplikacjach mobilnych. Sztuczna inteligencja może obserwować zachowanie użytkowników w celu wykrycia osobliwości, które mogą wskazywać na naruszenie bezpieczeństwa. Niektóre przykłady obejmują nietypowe próby logowania lub inną podejrzaną aktywność.

Patrząc w przyszłość sztucznej inteligencji w cyberbezpieczeństwie, można śmiało przewidzieć, że pojawią się bardziej zaawansowane narzędzia i platformy umożliwiające zwalczanie stale rosnących zagrożeń nękających cyberprzestrzeń.

Jak wdrożyć sztuczną inteligencję Gen w cyberbezpieczeństwie

Włączenie generatywnej sztucznej inteligencji do strategii cyberbezpieczeństwa to niezwykły krok we właściwym kierunku. Konieczne jest jednak staranne planowanie i wdrażanie.

Dlatego podczas tej sesji przyjrzymy się kilku sposobom skutecznego wdrożenia sztucznej inteligencji generacji w cyberbezpieczeństwie:

- Zacznij od małego

Zamiast modernizować istniejący system bezpieczeństwa, rozważ rozpoczęcie od podstaw i stopniowe zwiększanie jego skali.

Zatem najpierw chcesz zidentyfikować przypadki użycia, które są bardziej wartościowe dla Twojej organizacji. Może to mieć na celu załatanie luk w zabezpieczeniach lub poprawę reakcji na ataki.

- Szkoluj pracowników i reguluj wykorzystanie sztucznej inteligencji

Następnie przeszkol swój zespół w zakresie korzystania z Gen AI do wykrywania problemów i interpretacji wyników. Następnie można stopniowo wdrażać narzędzia bezpieczeństwa oparte na sztucznej inteligencji do takich zadań, jak wykrywanie zagrożeń w czasie rzeczywistym i reagowanie na incydenty.

Chcesz także zaktualizować swoje zasady i przepisy dotyczące bezpieczeństwa, aby promować korzystanie z narzędzi AI. Na przykład pokaż pracownikom przykłady tego, co jest dopuszczalne w przypadku korzystania z generatywnych narzędzi sztucznej inteligencji w środkach cyberbezpieczeństwa.

Ze względu na możliwość niewłaściwego wykorzystania narzędzi AI i wynikające z tego zagrożenia bezpieczeństwa zaleca się wdrożenie środków koordynujących sposób wykorzystania sztucznej inteligencji Gen w Twojej organizacji. Możesz na przykład ograniczyć użycie tylko do narzędzi sprawdzonych i zatwierdzonych przez Twój dział IT.

- Wybierz odpowiednią technologię AI

W strategii cyberbezpieczeństwa możesz wykorzystać różne technologie sztucznej inteligencji. Oto kilka przykładów:

Uczenie maszynowe (ML) , które wykorzystuje algorytmy do uczenia się na podstawie danych i przewidywania. Jest to przydatne, jeśli chcesz wykrywać zagrożenia i przewidywać podatności.

Przetwarzanie języka naturalnego (NLP) – skupia się na rozumieniu i manipulowaniu ludzkim językiem. Przydatne w procesach bezpieczeństwa, takich jak analizowanie wiadomości e-mail lub dzienników bezpieczeństwa i automatyzacja reakcji na incydenty.

Następnie dysponujemy systemami wykrywania anomalii (ADS) , które identyfikują odchylenia od standardowych wzorców danych. ADS może wykryć włamania do sieci, nietypowe zachowania użytkowników lub aktywność złośliwego oprogramowania.

Wskazane jest, aby używać technologii, która rozwiązuje określone problemy bezpieczeństwa, na które jesteś ukierunkowany.

- Korzystaj z danych wysokiej jakości

Zainwestuj w gromadzenie i przygotowywanie wysokiej jakości, bezstronnych danych dostosowanych do Twoich potrzeb. W idealnym przypadku powinny to być dane istotne dla Twojego przypadku użycia i krajobrazu zagrożeń. Chcesz także używać różnorodnych odmian danych, aby uniknąć stronniczości wyników.

Rozważ użycie symulowanych danych zamiast wszelkich informacji, które mogą być wrażliwe. Pamiętaj o zabezpieczeniu przechowywania danych i kontroli dostępu, aby chronić poufne informacje.

- Monitoruj i dostosowuj się

Wreszcie, zagrożenia cybernetyczne stale ewoluują, więc Twoja implementacja GenAI również musi się dostosować. Regularnie monitoruj jego działanie, aktualizuj dane i modele oraz odpowiadaj na pojawiające się wyzwania.

Możesz także nawiązać współpracę z firmą świadczącą usługi generatywnej sztucznej inteligencji w celu efektywniejszego wdrożenia.

Względy regulacyjne i etyczne

Rosnące wykorzystanie sztucznej inteligencji generacji stwarza potrzebę wdrożenia przepisów, zwłaszcza dotyczących etycznego przyjęcia i ujawniania zagrożeń. W idealnym przypadku wykorzystanie narzędzi sztucznej inteligencji powinno mieścić się w wytycznych ustalonych przez istniejące organy regulacyjne.

Przepisy takie jak RODO (ogólne rozporządzenie o ochronie danych) i CCPA (kalifornijska ustawa o ochronie prywatności konsumentów) ustanowiły standardy w zakresie prywatności użytkowników i ochrony danych za pomocą modeli cyberbezpieczeństwa AI. Niektóre z nich obejmują:

- Zbieraj i wykorzystuj wyłącznie dane, które są niezbędne do konkretnych i zgodnych z prawem celów.

- Wdrażaj skuteczne środki ochrony danych użytkowników.

- Podaj informacje, które pomogą użytkownikom zrozumieć, jak działają platformy AI.

W jednym badaniu zwrócono również uwagę na dobrze znane ramy, które kierują etycznym przyjęciem sztucznej inteligencji. Należą do nich uczciwość, przejrzystość, odpowiedzialność i solidność.

Uczciwość – obejmuje zapewnienie, że technologia sztucznej inteligencji jest uczciwa i bezstronna – szczególnie w przypadku danych, na podstawie których sztuczna inteligencja jest szkolona. Wiąże się to z podjęciem działań mających na celu zapobieganie wszelkim formom dyskryminacji ze względu na takie czynniki, jak płeć, wiek lub status społeczno-ekonomiczny.

Przejrzystość i odpowiedzialność wymagają, aby dostawcy platform AI podawali prawdę na temat działania systemów AI. Muszą także ponosić odpowiedzialność za błędy lub problemy napotkane podczas korzystania z rozwiązań AI. Użytkownicy muszą wiedzieć, w jaki sposób ich dane są wykorzystywane lub przechowywane.

Solidność podkreśla potrzebę budowania systemów sztucznej inteligencji, które są niezawodne, bezpieczne i odporne na błędy.

Istnieje również projekt skoncentrowany na człowieku, który promuje budowanie systemów sztucznej inteligencji z myślą o potrzebach ludzi, zamiast skupiać się na szczegółach technicznych.

Ekspertyzy i prognozy dotyczące wykorzystania Gen AI w cyberbezpieczeństwie

Co zatem eksperci ds. cyberbezpieczeństwa mówią na temat generatywnej sztucznej inteligencji w cyberbezpieczeństwie?

Kunle Fadeyi, członek Rady Technologicznej magazynu Forbes, zgadza się, że sztuczna inteligencja rewolucjonizuje cyberbezpieczeństwo, zapewniając proaktywne środki bezpieczeństwa, które mogą pomóc chronić przed cyberatakami. Nazywa to „bezpieczeństwem od samego początku”, które zazwyczaj polega na identyfikowaniu i zamykaniu luk w zabezpieczeniach, które cyberprzestępcy mogą próbować wykorzystać.

Mike Lieberman, CTO i współzałożyciel Kusari również przewiduje, że sztuczna inteligencja pomoże firmom zająć się cyberbezpieczeństwem, umożliwiając im wykrycie złych wzorców bezpieczeństwa w danym kodzie lub konfiguracji. Według Liebermana sztuczna inteligencja zapewni wskazówki w bardziej złożonych scenariuszach bezpieczeństwa. Narzędzia sztucznej inteligencji należy jednak wykorzystywać wyłącznie jako sygnały, a nie decydentów.

Wreszcie, ekspert ds. bezpieczeństwa cybernetycznego i dyrektor generalny Logpoint, Jesper Zerlang, zaleca organizacjom włączenie strategii cyberbezpieczeństwa do ogólnych celów biznesowych. Dzieje się tak dlatego, że ryzyko cyberataków prawdopodobnie wzrośnie, ponieważ przedsiębiorstwa będą polegać na procesach cyfrowych.

Połączenie cyberbezpieczeństwa z celami biznesowymi zapewni organizacjom możliwość proaktywnej ochrony cennych zasobów biznesowych i budowania zaufania interesariuszy.

Na zakończenie: jak wykorzystać sztuczną inteligencję Gen do cyberbezpieczeństwa

Wraz z rozwojem technologii zagrożenia i potencjalne ataki również w dalszym ciągu nasycają przestrzeń cyfrową. Powoduje to potrzebę bardziej zaawansowanych podejść do identyfikacji i ochrony przedsiębiorstw i użytkowników przed złośliwymi działaniami cybernetycznymi. To prowadzi nas do konieczności uzupełnienia tradycyjnych środków bezpieczeństwa metodami generatywnymi AI.

Dzisiaj widzieliśmy, jak sztuczna inteligencja Gen zapewnia szybszy i skuteczniejszy sposób identyfikowania zagrożeń, przewidywania problemów związanych z bezpieczeństwem i automatyzowania reakcji na incydenty. Przyjrzeliśmy się również skutecznym sposobom wdrożenia Gen AI w środkach cyberbezpieczeństwa. Obejmują one identyfikację konkretnych przypadków użycia, wybór odpowiedniej technologii, szkolenie pracowników i ciągłe monitorowanie środków bezpieczeństwa.

Należy również wziąć pod uwagę względy etyczne związane z wykorzystaniem sztucznej inteligencji gen. do celów cyberbezpieczeństwa oraz pojawiające się trendy w zakresie cyberbezpieczeństwa związane ze sztuczną inteligencją.

Ogólnie rzecz biorąc, mamy nadzieję, że ten przewodnik pokazał Ci, jak sztuczna inteligencja może pomóc poprawić Twój poziom bezpieczeństwa. Skorzystaj z tych spostrzeżeń, aby wdrożyć solidne ramy cyberbezpieczeństwa w swojej organizacji.