L’intelligenza artificiale generativa nella sicurezza informatica: una panoramica

Pubblicato: 2024-03-01L’intelligenza artificiale generativa è definita come modelli di deep learning in grado di creare testi, immagini e altri contenuti di alta qualità sulla base dei dati su cui sono stati addestrati.

La Gen AI presenta molti vantaggi nello spazio digitale. Un esempio notevole è l’inclusione di funzionalità AI nelle app mobili per renderle più coinvolgenti.

Nella sicurezza informatica, l’intelligenza artificiale generativa può analizzare dati, identificare minacce e consigliare soluzioni per prevenire attacchi dannosi. In questo post del blog approfondiremo il modo in cui la Gen AI può contribuire a rafforzare le misure di sicurezza informatica.

Vantaggi dell’intelligenza artificiale nella sicurezza informatica

L’uso dell’intelligenza artificiale generativa negli affari presenta molte potenzialità. Per quanto riguarda la sicurezza informatica, la Gen AI offre notevoli vantaggi come:

1. Rilevamento delle minacce migliorato

L’intelligenza artificiale generativa può osservare e apprendere senza problemi modelli in una vasta gamma di dati, consentendo ai professionisti della sicurezza informatica di identificare e comprendere continuamente le minacce alla sicurezza informatica.

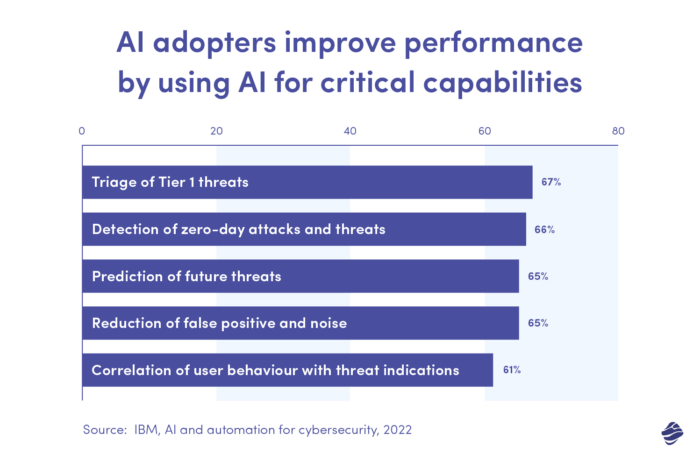

In una ricerca condotta da IBM, il 66% di coloro che hanno adottato l’intelligenza artificiale ha rivelato che l’intelligenza artificiale generativa li ha aiutati a prevedere attacchi e minacce zero-day. Gli attacchi zero-day si riferiscono a minacce più recenti che i sistemi tradizionali potrebbero non rilevare.

Un altro 65% ha affermato che la Gen AI aiuta con la correlazione del comportamento degli utenti per rilevare le minacce.

Con la Gen AI nella sicurezza informatica, sarà molto più semplice identificare lievi variazioni comportamentali che potrebbero indicare un potenziale attacco. Ad esempio, la Gen AI può analizzare automaticamente nuovi file e codici per rilevare comportamenti sospetti. Oppure analizza il contenuto delle email, i modelli linguistici e le informazioni del mittente per identificare accuratamente le email false.

2. Analisi predittiva

La Gen AI può fare previsioni accurate sui risultati futuri sulla base di un’analisi di modelli ripetitivi in grandi set di dati come log di sicurezza, traffico di rete, intelligence sulle minacce e così via.

Ad esempio, la Gen AI può analizzare modelli di vulnerabilità o attacchi precedenti e utilizzarli per prevedere possibili minacce che potrebbero presentarsi in futuro. Ciò consente alle organizzazioni e ai team di sicurezza di implementare misure per prevenire tali attacchi.

3. Risposte automatizzate

Sulla base di modelli e attacchi precedentemente osservati, la Gen AI può generare risposte automatizzate per diversi tipi di minacce. Ad esempio, puoi attivare azioni che bloccano indirizzi IP dannosi, regolano le regole del firewall contro i tentativi di intrusione o impediscono la diffusione di malware.

Utilizzando l’intelligenza artificiale generativa nella sicurezza informatica, puoi anche generare risposte automatizzate per correggere le vulnerabilità della sicurezza prima di un attacco o reindirizzare il traffico sospetto agli honeypot per ulteriori indagini.

Inoltre, Gen AI può generare automaticamente report dettagliati dopo aver analizzato i registri di sicurezza.

3 principali sfide e rischi legati all’utilizzo dell’intelligenza artificiale generativa nella sicurezza informatica

Oltre ai vantaggi, ci sono potenziali rischi e sfide associati all’utilizzo della Gen AI per la sicurezza informatica. Questi includono:

1. Preoccupazioni sulla privacy dei dati

Formare modelli di intelligenza artificiale generativa o analizzare dati esistenti di solito significa fornire agli strumenti di intelligenza artificiale molte informazioni provenienti dalla propria organizzazione. È così che puoi ottenere risultati più accurati.

Tuttavia, c'è una preoccupazione su come viene protetta la privacy dei tuoi dati. Ad esempio, esiste la possibilità che le informazioni personali vengano utilizzate in modo improprio se lasciate senza controllo, soprattutto laddove le linee guida etiche e le pratiche di governance dei dati vengono trascurate.

Inoltre, la validità dei modelli Gen AI è pari a quella dei dati su cui sono stati addestrati. Pertanto, se vengono utilizzati dati distorti, esiste la possibilità che il modello tralasci modelli specifici e faccia previsioni imprecise o distorte. Nella sicurezza informatica, ciò potrebbe significare trascurare particolari tipi di attacchi o sottovalutare determinate minacce.

2. L'intelligenza artificiale viene utilizzata in modo dannoso

Gli strumenti di Gen AI stanno diventando sempre più accessibili e convenienti. Di conseguenza, non solo è accessibile a una società legittima di sviluppo di intelligenza artificiale generativa, ma può anche essere utilizzato da individui con intenzioni dannose.

Ad esempio, gli hacker possono facilmente utilizzare l’intelligenza artificiale generativa per creare codici dannosi che prendono di mira protocolli di sicurezza deboli.

Inoltre, l’intelligenza artificiale generativa può essere utilizzata per creare metodi di attacco nuovi e sofisticati, rendendo più difficile tenere il passo con le misure di sicurezza tradizionali.

Ad esempio, la Gen AI può creare e-mail o siti Web falsi altamente credibili, rendendo più difficile per gli utenti identificare ed evitare le truffe. Ciò significa che utenti ignari potrebbero essere indotti a fornire informazioni sensibili o a scaricare contenuti dannosi.

3. Spostamento di posti di lavoro

L’efficienza è uno dei maggiori punti di forza dell’utilizzo dell’intelligenza artificiale generativa nella sicurezza informatica. Questa tecnologia può analizzare grandi quantità di dati più velocemente rispetto alle tradizionali tecniche di sicurezza informatica.

Sfortunatamente, questo significa anche che l’intelligenza artificiale può potenzialmente sostituire tanti posti di lavoro. Un rapporto di Goldman Sachs spiega infatti che l’intelligenza artificiale sostituirà 300 milioni di posti di lavoro attraverso l’automazione.

Gli esperti di sicurezza informatica che gestiscono attività ripetitive come il rilevamento delle minacce e l’analisi del malware saranno probabilmente i primi a essere colpiti dall’automazione della generazione AI.

Non è tutto buio e rovina, però. Sarà ancora necessaria la competenza umana. La soluzione migliore, soprattutto per i professionisti della sicurezza informatica, è riqualificarsi o migliorare le competenze. Ciò è particolarmente cruciale per i professionisti che gestiscono attività entry-level.

Per cominciare, i professionisti dovranno sentirsi a proprio agio lavorando insieme all’intelligenza artificiale. In secondo luogo, sempre più organizzazioni avranno bisogno di esperti umani in grado di elaborare solide strategie di sicurezza informatica, ottimizzare i sistemi di intelligenza artificiale e supervisionare la gestione del rischio.

Applicazioni del mondo reale e casi di studio dell'intelligenza artificiale nella sicurezza informatica

Prima di proseguire, esaminiamo brevemente gli esempi del mondo reale e i casi d’uso dell’intelligenza artificiale generativa nella sicurezza informatica, dove l’integrazione dell’intelligenza artificiale (AI) è diventata uno strumento cruciale con un potenziale immenso. L’intelligenza artificiale ha numerose applicazioni nella sicurezza informatica che possono aiutare a rafforzare le difese, migliorare il rilevamento delle minacce e aumentare la resilienza delle infrastrutture digitali contro le minacce informatiche in continua evoluzione. Analizziamo più a fondo esempi di vita reale per capire come può essere utilizzato per mitigare i rischi informatici.

Google non utilizza solo l’intelligenza artificiale generativa per proteggersi dalle minacce informatiche nella propria organizzazione. Crea inoltre soluzioni di intelligenza artificiale generativa per aiutare altre organizzazioni a fare lo stesso.

Google ha inoltre annunciato il lancio di iniziative di difesa informatica che aiutano a migliorare la sicurezza informatica. Una di queste iniziative è SAIF – Secure AI Framework, che Google ha utilizzato nel suo processo di sviluppo software.

SAIF è un quadro concettuale che mira a proteggere i sistemi di intelligenza artificiale da minacce e attacchi. Può essere utilizzato per affrontare rischi come il furto di un particolare modello di intelligenza artificiale, l’avvelenamento dei dati attraverso output di intelligenza artificiale generativa o input dannosi tramite iniezioni tempestive. SAIF è efficace anche per monitorare input e output per rilevare minacce e proteggersi dagli attacchi automatizzando le difese.

Inoltre, Google intende rilasciare Magika, uno strumento di sicurezza informatica per identificare i tipi di file per rilevare malware. Google ha utilizzato con successo questo strumento per proteggere i suoi prodotti come Google Drive, Gmail e Navigazione sicura.

PayPal

PayPal è una piattaforma di pagamento internazionale che semplifica le transazioni per commercianti e clienti. Per implementare misure di sicurezza informatica, PayPal addestra modelli avanzati di Machine Learning (ML) per rilevare attività fraudolente in tempo reale.

In genere, la rete di PayPal fornisce una grande quantità di dati sulle transazioni da cui l'intelligenza artificiale può imparare. I risultati del modello ML possono quindi essere utilizzati per migliorare i sistemi di autenticazione e individuare attività fraudolente. Il modello continua ad apprendere e ad adattarsi man mano che il set di dati di PayPal cresce.

ED&F Man Holdings

ED&F è un trader di materie prime che ha utilizzato con successo l'intelligenza artificiale generativa per il rilevamento delle minacce. Hanno raggiunto questo obiettivo utilizzando Cognito, una piattaforma di rilevamento delle minacce AI di Vectra.

ED&F ha fornito informazioni dettagliate sulla sua attività di rete, inclusa la comunicazione tra dispositivi, trasferimenti di dati e azioni degli utenti. Cognito utilizza quindi questi dati per identificare vulnerabilità e comportamenti sospetti in tempo reale.

Secondo Carmelo Gallo, responsabile della sicurezza informatica di ED&F, Cognito ha svolto un ruolo chiave nell'aiutare a identificare comportamenti rischiosi dei dipendenti come l'accesso remoto non autorizzato a dati e file. ED&F ha anche scoperto un malware di comando e controllo che persisteva nel loro sistema da molto tempo.

IA generativa vs metodi tradizionali di sicurezza informatica

I metodi tradizionali di sicurezza informatica prosperano su un sistema basato su regole e sull’analisi manuale.

I sistemi basati su regole in genere implicano l'impostazione di istruzioni predefinite che indicano al sistema cosa tenere d'occhio. Questo di solito si basa su modelli unici esibiti da malware popolari o violazioni della sicurezza.

Quando queste regole segnalano attività sospette, in genere è necessario valutare e risolvere manualmente le vulnerabilità. Anche i metodi tradizionali di sicurezza informatica dipendono in larga misura dall’intervento umano e da aggiornamenti costanti.

A differenza dei metodi tradizionali che hanno difficoltà con database di grandi dimensioni, la Gen AI può valutare un’enorme quantità di dati, consentendole di rilevare modelli complessi che un analista umano potrebbe non notare. Questo ti aiuta anche a comprendere le vulnerabilità in modo più dettagliato.

Oltre ad analizzare i dati, l’intelligenza artificiale generativa può aiutare a creare soluzioni a potenziali minacce, ad esempio generando password sicure o progettando protocolli di sicurezza più efficienti. Quindi è più proattivo.

Sebbene l’intelligenza artificiale si dimostri uno strumento più efficace per attuare misure di sicurezza informatica più forti, l’intervento umano sarà sempre necessario. Quindi, puoi sfruttare i punti di forza di entrambi i metodi per ottenere risultati migliori.

Ad esempio, puoi utilizzare metodi tradizionali per verificare le previsioni fatte dall’intelligenza artificiale e garantire una migliore precisione. Puoi anche utilizzare i consigli dell'intelligenza artificiale per migliorare le configurazioni manuali che hai impostato.

7 tendenze emergenti nell’intelligenza artificiale e nella sicurezza informatica:

L’intelligenza artificiale generativa nella sicurezza informatica è in rapida evoluzione. Qui esploriamo diverse tendenze emergenti che potrebbero modellare il futuro.

- Priorità al cloud AI e alla sicurezza : stiamo assistendo a un'integrazione tra i sistemi AI e l'infrastruttura cloud. Ciò dovrebbe facilitare il rilevamento e la prevenzione delle minacce in tempo reale.

- Espansione degli strumenti di sicurezza informatica basati sulla generazione AI : la generazione AI sarà piena di risorse nella creazione di sistemi falsi o honeypot per ingannare gli aggressori informatici. La capacità della tecnologia di analizzare grandi quantità di dati e identificare modelli aiuterà anche a creare nuove soluzioni di sicurezza informatica.

- Enfasi sulla resilienza informatica : la capacità dell’intelligenza artificiale di prevedere e correggere le vulnerabilità vedrà una migliore resilienza dei sistemi di sicurezza informatica. La tecnologia aiuterà a correggere i punti deboli prima che gli aggressori possano sfruttarli.

- Attacchi informatici sempre più sofisticati facilitati dalla Gen AI : la Gen AI può facilitare attacchi informatici su larga scala, cosa che inizialmente era molto impegnativa. Anche i deep fake stanno diventando davvero efficaci, aumentando il rischio di ingegneria sociale attraverso campagne di phishing personalizzate.

- Utilizzo dell'automazione basata sull'intelligenza artificiale che consente ai team di sicurezza informatica di ottenere informazioni migliori : l'intelligenza artificiale finirà per farsi carico di attività che richiedono molto tempo, come la revisione dei registri, nonché il rilevamento e l'analisi delle minacce. Ciò consentirà agli esperti umani di concentrarsi su compiti più strategici come il processo decisionale e lo sviluppo di strategie di sicurezza informatica.

Oltre a migliorare la sicurezza informatica, questa tendenza mostra che il futuro richiede la collaborazione tra esperti umani e sistemi di intelligenza artificiale.

- Aumento dei modelli linguistici specializzati : una recente pubblicazione del World Economic Forum suggerisce che i modelli linguistici di grandi dimensioni sono stati piuttosto efficaci nell’elaborazione di grandi quantità di dati.

Tuttavia, questo ampio utilizzo potrebbe non applicarsi a settori specializzati come la sicurezza informatica. Di conseguenza, probabilmente assisteremo a una transizione verso modelli linguistici più piccoli e specializzati, che possono consentire ai team di accedere a informazioni più precise e utilizzabili.

- Focus sul rilevamento proattivo delle minacce : stiamo vedendo L'intelligenza artificiale di generazione viene utilizzata per migliorare la sicurezza delle applicazioni mobili concentrandosi sul rilevamento proattivo delle minacce e sulle risposte in tempo reale.

Questa è una delle tendenze crescenti dell’intelligenza artificiale nelle app mobili. L’intelligenza artificiale può osservare il comportamento degli utenti per rilevare stranezze che potrebbero indicare una violazione della sicurezza. Alcuni esempi includono tentativi di accesso insoliti o altre attività sospette.

Guardando al futuro dell’intelligenza artificiale nella sicurezza informatica, è lecito prevedere che ci saranno strumenti e piattaforme più avanzati per colpire le minacce sempre crescenti che affliggono il cyberspazio.

Come implementare la generazione AI nella sicurezza informatica

Integrare l’intelligenza artificiale generativa nella tua strategia di sicurezza informatica è un passo notevole nella giusta direzione. Tuttavia, è necessaria un’attenta pianificazione e attuazione.

Quindi, in questa sessione, esamineremo alcuni modi per implementare in modo efficace la Gen AI nella sicurezza informatica:

- Inizia in piccolo

Invece di rivedere il tuo sistema di sicurezza esistente, valuta la possibilità di iniziare dalle basi e ampliarlo con il tempo.

Pertanto, devi prima identificare i casi d'uso che sono più preziosi per la tua organizzazione. Questo potrebbe essere necessario per correggere le vulnerabilità o migliorare le risposte agli attacchi.

- Formare i dipendenti e regolamentare l'utilizzo dell'intelligenza artificiale

Successivamente, forma il tuo team su come utilizzare la Gen AI per rilevare i problemi e come interpretare i risultati. Quindi, puoi adottare gradualmente strumenti di sicurezza basati sull'intelligenza artificiale per attività come il rilevamento delle minacce in tempo reale e le risposte agli incidenti.

Vuoi anche aggiornare le tue politiche e normative sulla sicurezza per promuovere l'uso degli strumenti di intelligenza artificiale. Ad esempio, mostra ai dipendenti esempi di ciò che è accettabile quando si utilizzano strumenti di intelligenza artificiale generativa nelle misure di sicurezza informatica.

A causa della possibilità di un uso improprio degli strumenti di intelligenza artificiale e dei rischi per la sicurezza che potrebbero derivarne, è consigliabile adottare misure per coordinare il modo in cui la Gen AI viene utilizzata nella propria organizzazione. Ad esempio, puoi limitare l'utilizzo solo agli strumenti controllati e approvati dal tuo reparto IT.

- Scegli la giusta tecnologia AI

Esistono varie tecnologie di intelligenza artificiale che puoi utilizzare nella tua strategia di sicurezza informatica. Alcuni esempi includono:

Machine Learning (ML) , che utilizza algoritmi per apprendere dai dati e fare previsioni. È utile se desideri rilevare minacce e prevedere vulnerabilità.

Natural Language Processing (NLP) : si concentra sulla comprensione e manipolazione del linguaggio umano. Utile per processi di sicurezza come l'analisi di e-mail o registri di sicurezza e l'automazione delle risposte agli incidenti.

Poi abbiamo i sistemi di rilevamento delle anomalie (ADS) , che identificano le deviazioni dai modelli di dati standard. ADS è in grado di rilevare intrusioni di rete, comportamenti insoliti degli utenti o attività malware.

È consigliabile utilizzare la tecnologia che risolve i problemi di sicurezza specifici a cui ti rivolgi.

- Utilizza dati di alta qualità

Investi nella raccolta e nella preparazione di dati imparziali e di alta qualità specifici per le tue esigenze. Idealmente, questi dovrebbero essere dati rilevanti per il tuo caso d’uso e il panorama delle minacce. Vuoi anche utilizzare diverse variazioni dei dati per evitare distorsioni nell'output.

Prendi in considerazione l'utilizzo di dati simulati al posto di qualsiasi informazione che potrebbe essere sensibile. Assicurati di proteggere l'archiviazione dei dati e i controlli di accesso per proteggere le informazioni sensibili.

- Monitorare e adattarsi

Infine, le minacce informatiche sono in continua evoluzione, quindi anche la tua implementazione GenAI deve adattarsi. Monitorare regolarmente le sue prestazioni, aggiornare dati e modelli e affrontare eventuali sfide emergenti.

Puoi anche collaborare con un'azienda che fornisce servizi di intelligenza artificiale generativa per un'implementazione più efficiente.

Considerazioni normative ed etiche

Il crescente utilizzo dell’intelligenza artificiale generatrice rende necessaria l’implementazione di normative, soprattutto per quanto riguarda l’adozione etica e la rivelazione dei rischi. Idealmente, l’uso degli strumenti di intelligenza artificiale dovrebbe rientrare nelle linee guida stabilite dagli organismi di regolamentazione esistenti.

Leggi come il GDPR (Regolamento generale sulla protezione dei dati) e il CCPA (California Consumer Privacy Act) hanno stabilito gli standard per la privacy degli utenti e la protezione dei dati con modelli di sicurezza informatica basati sull’intelligenza artificiale. Alcuni di questi includono:

- Raccogliere e utilizzare solo i dati necessari per scopi specifici e legittimi.

- Implementare misure efficaci per salvaguardare i dati degli utenti.

- Fornire informazioni che aiutino gli utenti a comprendere come funzionano le piattaforme di intelligenza artificiale.

Uno studio evidenzia anche quadri ben noti che guidano l’adozione etica dell’IA. Includono equità, trasparenza, responsabilità e robustezza.

Equità : ciò implica garantire che la tecnologia dell’intelligenza artificiale sia giusta e imparziale, soprattutto con i dati con cui viene addestrata l’intelligenza artificiale. Ciò comporta l’adozione di misure per prevenire qualsiasi forma di discriminazione basata su fattori quali sesso, età o condizione socioeconomica.

La trasparenza e la responsabilità richiedono che i fornitori di piattaforme di intelligenza artificiale siano sinceri su come funzionano i sistemi di intelligenza artificiale. Devono inoltre essere responsabili degli errori o dei problemi riscontrati utilizzando queste soluzioni di intelligenza artificiale. Gli utenti devono comprendere come vengono utilizzati o archiviati i loro dati.

La robustezza evidenzia la necessità di costruire sistemi di intelligenza artificiale affidabili, sicuri e resistenti agli errori.

C'è anche il design centrato sull'uomo, che promuove la costruzione di sistemi di intelligenza artificiale tenendo conto dei bisogni umani invece di concentrarsi su aspetti tecnici.

Opinioni e previsioni degli esperti sull'utilizzo della Gen AI per la sicurezza informatica

Quindi, cosa dicono gli esperti di sicurezza informatica sull’intelligenza artificiale generativa nella sicurezza informatica?

Kunle Fadeyi, membro del Forbes Technology Council, concorda sul fatto che l’intelligenza artificiale sta rivoluzionando la sicurezza informatica fornendo misure di sicurezza proattive che possono aiutare a proteggere dagli attacchi informatici. Lo chiama "sicurezza fin dalla progettazione", che in genere implica l'identificazione e la chiusura delle lacune di sicurezza che i criminali informatici potrebbero tentare di sfruttare.

Mike Lieberman, CTO e co-fondatore di Kusari, prevede inoltre che l’intelligenza artificiale aiuterà le aziende ad affrontare la sicurezza informatica consentendo loro di rilevare modelli di sicurezza errati in un determinato codice o configurazione. Secondo Lieberman, l’intelligenza artificiale fornirà una guida negli scenari di sicurezza più complessi. Tuttavia, gli strumenti di intelligenza artificiale dovrebbero essere utilizzati solo come segnali e non come decisori.

Infine, Jesper Zerlang, esperto di sicurezza informatica e CEO di Logpoint, raccomanda alle organizzazioni di integrare le strategie di sicurezza informatica negli obiettivi aziendali generali. Questo perché il rischio di attacchi informatici probabilmente aumenterà poiché le aziende si affidano ai processi digitali.

Integrare la sicurezza informatica negli obiettivi aziendali garantirà che le organizzazioni possano proteggere in modo proattivo risorse aziendali preziose e rafforzare la fiducia delle parti interessate.

In chiusura: come utilizzare la generazione AI per la sicurezza informatica

Con l’evolversi della tecnologia, anche le minacce e i potenziali attacchi continuano a saturare lo spazio digitale. Ciò comporta la necessità di approcci più avanzati per identificare e salvaguardare aziende e utenti da attività informatiche dannose. Ciò ci porta alla necessità di integrare le misure di sicurezza tradizionali con metodi di intelligenza artificiale generativa.

Oggi abbiamo visto come la Gen AI offra un modo più rapido ed efficiente per identificare le minacce, prevedere i problemi di sicurezza e automatizzare le risposte agli incidenti. Abbiamo anche esaminato modi efficaci per implementare la Gen AI nelle misure di sicurezza informatica. Includono l'identificazione di casi d'uso specifici, la scelta della tecnologia giusta, la formazione dei dipendenti e il monitoraggio continuo delle misure di sicurezza.

Dovresti anche prendere nota delle considerazioni etiche nell’utilizzo dell’intelligenza artificiale per la sicurezza informatica e delle tendenze emergenti in materia di sicurezza informatica dell’IA.

Nel complesso, speriamo che questa guida ti abbia mostrato come l'intelligenza artificiale può aiutarti a migliorare il tuo livello di sicurezza. Utilizza queste informazioni per implementare un solido framework di sicurezza informatica per la tua organizzazione.