L'essor de la recherche multimodale et multilingue

Publié: 2022-01-06L'extension de la recherche au-delà des requêtes textuelles et la suppression des barrières linguistiques sont des tendances récentes qui façonnent l'avenir des moteurs de recherche. Avec de nouvelles fonctionnalités alimentées par l'IA, les moteurs de recherche cherchent à promouvoir une meilleure expérience de recherche et, en même temps, à apporter de nouveaux outils pour aider les utilisateurs à récupérer des informations spécifiques. Dans cet article, nous aborderons le sujet montant des systèmes de recherche multimodaux et multilingues . Nous montrerons également les résultats d'un outil de recherche de démonstration que nous avons construit chez Wordlift.

La prochaine génération de moteurs de recherche

Une bonne expérience utilisateur englobe de multiples aspects d'interaction entre les utilisateurs et les moteurs de recherche. De la conception de l'interface utilisateur et de sa convivialité à la compréhension de l'intention de recherche et à la résolution de ses requêtes ambiguës, les grands moteurs de recherche préparent la prochaine génération d'outils de recherche .

Recherche multimodale

Une façon de décrire un moteur de recherche multimodal est de penser à un système capable de gérer du texte et des images en une seule requête . De tels moteurs de recherche permettraient aux utilisateurs d'exprimer leurs requêtes d'entrée via une interface de recherche multimodale et, par conséquent, de permettre une expérience de recherche plus naturelle et intuitive.

Sur un site de commerce électronique, un moteur de recherche multimodal permettrait de retrouver les documents pertinents dans une base de données indexée. La pertinence est évaluée en mesurant la similarité des produits disponibles avec une requête donnée dans plusieurs formats tels que texte, image, audio ou vidéo. Par conséquent, ce moteur de recherche est un système multimodal puisque ses mécanismes sous-jacents sont capables de gérer différents modes d'entrée, c'est-à-dire des formats, en même temps.

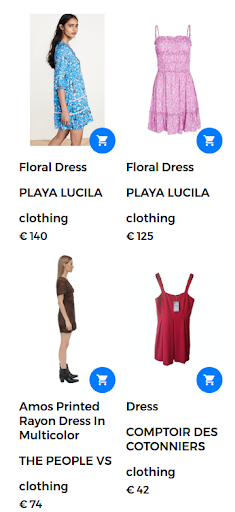

Par exemple, une requête de recherche pourrait prendre la forme de "robe à fleurs". Dans ce cas, un grand nombre de robes fleuries sont disponibles sur la boutique en ligne. Cependant, le moteur de recherche renvoie des robes qui ne sont pas vraiment satisfaisantes pour l'utilisateur, comme le montre la figure suivante.

Résultats renvoyés pour la requête "robe à fleurs".

Pour offrir une bonne expérience de recherche et renvoyer des résultats très pertinents, un moteur de recherche multimodal est capable de combiner un texte et une image dans une seule requête . Dans ce cas, l'utilisateur fournit l'exemple d'image du produit souhaité. Lors de l'exécution de cette recherche en tant que recherche multimodale, l'image d'entrée est une robe à fleurs qui est illustrée dans l'image suivante.

Image fournie par l'utilisateur pour la requête multimodale.

Dans ce scénario, la première partie de la requête reste la même (robe fleurie) et la deuxième partie ajoute l'aspect visuel à la requête multimodale. Les résultats renvoyés donnent des robes similaires à la robe à fleurs fournie par l'utilisateur. Dans ce cas d'utilisation, la même robe est disponible et, par conséquent, est le premier résultat renvoyé avec d'autres robes similaires.

Résultats de recherche pertinents renvoyés en réponse à la requête multimodale.

MAMAN

Google a introduit une nouvelle technologie pour aider les utilisateurs dans les tâches de recherche complexes. Cette nouvelle technologie, appelée MUM, signifie Multitask Unified Model et est capable de briser les barrières linguistiques et d'interpréter les informations à travers différents formats de contenu tels que les pages Web et les images.

Google Lens est l'un des premiers produits à tirer parti de l'avantage de combiner des images et du texte en une seule requête. Dans un contexte de recherche, MUM permettrait aux utilisateurs de trouver plus facilement des motifs tels qu'un motif floral spécifique dans une image fournie par l'utilisateur.

MUM est une nouvelle étape importante de l'IA pour comprendre les informations présentées ici :

"Bien que nous en soyons aux premiers jours de l'exploration de MUM, il s'agit d'une étape importante vers un avenir où Google peut comprendre toutes les différentes façons dont les gens communiquent et interprètent naturellement les informations."

Pour en savoir plus sur la recherche multimodale MUM de Google, consultez cette histoire Web :

Extension de la recherche à travers les langues

Alors que l'image est indépendante de la langue, les termes de recherche sont spécifiques à la langue. La tâche de conception d'un système multilingue se résume à la construction de modèles linguistiques dans un large éventail de langues.

Recherche multilingue

L'une des principales limites des systèmes de recherche actuels est qu'ils récupèrent les documents écrits ou annotés dans la langue dans laquelle l'utilisateur a rédigé la requête de recherche. En général, ces moteurs sont uniquement en anglais. De tels moteurs de recherche monolingues limitent l'utilité de ces systèmes pour trouver des informations utiles écrites dans une langue différente.

D'autre part, les systèmes multilingues acceptent une requête dans une langue et récupèrent des documents qui sont indexés dans d'autres langues. En réalité, un système de recherche est multilingue s'il est capable de récupérer les documents pertinents de la base de données en faisant correspondre le contenu du document, ou les légendes, rédigées dans une langue avec la requête textuelle dans une autre langue. Les techniques d'appariement vont des mécanismes syntaxiques aux approches de recherche sémantique.

L'appariement de phrases dans différentes langues avec des concepts visuels est une première étape pour promouvoir l'utilisation de modèles de vision-langage multilingues . La bonne nouvelle est que les concepts visuels sont interprétés presque de la même manière par tous les humains. Ces systèmes, capables d'incorporer des informations provenant de plus d'une source et dans plus d'une langue, sont appelés systèmes multilingues multimodaux . Cependant, l'appariement image-texte n'est pas toujours réalisable pour toutes les langues à grande échelle, comme indiqué dans la section suivante.

[Étude de cas] Stimuler la croissance sur de nouveaux marchés avec le référencement sur la page

De MUM à MURAL

On s'efforce de plus en plus d'appliquer des techniques avancées d'apprentissage en profondeur et de traitement du langage naturel aux moteurs de recherche. Google a présenté un nouveau travail de recherche qui permet aux utilisateurs d'exprimer des mots à l'aide d'images. Par exemple, le mot « valiha » fait référence à un instrument fait de cithare à tube et est joué par le peuple malgache. Ce mot n'a pas de traduction directe dans la plupart des langues, mais pourrait être facilement décrit à l'aide d'images.

Le nouveau système, appelé MURA, signifie Multimodal, Multi-task Retrieval Across Languages. Il permet de résoudre le problème des mots dans une langue qui peuvent ne pas avoir de traduction directe dans une langue cible. Avec de tels problèmes, de nombreux modèles multilingues pré-formés ne parviendraient pas à trouver des mots sémantiquement liés ou à traduire avec précision des mots vers ou à partir d'une langue sous-financée. En fait, MURAL peut résoudre de nombreux problèmes du monde réel :

- Mots qui véhiculent différentes significations mentales dans différentes langues : un exemple est le mot "mariage" en anglais et en hindi qui véhicule différentes images mentales, comme le montre l'image suivante du blog Google.

- Rareté des données pour les langues sous-financées sur le web : 90 % des couples texte-image sur le web appartiennent au top 10 des langues les plus riches en ressources.

Les images sont tirées de wikipedia, créditées à Psoni2402 (à gauche) et David McCandless (à droite) avec la licence CC BY-SA 4.0.

Réduire l'ambiguïté des requêtes et fournir une solution au problème de rareté des paires image-texte pour les langues sous-financées est une autre amélioration vers la prochaine génération de moteurs de recherche alimentés par l'IA.

La recherche multilingue et multimodale en action

Dans ce travail, nous utilisons des outils existants et des modèles de langage et de vision disponibles pour concevoir un système multilingue multimodal qui va au-delà d'une seule langue et peut gérer plus d'une modalité à la fois .

Tout d'abord, pour concevoir un système multilingue, il est important de connecter sémantiquement des mots provenant de différentes langues. Deuxièmement, pour rendre le système multimodal, il est nécessaire de relier la représentation des langues aux images. C'est donc un grand pas vers l'objectif de longue date d'une recherche multimodale multilingue.

Le contexte

Le principal cas d'utilisation de ce système multilingue multimodal est de renvoyer des images pertinentes à partir de l'ensemble de données à partir d'une requête combinant une image et un texte en même temps. Dans cette veine, nous montrerons quelques exemples qui illustrent divers scénarios multimodaux et multilingues.

L'épine dorsale de cette application de démonstration est alimentée par Jina AI, un écosystème de recherche neuronale open source. La recherche neuronale, alimentée par la récupération d'informations sur un réseau neuronal profond (ou IR neuronal), est une solution intéressante pour construire un système multimodal. Dans cette démo, nous utilisons l'architecture MPNet Transformer de Hugging Face, multilingual-mpnet-base-v2, pour traiter les descriptions textuelles et les légendes. Quant à la partie visuelle, nous utilisons MobileNetV2.

Dans ce qui suit, nous vous présentons une série de tests pour montrer la puissance des moteurs de recherche multilingues et multimodaux . Avant de présenter les résultats de notre outil de démonstration, voici une liste d'éléments clés qui décrivent ces tests :

- La base de données se compose d'images 1k qui représentent des personnes jouant de la musique. Ces images sont extraites du jeu de données public Flickr30K.

- Chaque image a une légende écrite en anglais.

Étape 1 : Commencer par une requête textuelle en anglais

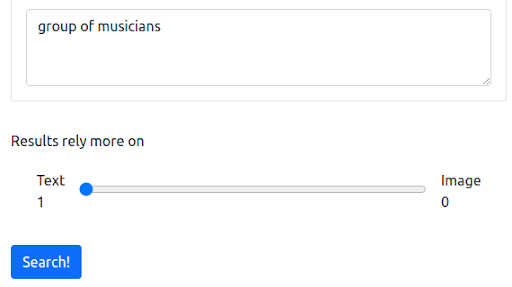

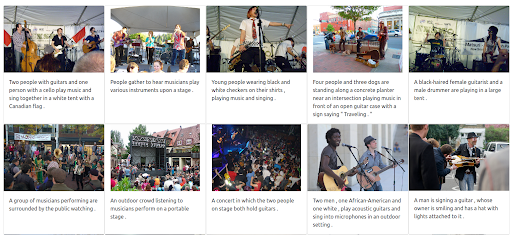

Tout d'abord, nous commençons par une requête textuelle qui reflète le mode de fonctionnement actuel de la plupart des moteurs de recherche. La requête est "groupe de musiciens".

La requête

Les résultats

Notre moteur de recherche de démonstration basé sur Jina renvoie des images de musiciens qui sont sémantiquement liées à la requête d'entrée. Cependant, ce n'est peut-être pas le type de musiciens que nous voulons.

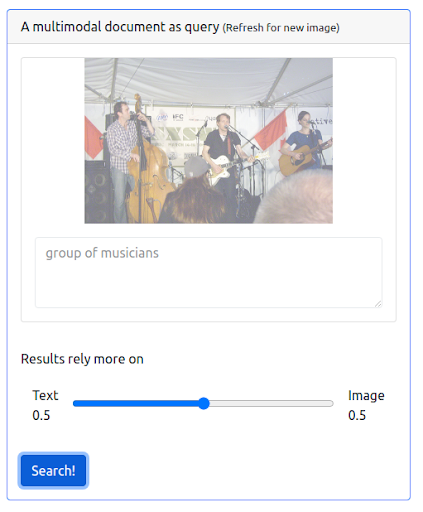

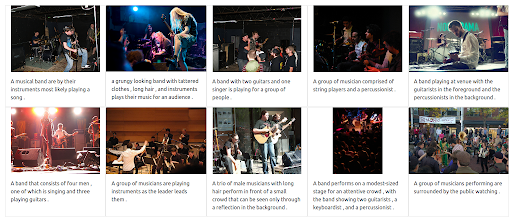

Étape 2 : Ajouter la multimodalité

Ajoutons maintenant un peu de multimodalité en émettant une requête qui combine à la fois la requête textuelle précédente et une image. L'image représente une représentation plus précise des musiciens que nous recherchons.

Tout d'abord, l'interface utilisateur doit prendre en charge l'émission de tels types de requêtes. Ensuite, nous devons attribuer un poids pour équilibrer l'importance de chaque modalité lors de la récupération des résultats. Dans ce cas, le texte et l'image ont un poids égal (0,5). Comme nous pouvons le voir ci-dessous, les nouveaux résultats de recherche incluent un certain nombre d'images visuellement similaires à la requête d'image d'entrée.

La requête

Les résultats

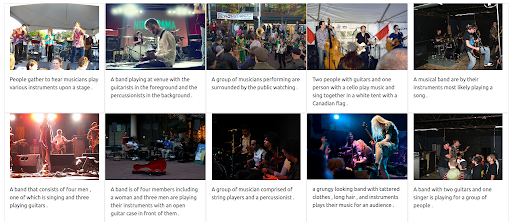

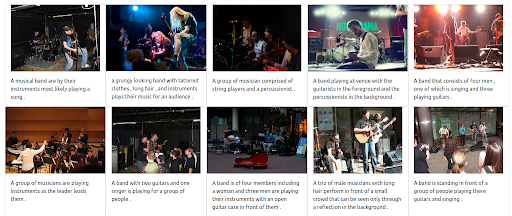

Étape 3 : Attribuer un poids maximum à l'image

Il est également possible de donner un poids maximum à l'image. Cela exclurait le texte d'entrée de la requête. Dans ce cas, davantage d'images visuellement similaires à l'image d'entrée sont renvoyées et classées dans les premières positions. Une chose à garder à l'esprit est que les résultats sont limités aux images disponibles dans l'ensemble de données.

La requête

Les résultats

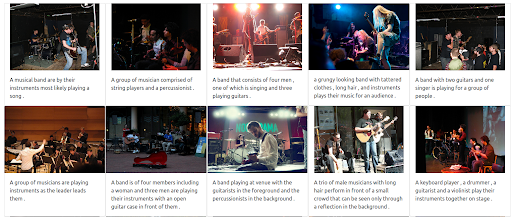

Étape 4 : Tester la recherche multilingue

Essayons maintenant d'émettre la même requête mais en utilisant des langues différentes. Le poids du texte est maximisé afin d'illustrer toute la puissance de ce système multilingue. N'oubliez pas que les légendes des images sont en anglais uniquement. La recherche est répétée pour couvrir les langues suivantes :

- Français : Groupe de musiciens

- Italien : Gruppo di musicisti

- allemand : Gruppe von Musikern

Quelle que soit la langue de la requête d'entrée, les résultats renvoyés sont pertinents et cohérents dans les trois langues. Les résultats sont montrés plus bas.

Les résultats de la requête en français

Les résultats de la requête en italien

Les résultats de la requête en allemand

L'avenir multilingue multimodal de la recherche

Dans les années à venir, l'intelligence artificielle transformera de plus en plus la recherche et débloquera de toutes nouvelles façons pour les gens d'exprimer leurs requêtes et d'explorer des informations. Comme Google l'a déjà annoncé, la compréhension des informations avec MUM représente une étape importante de l'IA. Plus de systèmes alimentés par l'IA à l'avenir incluraient des fonctionnalités et des améliorations allant de la fourniture d'une meilleure expérience de recherche à la réponse à des questions sophistiquées et de la suppression des barrières linguistiques à la combinaison de différents modes de recherche en une seule requête.