L'IA générative en cybersécurité : un aperçu

Publié: 2024-03-01L'IA générative est définie comme des modèles d'apprentissage en profondeur capables de créer des textes, des images et d'autres contenus de haute qualité en fonction des données sur lesquelles ils ont été formés.

La génération AI présente de nombreux avantages dans l’espace numérique. Un exemple notable est l’inclusion de fonctionnalités d’IA dans les applications mobiles pour les rendre plus attrayantes.

En cybersécurité, l’IA générative peut analyser les données, identifier les menaces et recommander des solutions pour prévenir les attaques malveillantes. Dans cet article de blog, nous approfondirons la manière dont la génération AI peut contribuer à renforcer les mesures de cybersécurité.

Avantages de la génération AI en matière de cybersécurité

L’utilisation de l’IA générative en entreprise présente un grand potentiel. Pour la cybersécurité, la Gen AI présente des avantages remarquables tels que :

1. Détection améliorée des menaces

L’IA générative peut observer et apprendre de manière transparente des modèles dans une vaste gamme de données, permettant ainsi aux professionnels de la cybersécurité d’identifier et de comprendre en permanence les menaces de cybersécurité.

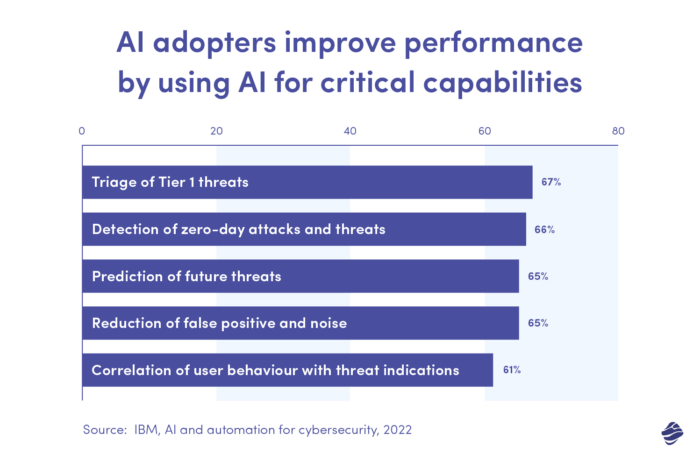

Dans une étude d'IBM, 66 % des utilisateurs de l'IA ont révélé que l'IA générative les avait aidés à prédire les attaques et les menaces du jour zéro. Les attaques Zero Day font référence à des menaces plus récentes que les systèmes traditionnels peuvent ignorer.

65 % supplémentaires ont déclaré que la génération AI aide à corréler le comportement des utilisateurs pour détecter les menaces.

Avec la génération AI en cybersécurité, il sera beaucoup plus facile d'identifier de légères variations comportementales pouvant indiquer une attaque potentielle. Par exemple, Gen AI peut analyser automatiquement les nouveaux fichiers et codes pour détecter les comportements suspects. Ou analysez le contenu des e-mails, les modèles de langue et les informations sur l'expéditeur pour identifier avec précision les faux e-mails.

2. Analyse prédictive

La génération AI peut faire des prédictions précises des résultats futurs sur la base d’une analyse de modèles répétitifs dans de grands ensembles de données tels que les journaux de sécurité, le trafic réseau, les renseignements sur les menaces, etc.

Par exemple, Gen AI peut analyser les modèles de vulnérabilités ou d’attaques précédentes et les utiliser pour prédire d’éventuelles menaces qui pourraient survenir à l’avenir. Cela permet aux organisations et aux équipes de sécurité de mettre en œuvre des mesures pour prévenir de telles attaques.

3. Réponses automatisées

Sur la base de modèles et d'attaques précédemment observés, Gen AI peut générer des réponses automatisées pour différents types de menaces. Par exemple, vous pouvez déclencher des actions qui bloquent les adresses IP malveillantes, ajuster les règles de pare-feu contre les tentatives d'intrusion ou empêcher la propagation des logiciels malveillants.

En utilisant l’IA générative dans la cybersécurité, vous pouvez également générer des réponses automatisées pour corriger les vulnérabilités de sécurité avant une attaque ou rediriger le trafic suspect vers des pots de miel pour une enquête plus approfondie.

De plus, Gen AI peut générer automatiquement des rapports détaillés après avoir analysé vos journaux de sécurité.

3 défis et risques majeurs liés à l'utilisation de l'IA générative dans la cybersécurité

Outre les avantages, l’utilisation de Gen AI pour la cybersécurité présente des risques et des défis potentiels. Ceux-ci inclus:

1. Problèmes de confidentialité des données

Former des modèles d'IA générative ou analyser des données existantes signifie généralement que vous fournissez aux outils d'IA de nombreuses informations provenant de votre organisation. C'est ainsi que vous pouvez obtenir des résultats plus précis.

Cependant, la manière dont la confidentialité de vos données est protégée suscite des inquiétudes. Par exemple, il est probable que les informations personnelles soient utilisées à mauvais escient si rien n'est fait, en particulier lorsque les directives éthiques et les pratiques de gouvernance des données sont négligées.

De plus, la qualité des modèles Gen AI dépend des données sur lesquelles ils sont formés. Ainsi, si des données biaisées sont utilisées, il est possible que le modèle manque des modèles spécifiques et fasse des prédictions inexactes ou biaisées. En matière de cybersécurité, cela peut impliquer de négliger certains types d’attaques ou de sous-estimer certaines menaces.

2. L’IA utilisée à des fins malveillantes

Les outils Gen AI deviennent de plus en plus accessibles et abordables. En conséquence, il est non seulement accessible à une société légitime de développement d’IA générative, mais peut également être utilisé par des individus ayant des intentions malveillantes.

Par exemple, les pirates peuvent facilement utiliser l’IA générative pour créer des codes malveillants ciblant des protocoles de sécurité faibles.

De plus, l’IA générative peut être utilisée pour créer de nouvelles méthodes d’attaque sophistiquées, ce qui rend plus difficile le maintien des mesures de sécurité traditionnelles.

Par exemple, la génération AI peut créer de faux e-mails ou sites Web très crédibles, ce qui rend plus difficile pour les utilisateurs d'identifier et d'éviter les escroqueries. Cela signifie que des utilisateurs peu méfiants pourraient être incités à fournir des informations sensibles ou à télécharger du contenu nuisible.

3. Déplacement d'emploi

L’efficacité est l’un des principaux arguments de vente de l’utilisation de l’IA générative dans la cybersécurité. Cette technologie peut analyser de grandes quantités de données plus rapidement que les techniques traditionnelles de cybersécurité.

Malheureusement, cela signifie également que l’IA peut potentiellement supprimer de nombreux emplois. En fait, un rapport de Goldman Sachs explique que l’IA remplacera 300 millions d’emplois grâce à l’automatisation.

Les experts en cybersécurité chargés de tâches répétitives telles que la détection des menaces et l’analyse des logiciels malveillants seront probablement les premiers touchés par l’automatisation de la génération IA.

Mais tout n’est pas sombre et catastrophique. L’expertise humaine sera toujours nécessaire. La meilleure solution, notamment pour les professionnels de la cybersécurité, est de se recycler ou de se perfectionner. Ceci est particulièrement crucial pour les professionnels effectuant des tâches de niveau débutant.

Pour commencer, les professionnels devront se familiariser avec le travail aux côtés de l’IA. Deuxièmement, davantage d’organisations auront besoin d’experts humains capables d’élaborer des stratégies de cybersécurité solides, d’optimiser les systèmes d’IA et de superviser la gestion des risques.

Applications concrètes et études de cas de la génération AI en cybersécurité

Avant de continuer, examinons brièvement des exemples concrets et des cas d'utilisation de l'IA générative en cybersécurité, où l'intégration de l'intelligence artificielle (IA) est devenue un outil crucial au potentiel immense. L’IA a de nombreuses applications en cybersécurité qui peuvent contribuer à renforcer les défenses, à améliorer la détection des menaces et à accroître la résilience des infrastructures numériques face aux cybermenaces en constante évolution. Examinons plus en détail des exemples concrets pour comprendre comment l'utiliser pour atténuer les cyber-risques.

Google n'utilise pas seulement l'IA générative pour se prémunir contre les cybermenaces au sein de son organisation. Elle crée également des solutions d'IA générative pour aider d'autres organisations à faire de même.

Google a également annoncé le lancement d'initiatives de cyberdéfense qui contribuent à améliorer la cybersécurité. L'une de ces initiatives est SAIF – Secure AI Framework, que Google a utilisé dans son processus de développement de logiciels.

SAIF est un cadre conceptuel qui vise à protéger les systèmes d'IA contre les menaces et les attaques. Il peut être utilisé pour lutter contre des risques tels que le vol d’un modèle d’IA particulier, l’empoisonnement des données via des sorties génératives d’IA ou des entrées malveillantes via des injections rapides. SAIF est également efficace pour surveiller les entrées et les sorties afin de détecter les menaces et de se prémunir contre les attaques en automatisant les défenses.

Google a également l'intention de publier Magika, un outil de cybersécurité permettant d'identifier les types de fichiers afin de détecter les logiciels malveillants. Google a utilisé avec succès cet outil pour protéger ses produits tels que Google Drive, Gmail et la navigation sécurisée.

Pay Pal

PayPal est une plateforme de paiement internationale qui facilite les transactions pour les commerçants et les clients. Pour mettre en œuvre des mesures de cybersécurité, PayPal forme des modèles avancés d'apprentissage automatique (ML) pour détecter les activités frauduleuses en temps réel.

En règle générale, le réseau PayPal fournit une grande quantité de données de transaction dont l'IA peut tirer des leçons. Les résultats du modèle ML peuvent ensuite être utilisés pour améliorer les systèmes d'authentification et détecter les activités frauduleuses. Le modèle continue d'apprendre et de s'adapter à mesure que l'ensemble de données de PayPal se développe.

ED&F Homme Holdings

ED&F est un négociant en matières premières qui a utilisé avec succès l'IA générative pour la détection des menaces. Ils y sont parvenus grâce à Cognito, une plateforme de détection des menaces d'IA de Vectra.

ED&F a fourni des informations détaillées sur son activité réseau, y compris la communication entre les appareils, les transferts de données et les actions des utilisateurs. Cognito utilise ensuite ces données pour identifier les vulnérabilités et les comportements suspects en temps réel.

Selon Carmelo Gallo, responsable de la cybersécurité d'ED&F, Cognito a joué un rôle clé en aidant à identifier les comportements à risque des employés, tels que l'accès à distance non autorisé aux données et aux fichiers. ED&F a également découvert un malware de commande et de contrôle qui persiste dans son système depuis longtemps.

IA générative vs méthodes de cybersécurité traditionnelles

Les méthodes traditionnelles de cybersécurité prospèrent grâce à un système basé sur des règles et à une analyse manuelle.

Les systèmes basés sur des règles impliquent généralement la définition d'instructions prédéfinies indiquant au système ce qu'il doit surveiller. Cela serait généralement basé sur des modèles uniques présentés par des logiciels malveillants populaires ou des failles de sécurité.

Lorsque ces règles signalent une activité suspecte, vous devez généralement évaluer et résoudre manuellement les vulnérabilités. Les méthodes traditionnelles de cybersécurité dépendent également grandement de l’intervention humaine et de mises à jour constantes.

Contrairement aux méthodes traditionnelles qui ont du mal à gérer de grandes bases de données, la génération AI peut évaluer une énorme quantité de données, ce qui lui permet de détecter des modèles complexes qu'un analyste humain pourrait manquer. Cela vous aide également à comprendre les vulnérabilités plus en détail.

Au-delà de l'analyse des données, l'IA générative peut aider à créer des solutions aux menaces potentielles, par exemple en générant des mots de passe sécurisés ou en concevant des protocoles de sécurité plus efficaces. C'est donc plus proactif.

Même si l’IA s’avère être un outil plus efficace pour mettre en œuvre des mesures de cybersécurité plus strictes, l’intervention humaine sera toujours nécessaire. Ainsi, vous pouvez tirer parti des atouts des deux méthodes pour de meilleurs résultats.

Par exemple, vous pouvez utiliser des méthodes traditionnelles pour vérifier les prédictions faites par l’IA et garantir une meilleure précision. Vous pouvez également utiliser les recommandations de l'IA pour améliorer les configurations manuelles que vous configurez.

7 tendances émergentes en matière d’IA et de cybersécurité :

L’IA générative dans le domaine de la cybersécurité évolue rapidement. Nous explorons ici plusieurs tendances émergentes susceptibles de façonner l’avenir.

- Priorisation de l'IA Cloud et de la sécurité : nous assistons à une intégration entre les systèmes d'IA et l'infrastructure cloud. Cela devrait faciliter la détection et la prévention des menaces en temps réel.

- Extension des outils de cybersécurité basés sur la génération AI : la génération AI va faire preuve d'ingéniosité pour créer de faux systèmes ou des pots de miel pour tromper les cyber-attaquants. La capacité de cette technologie à analyser de grandes quantités de données et à identifier des modèles contribuera également à créer de nouvelles solutions de cybersécurité.

- Accent sur la cyber-résilience : la capacité de l'IA à prédire et à corriger les vulnérabilités entraînera une amélioration de la résilience des systèmes de cybersécurité. La technologie aidera à corriger les faiblesses avant que les attaquants puissent les exploiter.

- Cyberattaques de plus en plus sophistiquées facilitées par la génération AI : la génération AI peut faciliter les cyberattaques à grande échelle, ce qui était initialement très difficile. Les deep fakes gagnent également en popularité, augmentant le risque d’ingénierie sociale via des campagnes de phishing personnalisées.

- Utilisation de l'automatisation basée sur l'IA permettant aux équipes de cybersécurité de générer de meilleures informations : l'IA finira par prendre en charge des tâches chronophages telles que l'examen des journaux ainsi que la détection et l'analyse des menaces. Cela permettra aux experts humains de se concentrer sur des tâches plus stratégiques telles que la prise de décision et l'élaboration de stratégies de cybersécurité.

Outre l’amélioration de la cybersécurité, cette tendance montre que l’avenir nécessite une collaboration entre les experts humains et les systèmes d’IA.

- Augmentation des modèles linguistiques spécialisés : une publication récente du Forum économique mondial suggère que les grands modèles linguistiques ont été très efficaces pour traiter de grandes quantités de données.

Toutefois, cette large utilisation peut ne pas s’appliquer à des domaines spécialisés comme la cybersécurité. En conséquence, nous assisterons probablement à une transition vers des modèles de langage plus petits et plus spécialisés, qui peuvent permettre aux équipes d'accéder à des informations plus précises et exploitables.

- Focus sur la détection proactive des menaces : nous constatons La génération AI est utilisée pour améliorer la sécurité des applications mobiles en se concentrant sur la détection proactive des menaces et les réponses en temps réel.

Il s’agit de l’une des tendances croissantes de l’IA dans les applications mobiles. L'IA peut observer le comportement des utilisateurs pour détecter les bizarreries pouvant indiquer une faille de sécurité. Certains exemples incluent des tentatives de connexion inhabituelles ou d’autres activités suspectes.

Alors que nous envisageons l’avenir de l’IA dans le domaine de la cybersécurité, il est raisonnable de prédire qu’il y aura des outils et des plateformes plus avancés pour cibler les menaces toujours croissantes qui pèsent sur le cyberespace.

Comment mettre en œuvre la génération AI dans la cybersécurité

L’intégration de l’IA générative dans votre stratégie de cybersécurité est un pas remarquable dans la bonne direction. Cependant, une planification et une mise en œuvre minutieuses sont nécessaires.

Ainsi, dans cette session, nous examinerons quelques façons de mettre en œuvre efficacement la Gen AI dans la cybersécurité :

- Commencer petit

Au lieu de réviser votre système de sécurité existant, envisagez de commencer par les bases et de l'étendre au fil du temps.

Vous souhaitez donc d’abord identifier les cas d’utilisation les plus précieux pour votre organisation. Il peut s'agir de corriger des vulnérabilités ou d'améliorer vos réponses aux attaques.

- Former les employés et réglementer l'utilisation de l'IA

Ensuite, formez votre équipe à l’utilisation de Gen AI pour détecter les problèmes et à l’interprétation des résultats. Vous pourrez ensuite progressivement adopter des outils de sécurité basés sur l’IA pour des tâches telles que la détection des menaces en temps réel et la réponse aux incidents.

Vous souhaitez également mettre à jour vos politiques et réglementations de sécurité pour promouvoir l’utilisation des outils d’IA. Par exemple, montrez à vos employés des exemples de ce qui est acceptable lors de l'utilisation d'outils d'IA générative dans vos mesures de cybersécurité.

En raison de la possibilité d'une mauvaise utilisation des outils d'IA et des risques de sécurité qui peuvent en découler, il est conseillé de mettre en place des mesures pour coordonner la manière dont la Gen AI est utilisée dans votre organisation. Par exemple, vous pouvez limiter l'utilisation aux seuls outils vérifiés et approuvés par votre service informatique.

- Choisissez la bonne technologie d'IA

Il existe différentes technologies d’IA que vous pouvez utiliser dans votre stratégie de cybersécurité. Voici quelques exemples :

Machine Learning (ML) , qui utilise des algorithmes pour apprendre à partir des données et faire des prédictions. C'est utile si vous souhaitez détecter les menaces et prédire les vulnérabilités.

Traitement du langage naturel (NLP) – se concentre sur la compréhension et la manipulation du langage humain. Utile pour les processus de sécurité tels que l'analyse des e-mails ou des journaux de sécurité et l'automatisation des réponses aux incidents.

Ensuite, nous disposons de systèmes de détection d'anomalies (ADS) , qui identifient les écarts par rapport aux modèles de données standard. ADS peut détecter les intrusions sur le réseau, les comportements inhabituels des utilisateurs ou les activités de logiciels malveillants.

Il est conseillé d'utiliser la technologie qui résout les problèmes de sécurité spécifiques que vous ciblez.

- Utilisez des données de haute qualité

Investissez dans la collecte et la préparation de données impartiales et de haute qualité, spécifiques à vos besoins. Idéalement, il devrait s’agir de données pertinentes par rapport à votre cas d’utilisation et au paysage des menaces. Vous souhaitez également utiliser diverses variations de données pour éviter les biais dans la sortie.

Envisagez d'utiliser des données simulées à la place de toute information susceptible d'être sensible. Assurez-vous de sécuriser le stockage de vos données et les contrôles d’accès pour protéger les informations sensibles.

- Surveiller et adapter

Enfin, les cybermenaces évoluent constamment, votre mise en œuvre de GenAI doit donc également s'adapter. Surveillez régulièrement ses performances, mettez à jour les données et les modèles et relevez tous les défis émergents.

Vous pouvez également vous associer à une entreprise qui fournit des services d’IA générative pour une mise en œuvre plus efficace.

Considérations réglementaires et éthiques

L’utilisation croissante de la Gen AI nécessite la mise en œuvre de réglementations, notamment en ce qui concerne l’adoption éthique et la révélation des risques. Idéalement, l’utilisation des outils d’IA devrait se conformer aux lignes directrices établies par les organismes de réglementation existants.

Des lois telles que le RGPD (Règlement général sur la protection des données) et le CCPA (California Consumer Privacy Act) ont établi les normes en matière de confidentialité des utilisateurs et de protection des données avec des modèles de cybersécurité d'IA. Certains d'entre eux incluent :

- Collectez et utilisez uniquement les données nécessaires à des fins spécifiques et légitimes.

- Mettre en œuvre des mesures efficaces pour protéger les données des utilisateurs.

- Fournissez des informations qui aident les utilisateurs à comprendre le fonctionnement des plateformes d'IA.

Une étude met également en évidence des cadres bien connus qui guident l’adoption éthique de l’IA. Ils incluent l’équité, la transparence, la responsabilité et la robustesse.

Équité – cela implique de garantir que la technologie de l’IA est juste et impartiale, en particulier en ce qui concerne les données avec lesquelles l’IA est entraînée. Cela implique de prendre des mesures pour prévenir toute forme de discrimination fondée sur des facteurs tels que le sexe, l’âge ou le statut socio-économique.

La transparence et la responsabilité exigent que les fournisseurs de plateformes d’IA soient honnêtes sur le fonctionnement des systèmes d’IA. Ils doivent également être responsables des erreurs ou des problèmes rencontrés lors de l’utilisation de ces solutions d’IA. Les utilisateurs doivent comprendre comment leurs données sont utilisées ou stockées.

La robustesse met en évidence la nécessité de créer des systèmes d’IA fiables, sécurisés et résilients aux erreurs.

Il existe également la conception centrée sur l'humain, qui favorise la création de systèmes d'IA en tenant compte des besoins humains au lieu de se concentrer sur un détail technique.

Avis d'experts et prévisions sur l'utilisation de la génération AI pour la cybersécurité

Alors, que disent les experts en cybersécurité à propos de l’IA générative dans la cybersécurité ?

Kunle Fadeyi, membre du Forbes Technology Council, convient que l'IA révolutionne la cybersécurité en fournissant des mesures de sécurité proactives qui peuvent aider à se protéger contre les cyberattaques. Il appelle cela la « sécurité dès la conception », qui consiste généralement à identifier et à combler les failles de sécurité que les cybercriminels pourraient tenter d’exploiter.

Mike Lieberman, CTO et co-fondateur de Kusari, prédit également que l'IA aidera les entreprises à aborder la cybersécurité en leur permettant de détecter de mauvais modèles de sécurité dans un code ou une configuration donnée. Selon Lieberman, l’IA fournira des conseils dans des scénarios de sécurité plus complexes. Cependant, les outils d’IA ne doivent être utilisés que comme signaux et non comme décideurs.

Enfin, Jesper Zerlang, expert en cybersécurité et PDG de Logpoint, recommande aux organisations d'intégrer des stratégies de cybersécurité dans leurs objectifs commerciaux globaux. En effet, le risque de cyberattaques augmentera probablement à mesure que les entreprises s’appuieront sur des processus numériques.

L'intégration de la cybersécurité dans les objectifs commerciaux permettra aux organisations de protéger de manière proactive leurs actifs commerciaux précieux et de renforcer la confiance des parties prenantes.

En conclusion : Comment utiliser Gen AI pour la cybersécurité

À mesure que la technologie évolue, les menaces et les attaques potentielles continuent également de saturer l’espace numérique. Cela nécessite des approches plus avancées pour identifier et protéger les entreprises et les utilisateurs contre les cyberactivités malveillantes. Cela nous amène à la nécessité de compléter les mesures de sécurité traditionnelles par des méthodes d’IA générative.

Aujourd’hui, nous avons vu comment la génération AI offre un moyen plus rapide et plus efficace d’identifier les menaces, de prédire les problèmes de sécurité et d’automatiser les réponses aux incidents. Nous avons également étudié des moyens efficaces d’implémenter la Gen AI dans vos mesures de cybersécurité. Ils incluent l’identification de cas d’utilisation spécifiques, le choix de la bonne technologie, la formation de vos employés et la surveillance continue de vos mesures de sécurité.

Vous devez également prendre note des considérations éthiques liées à l’utilisation de la génération AI pour la cybersécurité et des tendances émergentes en matière de cybersécurité de l’IA.

Dans l’ensemble, nous espérons que ce guide vous a montré comment l’intelligence artificielle peut vous aider à améliorer votre posture de sécurité. Utilisez ces informations pour mettre en œuvre un cadre de cybersécurité robuste pour votre organisation.