Présentation de Fin : le chatbot IA révolutionnaire d'Intercom, basé sur GPT-4

Publié: 2023-03-15L'arrivée du ChatGPT d'OpenAI a tout transformé - les énormes implications pour le service client étaient immédiatement évidentes.

Nous avons rapidement lancé une collection de fonctionnalités d'IA pour notre boîte de réception, en appliquant cette technologie pour offrir des gains d'efficacité. Mais la question numéro un qu'on nous a posée était "Est-ce que ChatGPT peut simplement répondre aux questions de mes clients ?" C'était tellement clair qu'il était meilleur pour comprendre le langage naturel que tout ce que nous avions vu auparavant.

Malheureusement, nos explorations initiales ont montré que les hallucinations étaient un trop gros problème. GPT-3.5, qui alimentait ChatGPT, était tout simplement trop enclin à inventer des choses lorsqu'il ne connaissait pas la réponse.

Mais l'annonce récente du GPT-4 a changé les choses - ce modèle est conçu pour réduire les hallucinations. Nous sommes ravis de partager ce que nous avons construit avec GPT-4 lors de nos premiers tests.

Présentation de notre nouveau chatbot IA : Fin

Aujourd'hui, nous annonçons que nous avons créé un bot de service client alimenté par l'IA qui bénéficie des avantages de cette nouvelle technologie et est adapté aux besoins des entreprises. Il s'appelle Fin, et nous pensons qu'il a la capacité de devenir un partenaire précieux pour votre équipe d'assistance.

Lorsque nous avons commencé à expérimenter la création d'un chatbot alimenté par GPT, nous avions en tête un certain nombre d'objectifs de conception. Nous voulions créer un bot qui pourrait :

- Conversez naturellement, en utilisant la technologie GPT.

- Répondez aux questions sur votre entreprise, en utilisant les informations que vous contrôlez.

- Réduire les hallucinations et les réponses inexactes à des niveaux acceptables.

- Nécessite une configuration et une configuration minimales.

Nous croyons que nous y sommes parvenus. Notre nouveau chatbot IA fonctionne "prêt à l'emploi", réduisant instantanément votre volume d'assistance et vos temps de résolution.

Il peut converser beaucoup plus naturellement sur les requêtes d'assistance que les bots existants, apportant la capacité de conversation naturelle de l'IA moderne au service client.

Il peut comprendre les requêtes qui s'étendent sur plusieurs tours de conversation, permettant à vos clients de poser des questions de suivi et d'obtenir des éclaircissements supplémentaires.

Fin engage des conversations naturelles avec les clients

Nous avons étendu GPT-4 avec des fonctionnalités et des protections spécialement conçues pour fournir un support client, où la confiance et la fiabilité sont cruciales.

Fin refuse de répondre aux questions hors domaine

Fin est conçu pour fournir uniquement des réponses basées sur le contenu de votre centre d'aide existant, ce qui augmente la précision et la fiabilité. Pour renforcer ce sentiment de confiance, il est toujours lié à ses articles sources, afin que vos clients puissent valider les réponses.

Ce n'est pas parfait, comme nous le verrons ci-dessous, mais nous pensons qu'il est maintenant prêt pour de nombreuses entreprises.

Fin ne nécessite pratiquement aucun temps d'installation initial. Il ingère les informations de votre centre d'assistance Intercom ou Zendesk existant, en utilisant la puissance de l'IA pour interpréter immédiatement les questions complexes des clients et appliquer les connaissances de votre centre d'assistance pour y répondre.

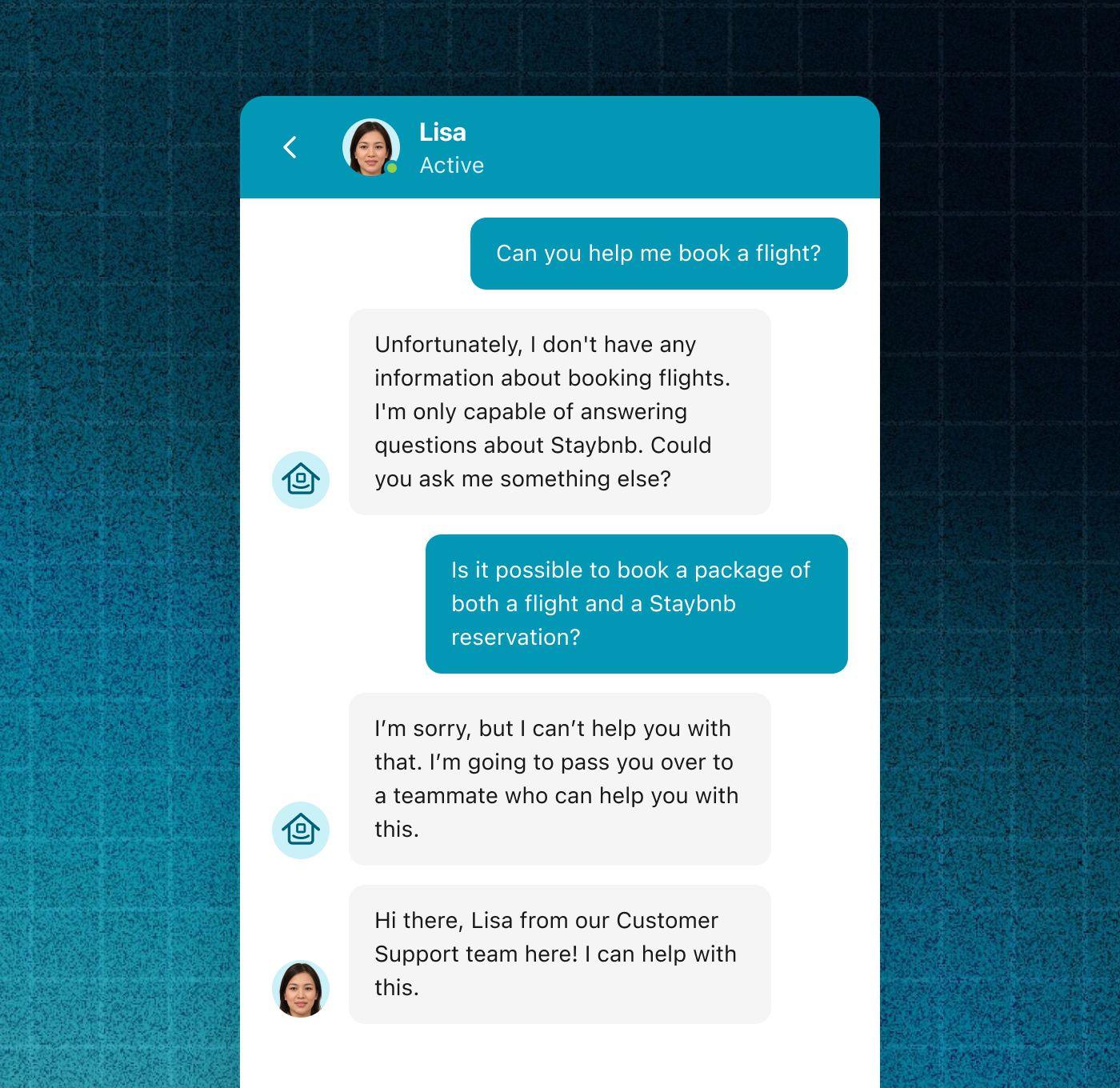

Forcément, le chatbot ne pourra pas répondre à toutes les requêtes des clients. Dans ces situations, il peut transmettre des questions plus difficiles aux équipes d'assistance humaine de manière transparente. Il fonctionne efficacement au sein de l'équipe du service client, en utilisant tous les flux de travail activés par Intercom.

Si Fin ne peut pas répondre à une question, celle-ci peut être transmise de manière transparente à un représentant CS qui peut

Comment nous avons construit ce chatbot IA

Afin de créer Fin, nous avons combiné la technologie existante derrière notre Resolution Bot avec le nouveau GPT-4 d'OpenAI.

Nous avons lancé Resolution Bot il y a plus de quatre ans, et il fonctionne très bien une fois configuré, mais il nécessite que les "réponses" ou les "intentions" soient sélectionnées manuellement. Malheureusement, nous savons que certains clients ont du mal à surmonter cet obstacle initial.

"Nous avons conçu Fin pour qu'il s'exécute en utilisant les connaissances qui existent déjà dans votre centre d'aide"

Pour notre nouveau bot, nous voulions réduire cette friction.

Nous l'avons donc conçu pour fonctionner en utilisant les connaissances déjà créées pour votre centre d'aide. Il consommera les articles de votre centre d'aide et utilisera les informations pour répondre directement aux questions des clients.

Lorsqu'on lui pose une question, le chatbot utilise ensuite son IA pour reformuler automatiquement les informations de l'article en une réponse naturelle. Et, lorsque vous mettez à jour un article, la réponse du bot sera mise à jour presque immédiatement. Cela signifie que vous n'avez qu'à conserver votre contenu d'aide en un seul endroit, et la version la plus à jour peut être servie automatiquement aux clients.

Cela permet aux entreprises de tirer parti des avantages de l'IA moderne, de manière sûre et prévisible, et d'utiliser leurs processus existants pour créer du contenu de centre d'aide.

À l'avenir, nous prévoyons d'aller plus loin et d'intégrer notre autre technologie d'apprentissage automatique pour aider le robot IA à répondre aux questions en utilisant les données de première partie dont vous disposez sur vos clients.

Créer un chatbot de confiance

Nous avons conçu ce chatbot pour répondre aux questions uniquement en utilisant le contenu d'aide que vous avez déjà créé pour éviter le risque de réponses inexactes ou inattendues. Cela vous donne un haut degré de contrôle sur ce que Fin peut dire.

"Certains autres bots GPT basent leurs réponses sur des quantités massives d'informations provenant du Web, mais en fait, limiter les informations que le bot peut utiliser augmente radicalement sa prévisibilité et sa fiabilité"

Si quelqu'un pose une question qui n'est pas traitée dans votre centre d'aide, il dira qu'il ne connaît pas la réponse. C'est une caractéristique importante. Certains autres bots GPT basent leurs réponses sur des quantités massives d'informations provenant du Web, mais en fait, limiter les informations que le bot peut utiliser augmente radicalement sa prévisibilité et sa fiabilité.

Nous avons encore atténué les inexactitudes en concevant une nouvelle interface utilisateur pour Fin dans un souci de fiabilité : elle renvoie clairement à l'article source lorsqu'une réponse est donnée, ce qui permet à l'utilisateur de vérifier si la source est pertinente, réduisant ainsi l'impact des erreurs mineures.

Fin fournira toujours une source pour ses réponses, permettant aux clients de vérifier ses réponses

Nous avons également pris des mesures pour réduire la capacité de l'utilisateur à faire dialoguer le bot sur n'importe quel sujet qui ne figure pas dans le centre d'aide.

Limites

Précision

Il peut être possible pour les utilisateurs finaux de contourner intentionnellement les contraintes que nous avons conçues et de faire dire au chatbot IA des choses inappropriées. Si cela se produit, nous pensons que ce ne sera qu'après des tentatives déterminées, plutôt que lors d'interactions naturelles avec les clients.

Il faut souligner que l'IA n'est pas parfaite. Pour certains clients, tout risque de fournir des informations non pertinentes ou incorrectes est inacceptable. Ils ne voudront peut-être pas encore adopter ce chatbot alimenté par l'IA.

Les grands modèles de langage ont actuellement un mode de défaillance différent de celui des bots précédents que nous avons construits, tels que Resolution Bot. Alors que Resolution Bot peut parfois fournir une réponse non pertinente , notre bot AI peut parfois fournir une réponse incorrecte . Par exemple, il peut être confus par le contenu d'un article et faire une déclaration à l'utilisateur qui n'est pas vraie. Si cette chance a beaucoup diminué avec les modèles récents, elle n'est pas nulle.

Pour vous permettre de quantifier cette limitation, nous créons une expérience dans laquelle vous pouvez importer votre centre d'aide existant dans le bot et le tester manuellement.

"Nous pensons que ces modèles continueront de s'améliorer et que la précision s'améliorera en conséquence"

Dans l'ensemble, avec les récentes améliorations apportées à GPT-4 et les contraintes de conception que nous avons établies, nous sommes convaincus que ses performances sont supérieures à la barre de précision requise par de nombreuses entreprises.

À l'avenir, nous pensons que ces modèles continueront de s'améliorer et que la précision s'améliorera en conséquence. Nous pensons également que la compréhension des utilisateurs des limites de cette technologie augmentera avec le temps ; nos réponses de bot AI sont clairement étiquetées comme "AI" pour permettre cela.

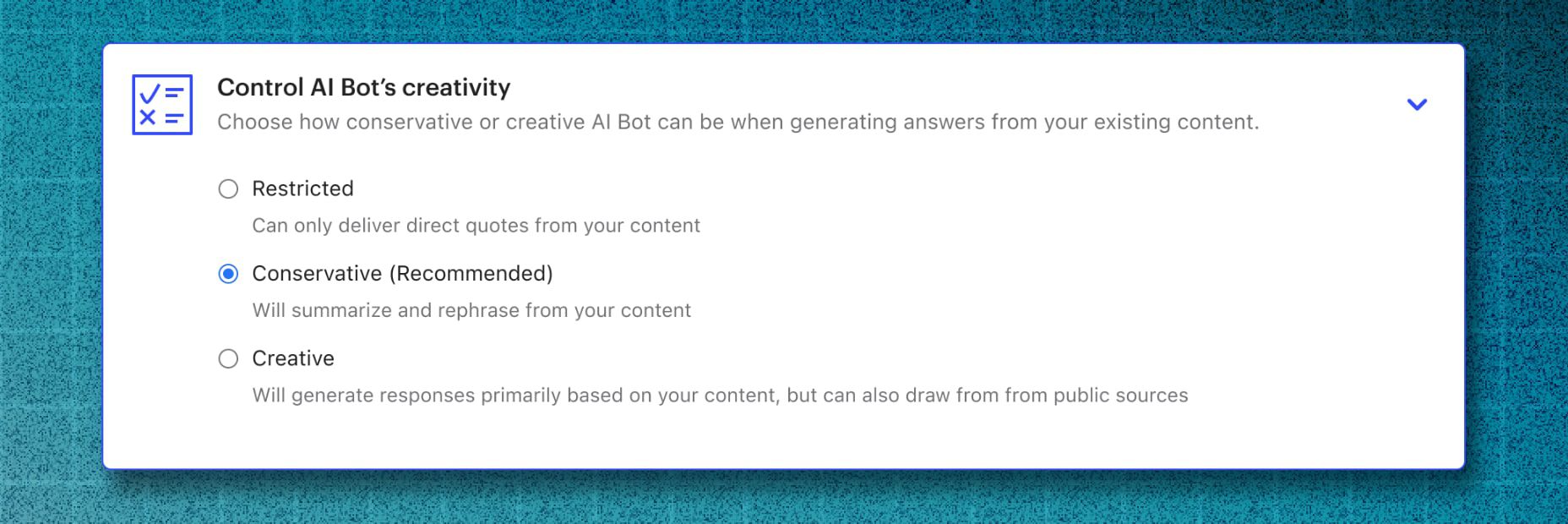

Enfin, nous pensons que différentes entreprises auront naturellement des compromis différents dans ce domaine. Dans cette mesure, nous construisons des paramètres de configuration qui permettent aux entreprises de définir le compromis qu'elles veulent faire, comme on peut le voir dans ce prototype de conception.

Nous explorons les paramètres de configuration pour contrôler le niveau de créativité de Fin

Coût des modèles GPT

Il est important de noter que les grands modèles de langage utilisés pour alimenter ce chatbot sont actuellement coûteux à exécuter. Il s'agit d'une technologie de pointe qui nécessite beaucoup de puissance de calcul. Cependant, nous pensons que cette dépense devrait diminuer avec le temps.

Nous sommes convaincus que pour de nombreuses entreprises, la mise en œuvre de notre chatbot IA aura un retour sur investissement positif, par rapport au fait que des représentants de l'assistance répondent aux mêmes questions.

Latence

Enfin, les grands modèles de langage avancés tels que GPT-4 ont une latence inhérente. Cela peut être vu lors de l'interaction avec le bot - 10 secondes ou plus de latence ne sont pas rares. Nous espérons également que cela s'améliorera avec le temps.

Dans combien de temps Fin sera-t-il disponible ?

Nous avons construit une première version de Fin, que nous avons utilisée pour les tests internes jusqu'à présent, et qui sera bientôt déployée en version bêta limitée. Pour le moment, nos principales contraintes sont le coût et la tarification.

Nous continuons à itérer et à peaufiner l'expérience utilisateur basée sur les tests, et à itérer sur l'intégration entre Fin et Resolution Bot. Nous pensons que les clients avancés continueront à utiliser Resolution Bot et une technologie similaire, en particulier dans les situations où une action doit être entreprise pour résoudre complètement la requête de l'utilisateur, comme l'annulation d'une commande, par exemple.

"Chez Intercom, nous construisons depuis longtemps vers un avenir où la plupart des conversations avec les clients sont résolues avec succès sans avoir besoin d'assistance humaine"

Nous prévoyons de passer rapidement à travers le processus de test dans les semaines et les mois à venir. Pour référence, les fonctionnalités Inbox AI optimisées par GPT que nous avons annoncées fin janvier sont désormais disponibles pour tous nos clients et déjà utilisées par des milliers d'entre eux.

Inscrivez-vous pour l'avenir du service client

Chez Intercom, nous construisons depuis longtemps vers un avenir où la plupart des conversations avec les clients sont résolues avec succès sans avoir besoin d'assistance humaine, libérant ainsi votre équipe pour travailler sur des conversations avec des clients de plus grande valeur.

Nous croyons que l'annonce d'aujourd'hui marque un changement de paradigme dans le domaine du service à la clientèle - l'avenir se passe maintenant.

Vous pouvez en savoir plus sur le nouveau bot alimenté par l'IA et vous inscrire à la liste d'attente ici.