7 wichtige Schritte zum Lernen und Verbessern aus Ihren A/B-Testergebnissen

Veröffentlicht: 2021-04-13

Ihr A/B-Test wurde gerade abgeschlossen, aber Sie sehen nicht die erwarteten Ergebnisse.

Alle anderen teilen Fallstudien, in denen sie mit nur einer Änderung der Schaltflächenfarbe oder einer kleinen Änderung einen enormen Anstieg gesehen haben, aber Ihr Test hat keine Verbesserung der Conversion gebracht, oder schlimmer noch, es scheint stattdessen Geld verloren zu haben, und jetzt müssen Sie es tun Präsentieren Sie dies Ihrem Chef.

Nun, was ist, wenn Ihr Test nicht wirklich ein Verlierer ist?

Was, wenn es ein verkleideter Gewinner ist?

Und wenn es ein Verlierer ist, was ist, wenn ein Verlierertest tatsächlich eine gute Sache ist?

In diesem Leitfaden helfen wir Ihnen, einen tieferen Einblick in Ihre A/B-Testergebnisse zu erhalten, damit Sie sie analysieren und aufschlüsseln können, um das Gold zu finden.

Wir werden behandeln, warum das Lernen aus Ihren A/B-Tests so wichtig ist und warum Verlierer Ihnen Verkäufe bringen können. Wir teilen einen Prozess, dem Sie folgen können, damit Sie Ihre Tests Schritt für Schritt vollständig analysieren und sich sicher fühlen können, was Sie sehen, ob Sie gewinnen oder nicht.

Besser noch, wir helfen Ihnen dabei, von der Angst vor Daten und dem Wunsch, Ihre Analysen nicht zu überprüfen, dazu überzugehen, Ihre Ergebnisse selbstbewusst mit Ihren Kollegen zu teilen.

Tauchen wir also ein…

Warum müssen Sie aus A/B-Tests lernen?

Zunächst einmal sind da die offensichtlichen Kosten. Jeder Test kostet Geld für die Einrichtung. Wenn Sie Varianten verlieren, werden Sie auch einen Umsatzrückgang für diese Variante feststellen.

Hier ist das Ding aber:

Bei A/B-Tests (und CRO im Allgemeinen) geht es nicht nur darum, mehr Geld zu verdienen. Es geht um den Kauf von Daten . Daten über Ihre Zielgruppe können Ihnen helfen, sie besser zu verstehen und bessere Produkte und Dienstleistungen anzubieten. Dies führt dann zu mehr Umsatz und einem verbesserten Kundenerlebnis und sogar zu Einblicken in neue Produktangebote.

Je mehr Sie über die Menschen erfahren, denen Sie dienen, desto besser werden Sie. Deshalb ist es so wichtig, oft zu testen und zu testen – selbst wenn die meisten Tests fehlschlagen.

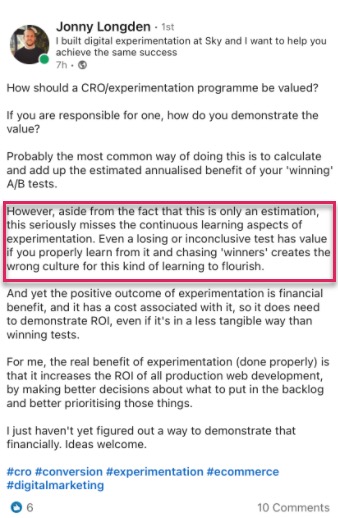

Auch mit dieser Denkweise stehen wir nicht alleine da.

Als wir unsere internen Daten von 28.304 Tests mit unserem Tool zusammen mit Gesprächen mit erfahrenen Testagenturen betrachteten, stellten wir fest, dass die meisten Unternehmen nur 1 Gewinner aus 10 Tests finden, während Agenturen normalerweise 1 Gewinner aus jedem sehen 4.

Und ich weiß, was du denkst,

Das bedeutet doch sicher, dass ich bei jedem Test in 90 % der Fälle Geld verliere?

Ja, aber nur für die Hälfte Ihres Testpublikums. Die andere Hälfte sieht Ihre Website immer noch und konvertiert wie gewohnt.

Außerdem helfen Ihnen die Daten, die Sie erhalten, herauszufinden, was nicht funktioniert, damit Sie lernen können, was funktioniert. Sie testen, lernen, testen erneut und machen weiter, bis Sie herausfinden, was funktioniert.

Und diese 10 % Tests, die gewinnen?

Sie können eine fortlaufende, inkrementelle Steigerung bieten, die immer wieder verbessert werden kann, bevor sie für eine größere Wirkung auf Ihrer Website auf jeder ähnlichen Seite skaliert wird.

Das ist das Schöne daran, einen Anstieg der Conversions auf einer digitalen Plattform zu sehen. Das schiere Ausmaß von nur 1 % Steigerung kann einen enormen Einfluss auf Ihr Unternehmen haben, sowohl jetzt als auch bei allen zukünftigen Zugriffen. Tatsächlich denkt Jeff Bezos in die gleiche Richtung und nennt Amazon und sein Ziel für Tests und Verbesserungen in seinem jährlichen Aktionärsbericht „den besten Ort der Welt, an dem man scheitern kann“:

Bei einer 10-prozentigen Chance auf eine 100-fache Auszahlung sollten Sie diese Wette jedes Mal eingehen. Aber Sie werden immer noch in neun von zehn Fällen falsch liegen .

Jeff Bezos, Amazon

Mehr Umsatz und bessere Einblicke sind jedoch nicht die einzigen Vorteile von A/B-Tests.

Durch das Ausführen von Tests können Sie sich von Hindernissen und Gruppentheorien entfernen. Anstatt Monate damit zu verbringen, mögliche Änderungen am Webdesign zu diskutieren und nichts zu tun, ergreifen Sie Maßnahmen und testen Sie es, damit sich Ihr Team auf andere Dinge konzentrieren kann. (Stellen Sie einfach sicher, dass Sie die Wirkung testen, bevor Sie es live schalten!)

Nicht nur das, Sie können auch etwas Neues über Ihr Publikum lernen, das Ihnen NUR A/B-Tests sagen können.

Theoriebildung und Kundenumfragen sind großartig, aber am wichtigsten ist, was Ihr Publikum tatsächlich auf Ihrer Website tut, nicht nur, was es sagt. Das Verständnis Ihrer Tests hilft Ihnen, diese Ideen und Rückmeldungen zu beweisen oder zu widerlegen.

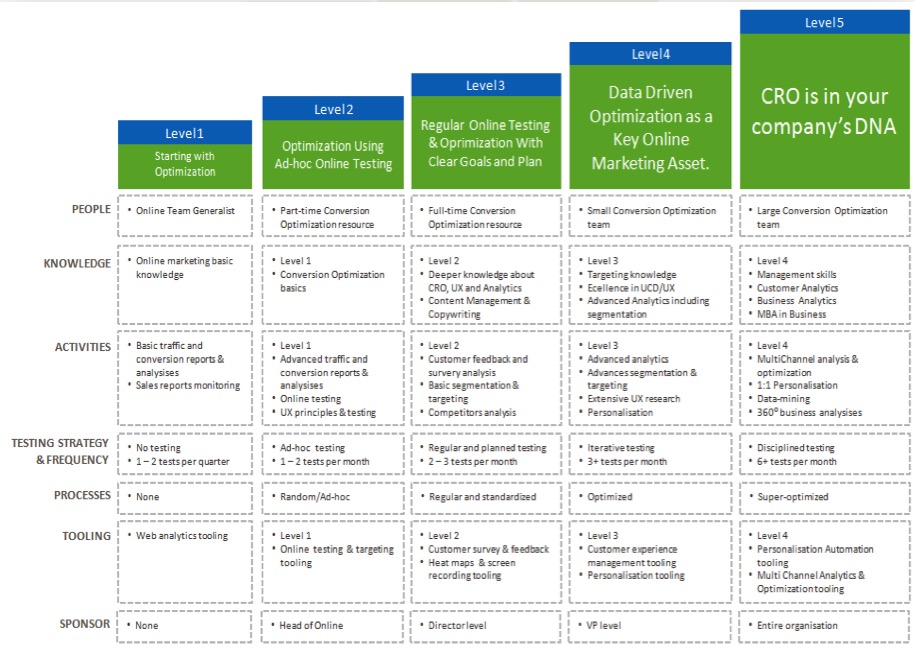

Je besser Sie Ihre Ergebnisse verstehen, desto sicherer werden Sie beim Testen, sodass Sie Ihre CRO-Bemühungen „reifen“ lassen und häufiger Tests durchführen und vielleicht sogar damit beginnen können, ein internes Testteam aufzubauen.

Nun, da Sie den Vorteil sehen, aus jedem A/B-Test zu lernen, lassen Sie uns Sie durch einen einfachen Prozess führen, um jeden neuen Test, den Sie durchführen, zu analysieren…

Der 7-Schritte-Prozess, um aus Ihren A/B-Tests zu lernen (zusammen mit Systemen, die Sie verwenden können, um zukünftige Tests zu verbessern)

Wir haben dies in 7 wichtige Schritte unterteilt, die Sie befolgen müssen.

Möglicherweise haben Sie nicht alle Methoden oder Tools, die wir hier empfehlen, aber wenn Sie sehen, wie sie passen, können Sie ihren Wert einschätzen und entscheiden, ob Sie sie in Ihre zukünftigen Tests integrieren möchten.

Schritt Nr. 1: Überprüfen Sie, ob Ihre Daten korrekt, gültig und aussagekräftig sind

Dies ist der wichtigste Teil dieses gesamten Prozesses. Stellen Sie sicher, dass die Informationen, die Sie zu Ihrem Test haben, sowohl genau als auch gültig sind, damit Sie sich auf die Ergebnisse verlassen können.

Wie stellen Sie also sicher, dass Ihre Testergebnisse Ihnen Daten liefern, denen Sie vertrauen können?

Nun, es gibt ein paar Dinge, die Sie tun können …

Überprüfen Sie die Genauigkeit Ihres Werkzeugs

Nun, die meisten Leute vermissen das. Sie können es gerne überspringen, wenn Ihre Website nicht mehr als 10.000 Besucher pro Monat hat. Technisch gesehen ist es nicht erforderlich, um mit CRO zu beginnen, und funktioniert am besten mit Websites mit einem großen Verkehrsaufkommen, aber ich würde es versäumen, es hier nicht aufzunehmen, da große Websites den Unterschied wirklich sehen können.

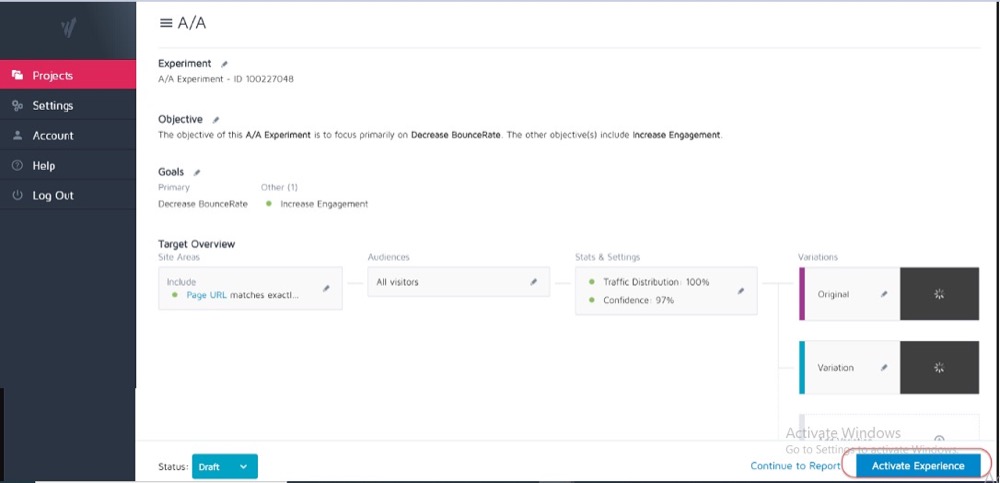

Idealerweise haben Sie bereits einen A/A-Test auf Ihrem aktuellen Testtool durchgeführt, um zu sehen, wie genau es ist und ob es Probleme gibt.

Wie?

Sie führen einen einfachen Split-Test mit 2 identischen Kopien einer Webseite durch und verfolgen dann die Ergebnisse auf diesen 2 identischen Seiten.

Da es keine Unterschiede zwischen ihnen gibt, sollten Ihre Ergebnisse für jede Seite gleich sein. Es kann jedoch zu Abweichungen kommen, die durch das Tool und die Art und Weise, wie es Ihre Daten misst oder verfolgt, verursacht werden.

Wenn Sie dies im Voraus wissen, können Sie eine Toleranz für die Genauigkeit Ihrer Testergebnisse ermitteln und diese als Richtlinie für alle zukünftigen Tests verwenden.

Beispiel

Wenn Sie bemerkt haben, dass Ihr A/A-Test einen Unterschied von 0,5 % in der Conversion-Rate zwischen zwei identischen Seiten zeigte, sollten Sie bei Testergebnissen vorsichtig sein, die einen Gewinner zeigen, wenn es nur ein Unterschied von 0,5 % zwischen der Kontrolle und der Variante ist.

Sie könnten interne Richtlinien aufstellen, die besagen, dass ein Test eine Steigerung von 1 % oder mehr zeigen muss, bevor Sie dem Ergebnis glauben. Auch hier müssen Sie nur einmal einen A/A-Test durchführen, wenn Sie ein neues Tool ausprobieren oder wenn Sie der Meinung sind, dass Ihr aktuelles Tool möglicherweise Probleme mit der Berichterstellung hat oder falsch eingerichtet ist.

A/A-Tests funktionieren am besten bei Websites mit großem Datenverkehr, da die für eine genaue Überprüfung erforderlichen Beispieldaten ziemlich groß sein können, der Unterschied bei einem Fehler von 1 % jedoch enorm sein kann.

Führen Sie Ihren Test lange genug durch, um eine gültige Ansicht darüber zu erhalten, wie Ihre Kunden mit Ihrer Website interagieren

Jetzt, da Sie Ihrem Tool vertrauen, möchten Sie Ihren Test 2-4 Wochen lang durchführen, auch wenn Sie genug Conversions erhalten, um ihn statistisch vorher abschalten zu können.

Wieso den?

Denn Ihr Publikum wird je nach Wochentag oder bestimmten Phasen des Monats oft unterschiedlich mit Ihrer Website interagieren.

Beispiel

Wenn die Leute in Ihrem Publikum donnerstags bezahlt würden, würden Sie einen Anstieg sehen, den Sie vielleicht verpassen würden, wenn Ihr Test nur von Montag bis Mittwoch lief, richtig?

Ebenso könnten andere Benutzer vierzehntägig oder monatlich bezahlt werden, was wiederum Ihre Ergebnisse verzerrt, wenn Ihre Tests nicht lange genug liefen, um sie darin aufzunehmen. Sie würden einfach niedrigere Verkäufe oder Zugriffe für die verpassten Zeiten annehmen.

Woher wissen Sie, wann Sie einen Test beenden müssen? Lesen Sie mehr über die statistische Signifikanz von A/B-Tests: Wie und wann ein Test beendet wird

Achten Sie auf alle internen oder externen Faktoren, die Ihre Ergebnisse beeinflussen können

Dies sind einmalige oder geplante Ereignisse, die Ihre Daten verfälschen könnten.

Zum Beispiel, wenn Ihr CEO oder Ihr Unternehmen in den Nachrichten war oder wenn Sie aktuelle Marketingkampagnen oder Werbeaktionen durchführen, sowie externe Faktoren wie nationale Feiertage oder sogar zufällige Verkehrsspitzen.

All dies kann sich auf Ihren Website-Traffic auswirken und dann ändern, wie genau Ihre Ergebnisse in diesem Zeitraum sind.

Wahre Geschichte:

Vor ungefähr 6 Jahren besaß ich eine Surfbekleidungsfirma.

Eines Tages stieg unser Traffic wie aus dem Nichts um etwa 800 % und unsere Absprungrate schoss in die Höhe. Wir hatten keine neuen Marketingkampagnen durchgeführt, also habe ich ein wenig nachgeforscht, um herauszufinden, woher der Verkehr kam.

Es stellte sich heraus, dass eines unserer T-Shirts einen Produktnamen hatte, der den gleichen Namen hatte wie der neue Song einer koreanischen Popband, und wir haben zwei Tage lang dafür gerankt und ihre Besucher gewonnen.

Dieses neue Publikum interessierte sich natürlich überhaupt nicht für unser Produkt und verließ uns bald.

Verrückt, oder?

Ein anderes Mal fing mein Marketing-Blog an, für den Markennamen eines Fernsehunternehmens zu ranken, und dasselbe geschah. Wir haben Traffic-Spitzen von der falschen Zielgruppe erhalten.

So zufällig dies auch ist, solche Dinge können passieren, also achten Sie auf externe oder interne Ereignisse wie diese. Sie können Ihre Analysen jederzeit überprüfen, um zu sehen, woher der Datenverkehr stammt, und Ihren Test dann neu starten, wenn alles wieder normal läuft.

Stellen Sie sicher, dass Sie genügend Daten erhalten

Sie möchten sicherstellen, dass Ihr Test genügend Conversions aufweist, um eine gültige Vorstellung von seiner Leistung zu erhalten.

Eine Kontrolle und Variante mit nur 50 Conversions insgesamt und nur einem kleinen Unterschied zwischen ihnen reicht nicht aus, um einen Einblick in Ihre Zielgruppe zu erhalten – selbst wenn die Testergebnisse irgendwie statistisch signifikant waren. Die meisten Experten sind sich einig, dass etwa 300+ Conversions pro Variante normalerweise eine gute Faustregel sind (mit sogar noch mehr, wenn Sie später segmentieren möchten).

Je größer der Datensatz, desto einfacher ist es, Erkenntnisse in Ihrer Post-Test-Analyse zu finden.

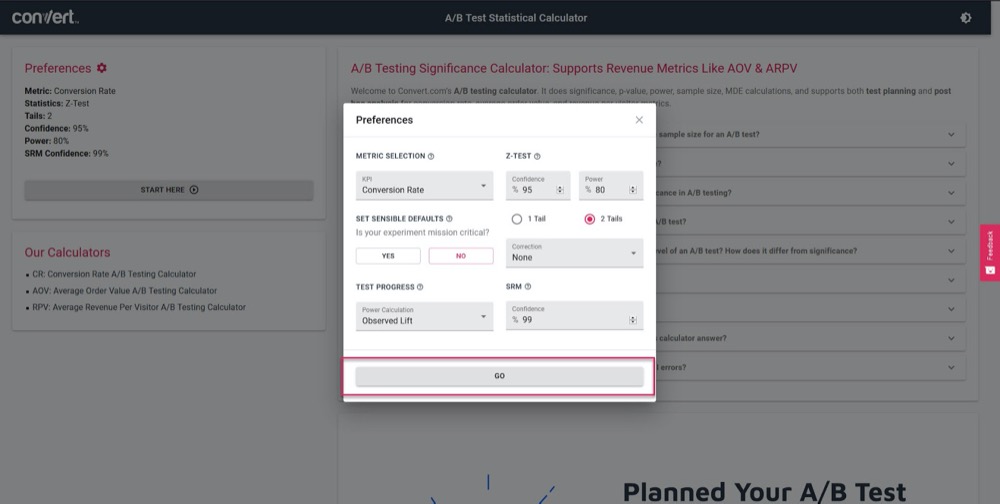

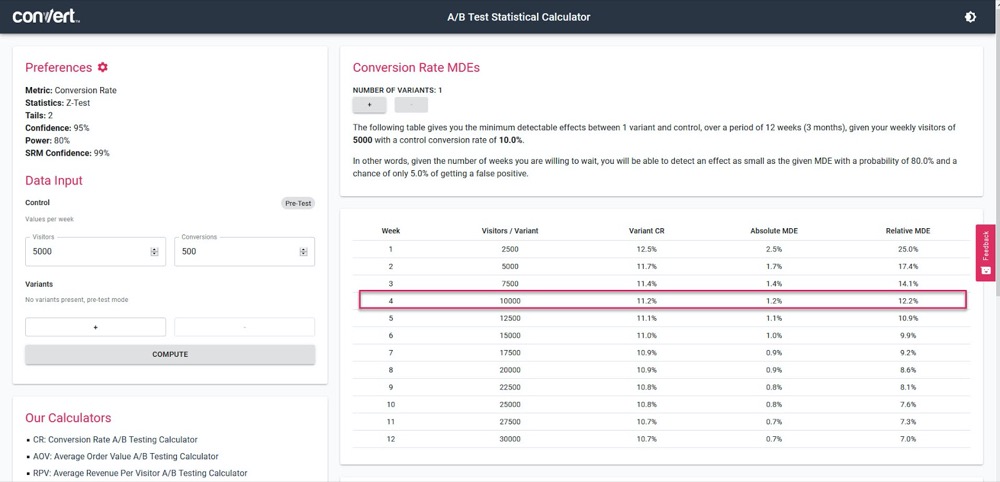

Verwenden Sie unseren Signifikanzrechner für A/B-Tests, um eine Vorstellung davon zu bekommen, wie genau Ihr Test sein wird, basierend auf einem 4-wöchigen Verkaufszyklus und den Informationen Ihrer aktuellen „Kontroll“-Seite.

Stellen Sie einfach Ihre Testparameter ein:

Geben Sie dann ein, wie viel Traffic Ihr Test pro Woche erhalten sollte, zusammen mit der Anzahl der Conversions Ihrer aktuellen Seite, und finden Sie dann die Genauigkeit und den Steigerungsprozentsatz heraus, die Ihr Test berechnen kann.

Im obigen Beispiel können wir nach 4 Wochen nur eine Steigerung von 1,2 % messen. (Wenn wir eine höhere Genauigkeit erzielen möchten, führen Sie den Test einfach länger aus oder erhöhen Sie das Verkehrsvolumen im Test.)

Erhalten Sie statistisch signifikante Ergebnisse

Aus diesem Grund ist die statistische Signifikanz zwar wichtig, aber nicht der wichtigste Faktor beim Testen.

Ja, Sie möchten sicherstellen, dass Ihre Tests lange genug laufen, um eine Vertrauensbewertung von 95-99 % in den Ergebnissen zu sehen, aber Sie möchten auch sicherstellen, dass alle anderen oben genannten Faktoren erfüllt werden.

Wieso den?

Sogar ein A/A-Test kann 95 % Vertrauen darin zeigen, dass eine Version besser ist als ihre identische Kopie, wenn sie nicht lange genug ausgeführt wird.

(Es könnte an einem Tag zufällig alle Conversions auf einer Version sehen und auf dem anderen keine.)

Zu viele neue Tester beenden eine Kampagne, sobald sie auf „Statistik“ trifft, was dazu führt, dass sie falsche Daten erhalten. Aus diesem Grund empfehlen wir Ihnen, eine statistische Signifikanz von 95 % oder höher zu erreichen, aber den Test AUCH über 2–4 Verkaufszyklen mit mehr als 300 Conversions und mit einer ausreichend großen Stichprobengröße durchzuführen.

Wenn Sie all dies tun, können Sie ziemlich sicher sein, dass Sie darauf vertrauen können, dass Ihr Test Ihnen gültige und genaue Ergebnisse liefert.

Ich kann gar nicht genug betonen, wie wichtig es ist, den Test laufen zu lassen, damit Sie diese Kriterien erfüllen.

Wenn Sie einen Test zu früh anrufen, können Sie falsche Informationen erhalten, die zu Folgendem führen können:

- Sie finden keinen potenziellen Gewinner, da Sie nicht genügend Informationen haben,

- Kampagnen mit geringerer Leistung ausführen, weil Sie denken, dass sie Gewinner sind, aber tatsächlich eine niedrigere Conversion-Rate aufweisen,

- Oder schlimmer noch, Sie können falsches Vertrauen in diese Ergebnisse gewinnen und dann das Gelernte verwenden, um es auf andere Teile Ihrer Website auszudehnen und so diese negativen Auswirkungen zu verstärken.

Wissen Sie, wie Ihr A/B-Testing-Tool zu Schlussfolgerungen über erfolgreiche Varianten kommt? Klicken Sie hier, um unseren Rechner für die Bedeutung von A/B-Tests zu verwenden.

Randnotiz:

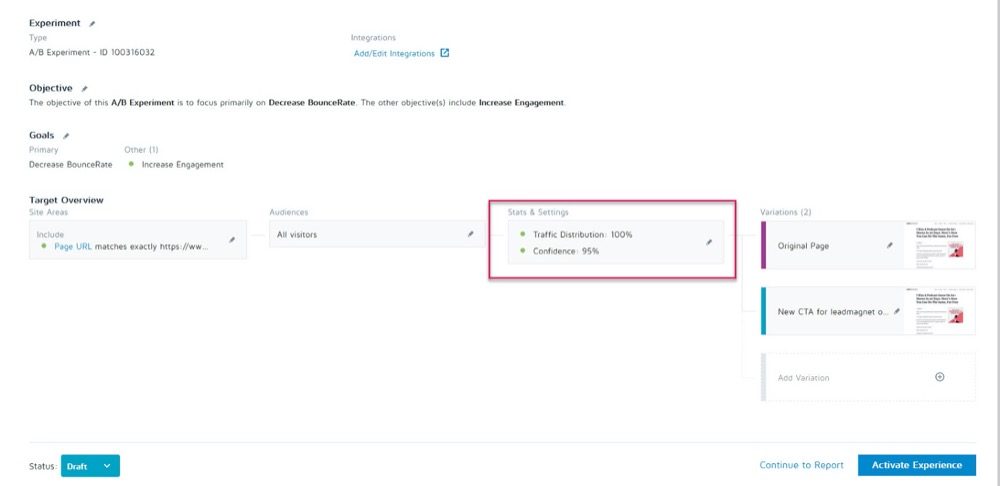

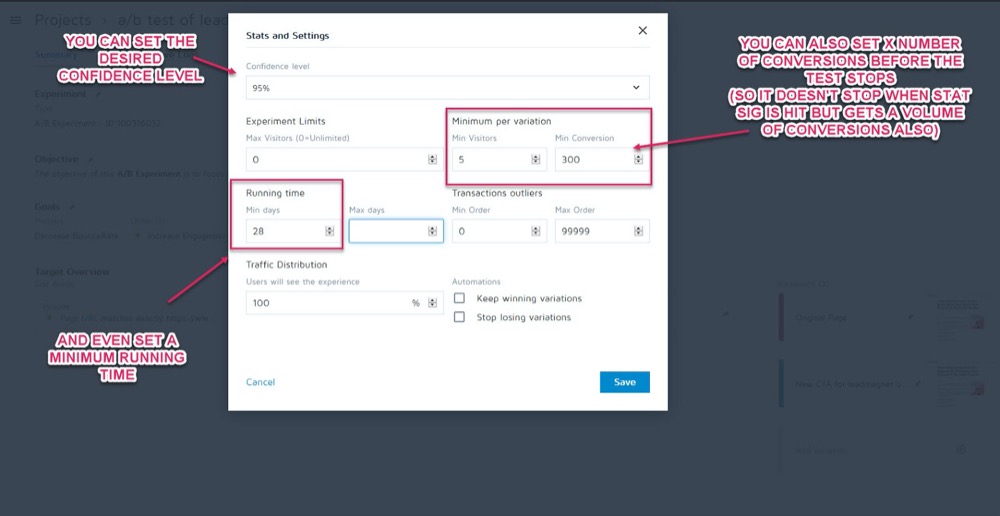

Sie können diese vor Ihren Testläufen im Abschnitt „Statistiken und Einstellungen“ Ihres Experiments in der Convert Experiences-App als Parameter einrichten.

Sie können dann Ihr gewünschtes Konfidenzniveau, die Mindestlaufzeit und die Anzahl der Conversions festlegen, die erreicht werden sollen, bevor der Test aufgerufen werden kann.

Sobald Sie sicher sind, dass Ihre Daten korrekt sind, ist es an der Zeit, sie zu analysieren …

Schritt Nr. 2: Überprüfen Sie Ihre Mikro-, Makro- und Leitplankenmetriken

Die meisten Menschen werden sich einen Test ansehen und den Gewinner oder Verlierer für bare Münze nehmen, was auch immer das Tool ihnen sagt.

Das Problem ist natürlich, dass das Tool Ihnen immer nur sagen kann, wie Ihr Test abschneidet, basierend auf den Kriterien, die Sie dafür festgelegt haben. Als CRO-Tester möchten wir immer das „Wie“ und „Warum“ verstehen, das zu diesen Ergebnissen geführt hat, damit wir daraus lernen können.

Jetzt gibt es ein paar Überprüfungen, die wir durchführen werden, aber zuerst werde ich drei der wichtigsten behandeln. Hier kommt die Nachverfolgung von Mikro- und Makroergebnissen ins Spiel.

Lassen Sie mich erklären:

- Micro-Tracking bezieht sich auf das Tracking des Ziels, für das Sie Ihren Test optimiert haben, was mehr Klicks, Anmeldungen usw. sein können.

- Das Makro-Tracking untersucht die Auswirkung auf die Northstar-Metrik für Ihr Unternehmen, die normalerweise der Umsatz ist.

Warum ist das wichtig?

Manchmal wirkt sich eine Erhöhung des Mikroereignisses auf Ihrer Testseite nicht so auf das Makro aus, wie Sie vielleicht denken.

Beispiel

Angenommen, Sie testen den CTA auf einer Lead-Erfassungsseite und der Verlierer erhält weniger Leads als die Kontrolle.

Scheint offensichtlich, welcher Test gewonnen hat, oder?

Aber bei näherer Betrachtung Ihrer Analysen stellen Sie fest, dass die Leads, die bei diesem „Verlierer“-Test durchkamen, im Backend tatsächlich viel mehr konvertierten und einen viel größeren ROI erzeugten.

Warum sollte das passieren?

Es kann sein, dass Ihre aktuelle Seite ein breiteres Publikum anspricht und mehr Leads konvertiert, aber Ihre neue „verlierende“ Variante spricht tatsächlich Leute an, die jetzt bereit sind zu kaufen.

In diesem Beispiel wäre die unterlegene Kampagne tatsächlich die Seite, mit der Sie schalten möchten, da sie mit Ihrer Northstar-Metrik viel besser konvertiert.

Denken Sie an Ihr Endziel und konzentrieren Sie Ihre Bemühungen auf das, was es am meisten beeinflusst.

Mikro- und Makroergebnisse sind jedoch nicht alles, wonach Sie suchen müssen.

Falls Sie dies noch nicht getan haben, sollten Sie in Erwägung ziehen, Ihren Kampagnen „Leitplanken-Metriken“ hinzuzufügen.

Dies sind Kernmetriken, die Sie im Auge behalten sollten, wenn Sie andere Änderungen vornehmen, damit Sie, wenn sie zu sinken beginnen, bestimmte Testmethoden zurücksetzen oder stoppen können, weil ihre Leistung einfach zu wichtig ist.

Bei Uber führen wir jederzeit Hunderte von Experimenten durch. Das Ziel dieser Experimente ist es, unsere Produkte und das Benutzererlebnis kontinuierlich zu verbessern. Manchmal hat ein Experimentator jedoch einige wichtige Metriken im Sinn und ist sich der Auswirkungen auf einige andere Metriken, die für das Team und das Unternehmen insgesamt wichtig sind, möglicherweise nicht bewusst, und während der Durchführung des Experiments können diese nicht überwachten Metriken zurückgehen.

Um solche Szenarien zu erkennen und abzumildern, haben wir unsere Plattform zur Überwachung von Experimenten ausgebaut. Das Ziel besteht darin, einige Leitplankenmetriken zu identifizieren und zu überwachen, die wir während der Testausführungen nicht beeinträchtigen möchten. Wir wenden eine Variation der sequentiellen A/B-Methodik an, um diese Leitplankenmetriken kontinuierlich zu überwachen und jede Regression zwischen der Behandlungs- und der Kontrollgruppe eines Experiments zu erkennen. Wenn eine Regression erkannt wird, senden wir Benachrichtigungen an den Eigentümer des Experiments .

Suman Bhattacharya, Senior Data Scientist, Uber

Beispiel

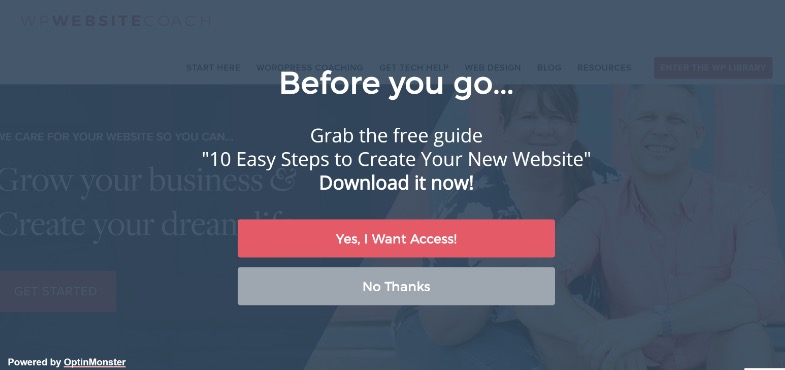

Angenommen, Sie möchten mithilfe von Vollbild-Popups mehr Leads sammeln.

Für einige Websites funktionieren diese großartig, aber nicht immer. (Deshalb testen wir!)

Vielleicht haben Sie ein Vollbild-Popup installiert und begonnen, mehr Leads auf dieser Seite zu erhalten, aber Ihre Willkommens-E-Mails an diese neuen Abonnenten springen ab und werden nicht zugestellt.

Es stellte sich heraus, dass sich die Leute mit gefälschten E-Mails angemeldet haben, nur um die Popups dazu zu bringen, nicht mehr angezeigt zu werden.

Sie möchten keine gefälschten Leads in Ihrer E-Mail-Liste, da diese Ihre E-Mail-Zustellungsergebnisse auf tatsächliche Abonnenten reduzieren können. Sie sollten die Benutzererfahrung auch nicht so stark beeinträchtigen, dass Ihr Publikum das Gefühl hat, dass es seine E-Mails fälschen muss.

Da E-Mail-Marketing ein zentraler Bestandteil Ihres Verkaufsprozesses ist, entscheiden Sie sich, eine Benachrichtigung einzurichten, die Sie darüber informiert, wenn die E-Mail-Absprungrate einen festgelegten Wert überschreitet, während A/B-Tests auf Ihrer Lead-Erfassungsseite ausgeführt werden.

Dies wäre Ihre Leitplankenmetrik. In diesem Beispiel können Sie sehen, dass es kaputt ist, und Sie entscheiden sich für weniger aufdringliche Lead-Erfassungsmethoden.

Ist das sinnvoll?

Guardrail-Metriken sind jedoch nicht nur Lead-Erfassung und Absprungrate. Dies sind Schlüsselkennzahlen, bei denen Sie keinen Einbruch sehen möchten, der sich auf die Benutzererfahrung auswirkt.

Um eine Verschlechterung der Benutzererfahrung zu verhindern und gleichzeitig sicherzustellen, dass Sie auch die wichtigen Metriken verbessern, definieren Sie einige Leitplankenmetriken, die Sie daran hindern würden, mit der Einführung des vermeintlichen „ Gewinner“-Variante. Dies trägt auch dazu bei, die Debatte zwischen Conversion-Optimierung und UX- oder Markenrichtlinien zu beenden .

Alex Birkett, Omniscient Digital

Es liegt an Ihnen, zu entscheiden, was diese Metriken für Ihr Unternehmen sind. Verwenden Sie sie, um zu sehen, ob Sie tatsächlich einen Gewinner haben oder ob Sie einfach den Anstieg eines Ergebnisses gegen einen Verlust in einem wichtigeren Bereich eintauschen.

Wenn Sie etwas Inspiration brauchen, sehen Sie sich Ben Labays Liste gängiger Leitplankenmetriken beim Experimentieren und Testen an:

Nehmen Sie dann diese Änderungen entsprechend vor.

Solange Sie die Convert Experiences-App mit Ihren Analysen und erweiterten Segmenten eingerichtet haben, sollten Sie diese Informationen schnell herausfinden können. Überprüfen Sie die Auswirkung jeder Variation auf Ihre Northstar-Metrik sowie Ihre „Leitplanken“, damit Sie nicht einfach den Gewinner des Testtools auswählen.

Nun, da Sie Ihre Kernmetriken abgedeckt haben, lassen Sie uns etwas tiefer in Ihre Ergebnisse schauen …

Schritt Nr. 3: Gehen Sie tiefer und segmentieren Sie Ihre Ergebnisse

Denken Sie daran, dass beim Testen der Durchschnitt eine Lüge ist .

Das durchschnittliche Ergebnis kann Ihnen immer nur eine breite Information geben, die auf einer Kombination mehrerer Datenpunkte basiert. Es liegt an Ihnen, zu verstehen, warum dieses Ergebnis aufgetreten ist, und dann genauer hinzusehen, da es nicht immer so ist, wie es scheint.

Wir haben dies bereits bei Makroergebnissen gesehen, die von Mikroteständerungen beeinflusst werden, aber Ihre Analysesegmente können noch tiefere Einblicke geben.

Beispiel

Angenommen, Sie führen einen Test für mehr Leads durch. Auf den ersten Blick haben Control und Variante die gleiche Konversionsrate von Besuchern zu Abonnenten.

Bei genauerer Betrachtung stellen Sie jedoch fest, dass die neue Variante auf dem Desktop fast doppelt so hoch ist wie die Konversionsrate, auf Mobilgeräten jedoch null, wodurch der Durchschnitt der Seite mit der Kontrollseite identisch zu sein scheint.

Offensichtlich stimmt etwas nicht, aber warum sollte das passieren?

Es könnte sein, dass die neue Variante auf Mobilgeräten einfach nicht richtig geladen wird oder dass das Formular auf bestimmten Geräten nicht funktioniert, sodass kein mobiler Benutzer, der sich anmelden wollte, dies tatsächlich tun konnte. Und wenn Sie dieses Problem behoben haben, könnte es sein, dass Ihre „gleiches Ergebnis“-Variante tatsächlich in der Lage ist, die Kontrolle weit zu übertreffen.

Sie können diese Dinge immer nur finden, wenn Sie daran arbeiten, mehr Informationen hinter Ihren Ergebnissen zu erhalten.

Mit jedem Test experimentieren Sie Ihren Weg zu Erkenntnissen, die eine intelligentere Segmentierung ermöglichen, die zu neuen Erkenntnissen führt, die Sie schließlich zu einer aussagekräftigeren Strategie führen .

Shanelle Mullins, Shopify

Bei der Segmentierung geht es nicht nur darum, Fehler zu finden, sondern auch um andere Benutzererkenntnisse.

Vielleicht funktionieren die Seite und die Steuerung alle gut, aber wenn Sie genauer hinschauen, stellen Sie fest, dass bestimmte Verkehrskanäle bei diesem neuen Test viel mehr konvertieren als andere?

Oft haben Sie einige Segmente, die eine Underperformance und andere eine Overperformance aufweisen. Dies kann dann neue Personalisierungskampagnen oder bezahlte oder organische Traffic-Strategien informieren.

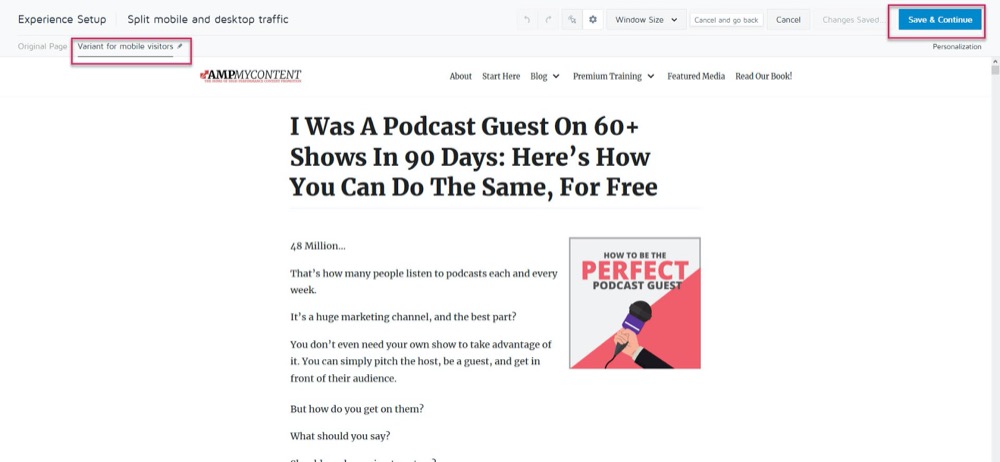

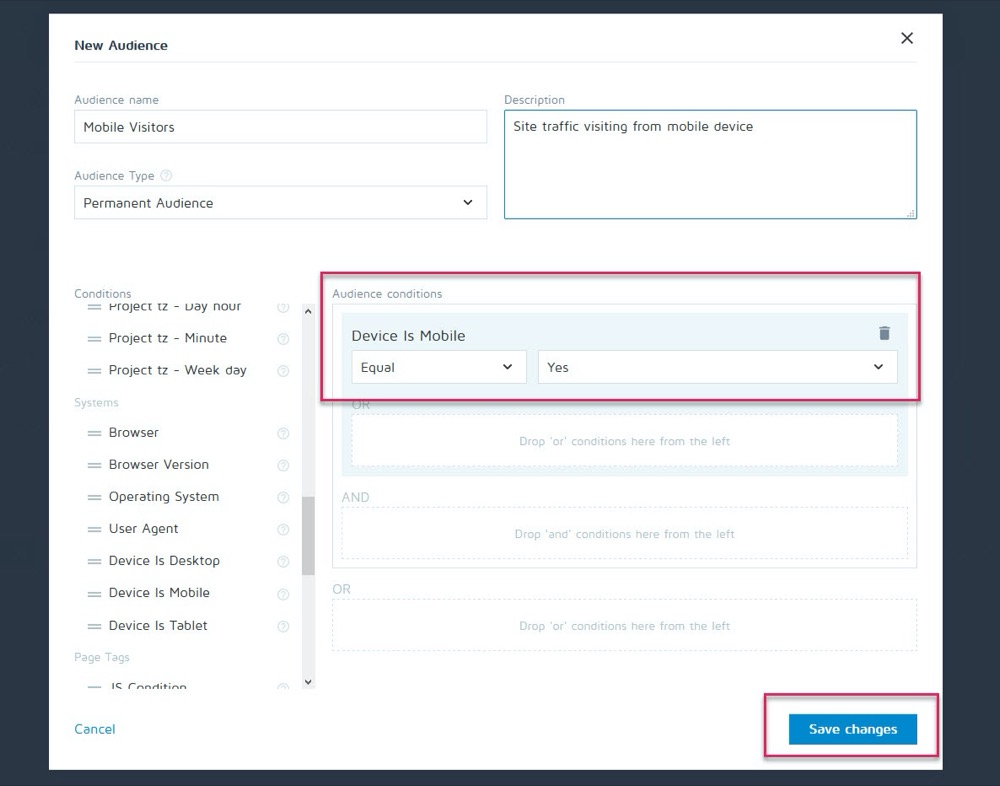

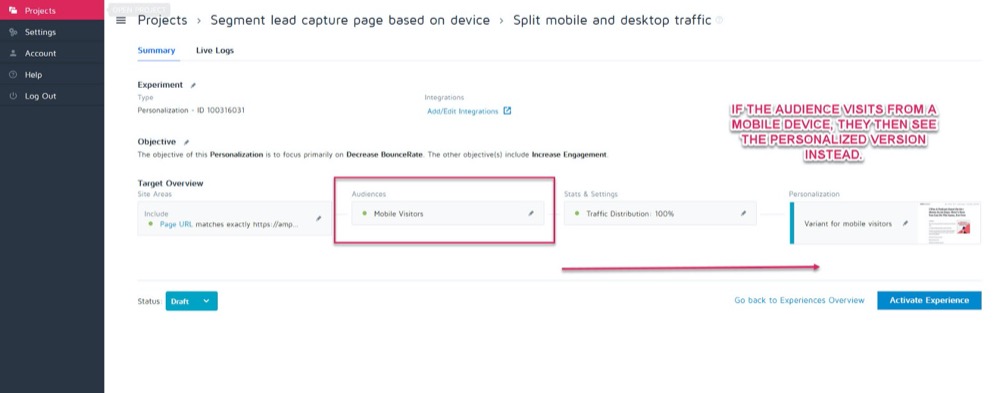

Vielleicht konvertiert das Steuerelement am besten auf dem Desktop, aber die neue Variante konvertiert auf Mobilgeräten besser. Angenommen, Sie möchten auswählen, welche Version angezeigt wird, je nachdem, wie der Betrachter Ihre Website sieht.

Mit der Personalisierungsfunktion von Convert können Sie diese mobile Gewinnvariante als Personalisierung nur für diese Zielgruppe einrichten.

Dann können Sie die neue Version anzeigen, wenn der Besucher von einem beliebigen Mobilgerät kommt.

Aber wenn sie von einem Desktop herüberkommen, würden sie stattdessen die Desktop-Version sehen.

Es gibt eine ganze Menge verschiedener Personalisierungsmethoden, die Sie verwenden können, aber nur, wenn Sie einige Erkenntnisse aus Ihren Kampagnen erhalten.

Der Schlüssel zum Analysieren von Segmenten besteht darin, sich immer Ihre Ergebnisse anzusehen, um zu erfahren, WARUM etwas passiert ist.

Ansehen:

- Neues vs. wiederkehrendes Publikum . Bringt eine Variante die Leute öfter zurück? Konvertiert man mehr kalte/neue Zuschauer?

- Verkehrsquelle. Ist ein Kanal besser als andere? Könnten Sie sich hier mehr konzentrieren?

- Seitenaufrufe. Vor allem, wenn Ihre Testseite versucht, den Verkehr auf Ihre Verkaufsseite zu lenken. Ein Mangel an Klicks auf eine Version kann bedeuten, dass Sie einen defekten Button oder ein CTA-Problem haben.

- Absprungrate. Dies kann auf einen defekten Link/langsames Laden/schlechte UX-Erfahrung hinweisen oder sogar auf die falsche Zielgruppe abzielen.

- Betriebssystem,

- Mobil vs. Desktop.

- Gerät verwendet.

Ein kleiner Verzicht:

Um bei einer solchen Segmentierung eine genaue Wiedergabe jedes Kanals zu erhalten, benötigen Sie VIELE Daten. Eine gute Faustregel ist, einen Test mit etwa dem 10-fachen Konversionsvolumen durchzuführen, als Sie normalerweise durchführen würden (oder 300 Konversionen pro Kanal, nicht nur pro Variantenseite).

Sie denken vielleicht: „Auf keinen Fall bekommen wir genug Datenverkehr, um einen Test wie diesen durchzuführen “. Oder wenn Sie dies tun, kann es Monate dauern, bis dies geschieht.

Auch wenn das der Fall ist, überspringen Sie nicht einfach den Blick auf Ihre Segmentanalyse.

Wieso den?

Auch wenn Sie möglicherweise nicht genügend Conversions in jedem Segment haben, um datengestützte Schlussfolgerungen zu ziehen, kann es Ihnen einige eklatante Einblicke geben, wenn Sie beginnen, Probleme wie Seitenaufrufe ohne Klicks oder eine sofortige Absprungrate zu sehen .

Dies sind alles Dinge, die auf einen fehlerhaften Test hindeuten und Ihnen helfen könnten, einen möglicherweise verpassten Gewinner zu finden. Machen Sie weiter und suchen Sie nach größeren Drop-offs und Problemen. Funktionierte alles auf jeder Plattform und jedem Gerät?

Idealerweise haben Sie sie alle vor dem Test überprüft, aber Dinge können mitten im Test kaputt gehen, also überprüfen Sie es erneut.

Ich persönlich habe WordPress selbst mitten in der Kampagne automatisch aktualisieren lassen, was dann dazu führte, dass Lead-Erfassungsformulare während eines Tests plötzlich nicht mehr funktionierten. Überprüfen Sie immer, und wenn Sie etwas sehen, das die Genauigkeit Ihrer Ergebnisse ruiniert, stoppen Sie den Test, beheben Sie das Problem und führen Sie ihn erneut aus.

Und wenn alles funktioniert hat?

Lassen Sie uns einen Blick darauf werfen und herausfinden, WARUM die Leute Ihre Maßnahmen nicht ergriffen haben …

Schritt Nr. 4: Überprüfen Sie das Benutzerverhalten auf weitere Erkenntnisse

Idealerweise sollten Sie zusätzlich zu Ihrem Testtool ein qualitatives Tracking haben.

Wieso den?

Denn dies kann Ihnen oft Einblicke in Ihre Variante geben, die Sie durch regelmäßiges Testen verpassen würden.

Denken Sie daran:

Quantitative Testtools wie Convert sagen Ihnen, was passiert ist. Wir können Ihnen die rohen numerischen Daten darüber geben, wie viele Personen geklickt oder nicht geklickt haben, und Ihnen helfen, jeden A/B-Test einzurichten.

Das Hinzufügen qualitativer Tools hilft Ihnen jedoch zu verstehen, WARUM eine Aktion stattgefunden hat. Sie ermöglichen es Ihnen, zu sehen, was der Benutzer getan hat, und erhalten einen besseren Einblick in seine Aktionen.

(Tests scheitern normalerweise entweder aufgrund einer schlechten Ausführung oder aufgrund des Verständnisses des Publikums, und nur wenn wir sehen, was schief gelaufen ist, können wir es beheben.)

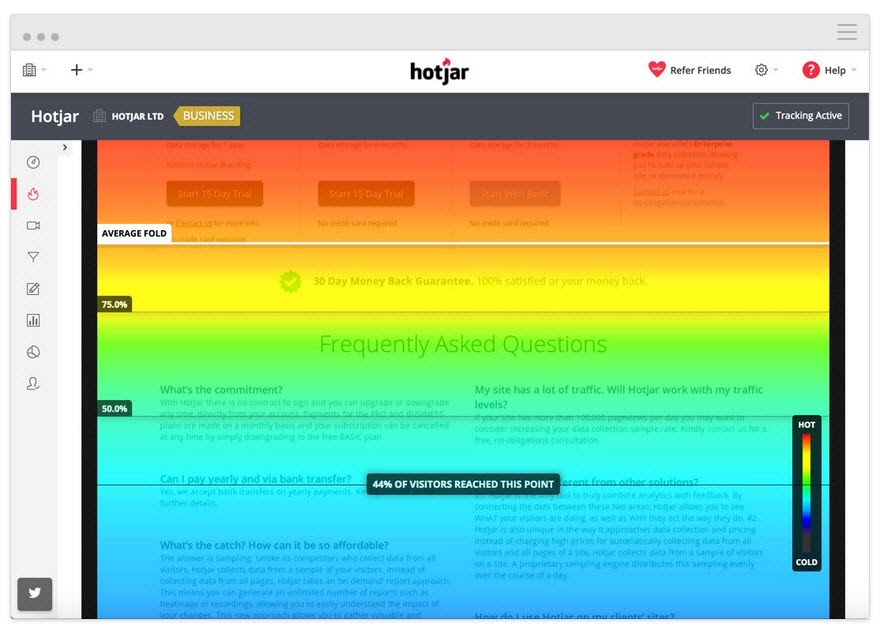

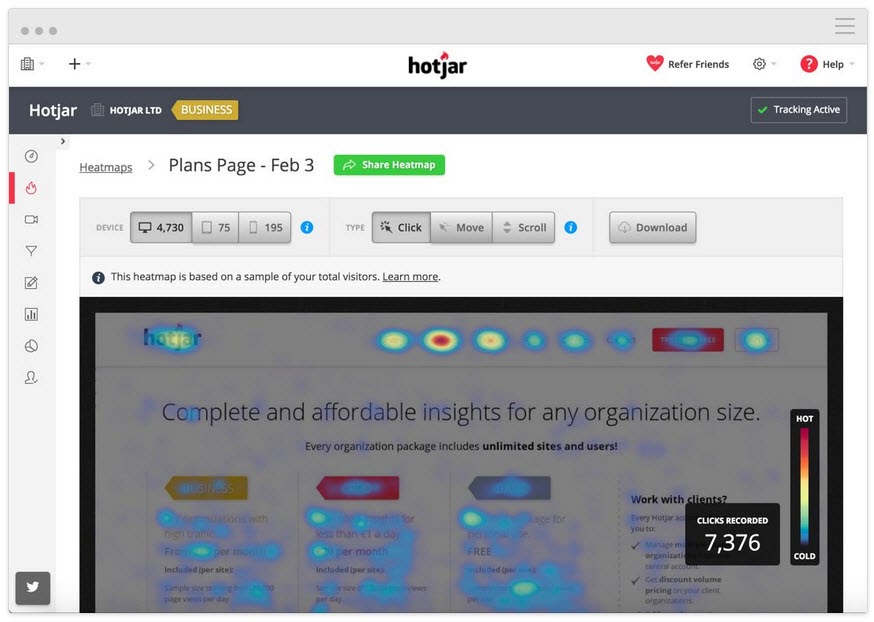

Mit einem Tool wie Hotjar können Sie eine Reihe qualitativer Tests durchführen und die Daten mit unserer integrierten Integration sogar direkt in Ihr Convert-Dashboard ziehen.

Um tiefere Einblicke zu erhalten, richten Sie die Hotjar – Convert-Integration ein und probieren Sie die folgenden Taktiken aus.

Verfolgen Sie, wie weit der Benutzer liest

Fügen Sie Ihrer Seite ein Heatmap-Tool hinzu, um zu sehen, ob Ihre Zielgruppe Ihren CTA erreicht. Wenn nicht, können Sie Ihren Test erneut durchführen und den CTA auf der Seite nach oben verschieben.

Verfolgen Sie, worauf Benutzer klicken, aber nicht sollten

Klicken sie auf strategische CTAs oder ist es zufälliger Text, den sie stattdessen für einen Link halten?

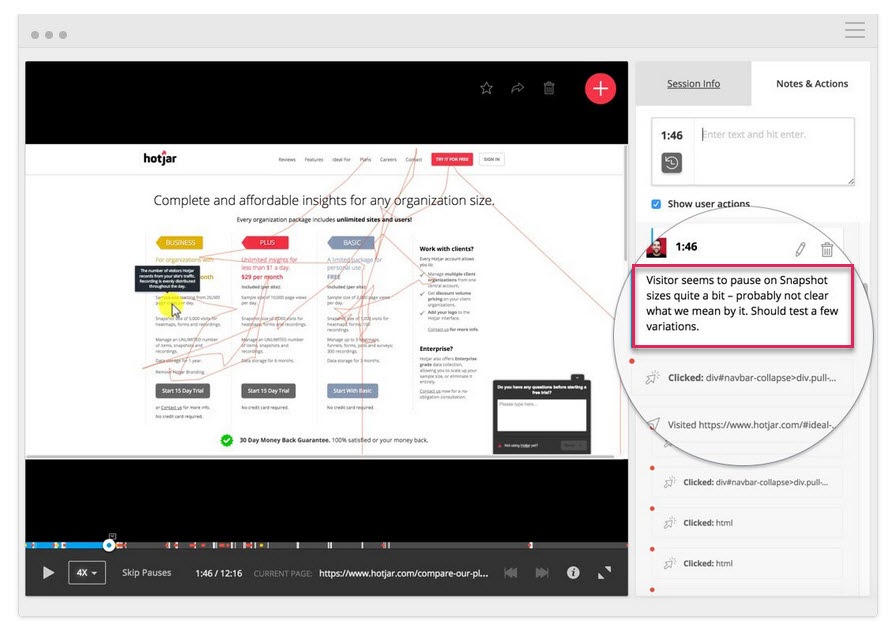

Sehen Sie sich Bildschirmaufzeichnungen an, um zu sehen, worauf sie nicht klicken, aber sollten

Klicken sie nicht auf Ihren CTA-Button, obwohl sie weit genug scrollen, um ihn zu sehen? Klicken sie, aber es öffnet sich nicht? Sehen sie es, merken aber nicht, dass es sich um eine Schaltfläche handelt, auf die geklickt werden muss?

Sie können sich das alles ansehen und sogar Notizen hinzufügen, wenn diese Dinge auftauchen.

Es sind nicht nur Heatmapping- und Klick-Tracking-Tools, die helfen können.

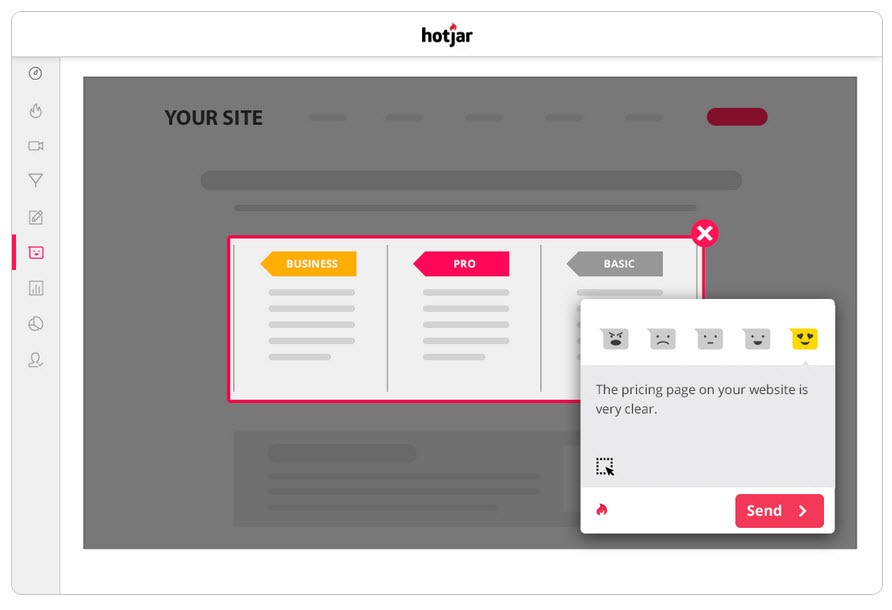

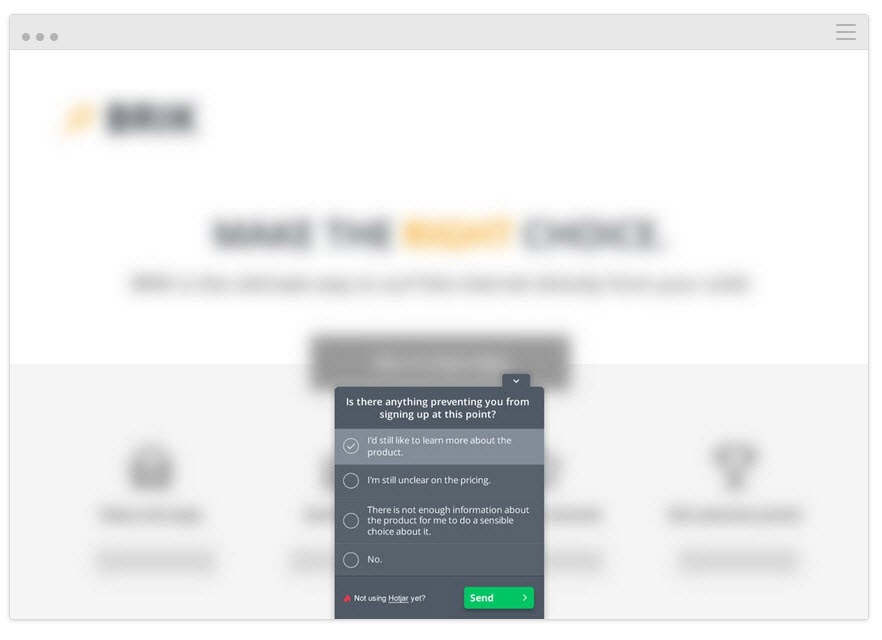

Führen Sie Umfragen für Ihr Publikum durch

Umfragen helfen Ihnen nicht nur, Feedback darüber zu erhalten, was Ihr Publikum dazu veranlasst hat, Maßnahmen zu ergreifen (oder es zu stoppen), sondern geben Ihnen auch die Sprache, die es verwendet, um dies zu beschreiben.

Beim Verfassen von Texten nennen wir dies „Spiegelsprache“ und es ist unglaublich effektiv, eine Verbindung zum Benutzer herzustellen. Es fühlt sich an, als ob Sie ihr Problem nicht nur erkennen, sondern es besser verstehen als jeder andere, da Sie es mit denselben Worten beschreiben, die sie verwenden.

Zwei großartige Möglichkeiten, Umfragen zusammen mit Ihrem A/B-Testtool zu verwenden, sind:

- Beenden Sie Intent-Umfragen . Identifizieren Sie diejenigen, die die neue Version nicht verwenden, damit Sie herausfinden können, was sie davon abgehalten hat.

Gibt es einen Grund, warum Sie sich heute nicht entschieden/gekauft haben?

- Umfragen nach dem Kauf/Umwandlung. Finden Sie diejenigen, die die Variante nehmen, und sehen Sie, ob es irgendwelche Knackpunkte und Motivationsfaktoren gab.

Was hat Sie dazu bewogen, heute zu handeln?“ Gab es etwas, das Sie fast davon abgehalten hätte, sich zu entscheiden?

Sie können sogar ähnliche Umfragen auf der Steuerung durchführen, wenn Sie weitere Informationen wünschen. All dies hilft Ihnen zu verstehen, wie der Test durchgeführt wurde, damit Sie ihn wiederholen und verbessern können.

Apropos…

Schritt Nr. 5: Lernen Sie aus dem Verlieren von Tests

Das Wichtigste, wenn es darum geht, einen Test zu verlieren, ist, etwas aus dem Ergebnis zu lernen. Es gibt keinen schlechten Test, solange Sie Erkenntnisse daraus ziehen können, um Ihr Publikum zu verbessern oder besser zu verstehen.

A/B-Testing ist ein interaktiver Prozess. Wir scheitern vorwärts, während wir Verständnis gewinnen. Sie können oft viel mehr lernen, wenn Sie einen Test mit einem Gewinner verlieren, als nur einen Gewinner zu bekommen.

Bisher haben wir 3 Dinge gemacht:

- Sicherstellen, dass die Testdaten korrekt sind,

- Betrachten Sie die Rohergebnisse für Probleme und

- Versuchen, unsere Benutzer und ihre Handlungen zu verstehen.

Dieser Schritt ist eher ein heuristischer Ansatz, um Ihnen zu helfen, die häufigsten Probleme zu verstehen, die zu einem Fehler führen können (vorausgesetzt, die Testdaten sind korrekt und die CTA-Schaltflächen funktionieren alle) und Ihren Ansatz und Ihre Hypothese zu analysieren.

War Ihre Hypothese falsch oder war Ihr Test falsch ausgerichtet?

Dies ist ein häufiges Problem, insbesondere bei neuen Testern.

Haben Sie Ihren Test anhand einiger „Woo Woo“-Metriken oder Ideen durchgeführt, die nicht auf einen tatsächlichen KPI abgestimmt waren?

Beispiel

Nehmen wir an, Sie möchten mehr Verkäufe von einer Seite, aber aus irgendeinem Grund haben Sie sich entschieden, stattdessen Optimierungen an Ihren Schaltflächen zum Teilen in sozialen Netzwerken zu testen. (Obwohl Sie keine Daten haben, die zeigen, dass mehr Social Shares Ihren Umsatz beeinflussen.)

Es klingt verrückt, aber Sie werden überrascht sein, wie oft so etwas passiert.

Frag dich selbst:

Stimmt mein Testziel mit einem Kern-KPI überein und in einer Weise, die es beeinflussen kann?

Wenn dies nicht der Fall ist, ist das in Ordnung, aber stellen Sie sicher, dass der nächste Test besser ausgerichtet ist.

Wir scheitern, wir lernen, wir versuchen es erneut.

Konzentrieren Sie sich bei Ihrem nächsten Test unbedingt auf Ihre wichtigsten KPI-Metriken und wie Sie sie beeinflussen können, und geben Sie dem Test auch ein klares Win/Fail-Szenario.

Wir möchten, dass diese Seite mehr Leads erhält, also testen wir das, was sie dazu bringt, sich anzumelden, was bedeutet, dass wir einen besseren CTA erstellen möchten.

oder

Wir möchten, dass diese Seite mehr Leads erhält, und wir haben festgestellt, dass Benutzer nicht bis zu unserem CTA scrollen, also testen wir, ob er auf der Seite nach oben gehoben wird.

Wenn Sie Ihren Test an Ihrem Ziel ausrichten, werden Sie auf den richtigen Weg gebracht, aber selbst dann werden möglicherweise immer noch nicht mehr Conversions angezeigt…

Die Hypothese war richtig und der Test wurde ausgerichtet, aber es gab immer noch keine Änderung der Ergebnisse

Dies kann in 90 % der Fälle passieren und ist der Grund, warum die meisten Tests fehlschlagen.

Beispiel 1

Ihre Benutzerdaten zeigen, dass Benutzer Ihrer Website nicht genug vertrauen. Sie haben Vertrauensfaktoren wie Social Proof, Benutzerreferenzen und SSL-Zertifikate hinzugefügt, aber die Conversions sind immer noch nicht gestiegen.

Bedeutet das, dass Sie aufhören und einen neuen Test oder Blickwinkel ausprobieren sollten?

Gar nicht…

Ihre anfängliche Hypothese mag richtig gewesen sein, aber Ihr Test muss nur verbessert oder besser ausgeführt werden, bevor Sie einen Effekt sehen können.

Sie könnten versuchen, weitere Vertrauensfaktoren hinzuzufügen oder sogar die vorhandenen zu verschieben, damit sie stärker hervorstechen. Vielleicht formulieren Sie die darin verwendete Sprache um, damit sie sich besser mit Ihrem Publikum verbinden können.

All diese Dinge stimmen immer noch mit der ursprünglichen Hypothese überein, Sie müssen nur mehr Versionen testen, um den Gewinner zu finden.

Beispiel #2

CXL hat auf dieser Zielseite 6 verschiedene Testkampagnen durchgeführt, um mehr Leads für Lkw-Fahrerzertifizierungen zu erhalten.

Sie haben die Opt-in-Rate von 12,1 % auf 79,3 % erhöht, weil sie die Seite kontinuierlich verbessert haben.

(Fast alle diese Testkampagnen haben mehrere Versuche mit derselben Hypothese unternommen, bevor sie eine Steigerung gesehen haben. Erst dann haben sie weitergemacht und getestet, um die anderen Elemente auf der Seite zu verbessern.)

A/B-Testing ist ein iterativer Prozess. Sie müssen ständig testen und optimieren, um Verbesserungen zu finden, und selbst die Besten in der Branche finden möglicherweise nur in 10 % der Fälle einen Gewinner.

Wenn Sie hypothetisch eine Organisation wären und jeder von Ihnen durchgeführte Test ein Erfolg war, dann wäre das meiner Meinung nach tatsächlich ein Warnsignal.

Es klingt kontraintuitiv, aber es zeigt mir, dass Sie nur offensichtliche Dinge testen und nicht genug Risiko eingehen, um die Nadel wirklich zu bewegen .

Deborah O'Malley, Rate den Test

Es ist immer toll, von den Besten zu lernen, und wir freuen uns, das Interview mit Deborah zu teilen. Wir sprachen darüber, warum Tests niemals fehlschlagen und wie wichtig es ist, beim Testen die richtige Mentalität zu haben. Um Ihnen den richtigen Einstieg zu erleichtern, hören Sie sich hier unser Interview an.

Das bedeutet, dass Sie möglicherweise 9 Tests benötigen, bevor Sie einen positiven Lift sehen, also bleiben Sie dabei.

Ihre Tests sollten einem Prioritätssystem von der größten bis zur niedrigsten Auswirkung folgen. Indem Sie mehr Tests und Änderungen durchführen, um Ihre aktuelle Kampagne zu verbessern, werden Sie weitaus mehr Wirkung sehen, als zu einem Test mit geringerer Wichtigkeit zu springen, weil Sie mit Ihrer aktuellen Kampagne keine sofortigen Ergebnisse sehen.

Und wenn es immer noch keine Verbesserung mit kleineren Änderungen gibt, ziehen Sie in Betracht, einen innovativen Test durchzuführen, bei dem Sie ein anderes Design ausführen.

Es kann eine Schaukel für den Zaun sein, aber manchmal kann es die Änderung sein, die Sie vornehmen müssen.

Was ist, wenn die Variante nach all diesen Tests und Optimierungen immer noch ein Verlierer ist?

Die Daten sind also korrekt und Sie haben jede Optimierung ausprobiert und sogar große innovative Änderungen an der gesamten Seite vorgenommen, und sie wird immer noch nicht besser abschneiden als die Kontrolle.

Es mag nicht so aussehen, aber das ist eigentlich eine gute Sache.

Wieso den?

Weil Sie herausgefunden haben, was bei Ihrem Publikum nicht funktioniert!

So viele Websites nehmen große, umfassende Änderungen vor, ohne etwas zu testen, und führen sie einfach unabhängig davon ein.

Fragen Sie sich Folgendes:

Wenn diese Seitenvariante nur 1 % schlechter konvertiert als Ihre aktuelle Kontrolle, wie viel Geld haben Sie dann gespart, indem Sie sie zuerst getestet und nicht eingeführt haben?

Back in 2014, Marks and Spencer decided to update their entire website without testing it with a sample audience first.

The result?

Their online sales dropped by 8.1% in 3 months, causing a loss of $55 million.

This is why testing and finding losers is a really good thing because even losing tests can save you money.

What if the Test and the Variant Have Identical Results?

You checked everything, it all works, you've segmented down and gone into the nitty-gritty, but there's just no discernible difference between your current page and your new variant.

You've even tried complete page overhauls but through some fluke of math, your new page still converts at the same rate as the old one.

In this case, it's simply the dealer's choice.

Does the new variation more actively represent your brand and style?

If so, choose whichever you wish to use. The results are still the same but you are happier with the design.

Note: This should be the only time that you do this. Branding should not sacrifice results; it should aid them, as seen in the previous example.

Step #6: Double Down on Winners and Continue to Improve Them

So far we've been covering losing campaigns, but what if you got a winner right out of the gate?

First off, congratulations!

Second, let's make sure you actually have a winner. Oftentimes, things can happen to affect your results and give you a false positive (ie we think it's a winner but we implement it and nothing happens.)

Go ahead and run the test again with just your control and the winning variant and prove the lift in results first before you make any changes to your site.

Then if it really is a winner? Don't stop there, continue to improve it!

Iterative improvements of a new winning campaign are the easiest new test to run. With each new improvement, you'll see more ongoing ROI. You can even take what you learned with your winning test and then roll it out across similar pages on your site for further tests and see if it also adds lift there too.

Step #7: Create a Learning Repository for Future Tests

This step is relevant to both winning and losing tests.

Not only will it help you with future tests, but it will also help your QA team diagnose any broken campaigns faster, as they can see where issues have appeared in the past.

Better still?

It will help you document your results for clients or your boss, while also standardizing your reporting processes and ramping up your test velocity.

So funktioniert das:

You're going to create a master archive or learning repository of all past tests. A place to document your previous wins and losses that you can use to both reference for new campaigns and share with stakeholders or customers.

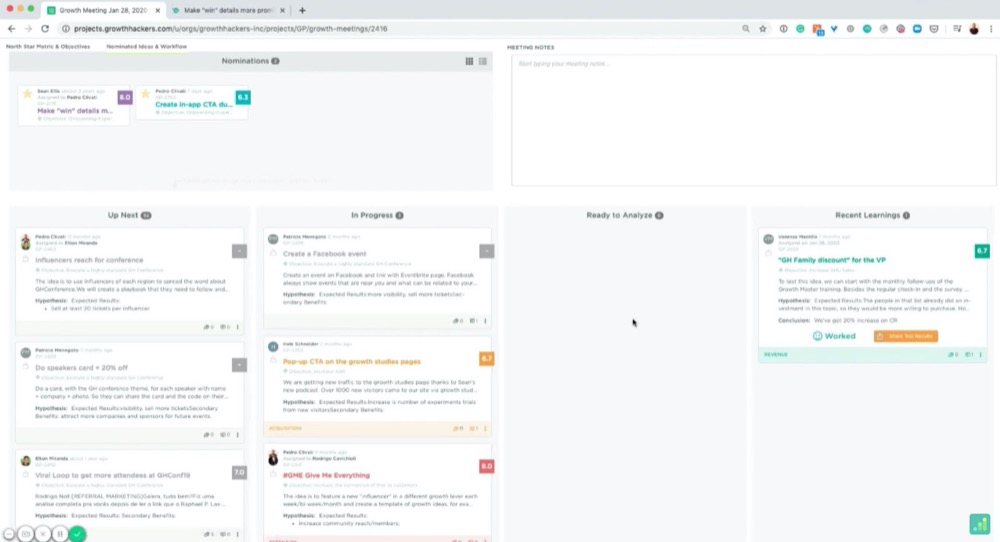

You can use a folder on your computer for this, but, if you really want to get organized, there's a great tool called GrowthHackers experiments.

Its main goal is to help marketing growth teams communicate and organize campaigns, but you can easily use it to manage your CRO testing and learnings. It will even pull in results from your test tool and allows you to archive each test. (You can simply tag and then add them to the repository.)

Whatever you decide to use, here are some best practices:

Organizing Your Tests

You probably have your own naming conventions but if you're just starting, I recommend naming each test like so:

“Goal – Campaign – Test Date”

Zum Beispiel:

“CTR lift test – XYZ client – March 1st-14th 2021”

This way, you can organize tests by goals to get inspiration for future tests, search through and find them for client campaigns, or look back on your experiments month by month.

Then, if you wanted to run a CTR test later on, you can swipe through them and see what ideas worked or failed in the past.

How Do We Create Documents for the Learning Repository?

Feel free to add screenshots of your testing tools graphs, confidence, and power level or any data that you think is relevant.

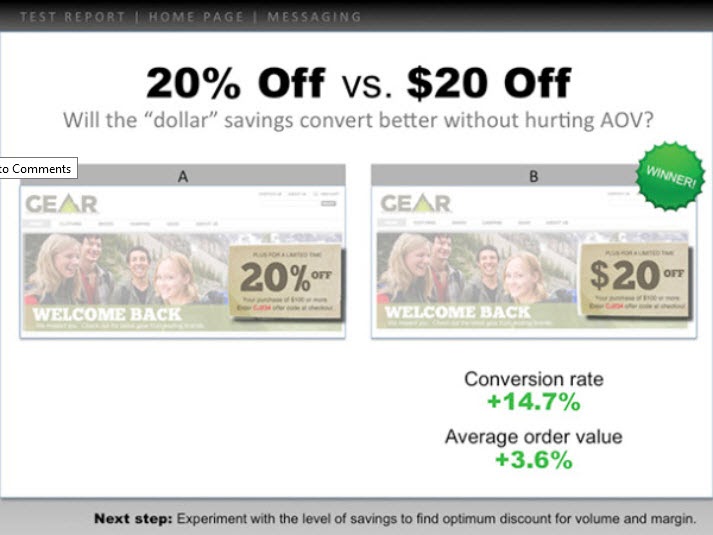

However, I highly recommend creating a slide with the following information:

- The hypothesis and how you came up with the idea (any survey data or information).

- A headline with the test goal.

- A screenshot of the control, the winning variant, and any other failed versions/tests that got some lift but not as much. (Highlight the key elements so you can spot what changed without having to look too hard.)

- Add the micro goal and its percentage lift. (Perhaps 3.2% CTR)

- Then add the macro goal and its percentage lift. (AVG order value up 2.2%, etc.)

Hier ist ein Beispiel:

You can use these slides to present the test information to anyone else who needs them, while also having a simple file to understand the test at a moment's notice.

Pretty handy, right?

Now that you've analyzed your test and recorded the results, let's walk you through how to present this to your boss in a way that even if the test failed, they're still happy to see your findings…

How To Present This Information To Your Boss (Even When Your Campaigns Failed)

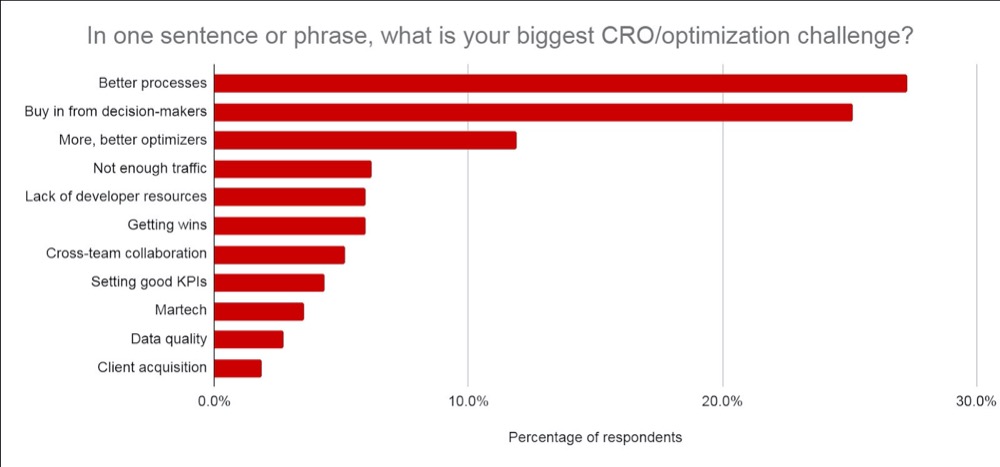

Don't worry if you feel anxious about this, you're not alone. In fact, according to CXL's state of the industry report, presenting test information or getting buy-in from your stakeholders is consistently one of the biggest struggles CROs face.

We've covered the best ways to communicate this information before, but I want to give you a few extra tips on how to get your test results across (even if your test failed).

Tip #1: Get Everyone On Board With CRO and Its Realities as Soon as Possible

Ideally, you covered this when you first broached the topic of running A/B tests but it never hurts to recap.

Make sure they understand that A/B testing is a continual learning process that's more about understanding your audience and improving their experience. The lift in ROI is simply a byproduct of taking action on each test and implementing what you learn, regardless of if it wins or fails.

Winners give lift and losers give insight into where to improve.

No test is ever wasted but the majority of them do fail. You're looking at roughly 1/10 winners for most people's tests and agencies are around 1/4.

Be clear on how many tests fail and the need to run more tests to find winners.

Tip #2: Present the Information as Simply as You Can

Not everyone can read graphs easily. Even if they can, it still means that it takes effort to understand the context of what they are seeing.

The more effort it takes to understand something, the more frustrating it can be and can cause you to lose the other person's attention.

(Top tip for landing pages btw ^^)

Break it down nice and simple by using the slides from your learning repository.

It should already include:

- Was du vorher gelernt hast und wie du auf die Testidee gekommen bist.

- Was du getestet hast. Zeigen Sie die Kontrolle, die Variationen und den Gewinner.

- Wie es auf Mikro- und Makroebene geklappt hat. Fügen Sie die Ergebnisse hinzu.

Finally, add any insights you drew from tests to decide on your next important action to take. (Improve execution, test new variations, new hypothesis, etc.)

Providing insight into what happened is HUGE.

Ihr Chef interessiert sich mehr für das, was Sie gelernt haben, als für die Ergebnisse, da darauf reagiert werden kann. Wenn Sie dies teilen und Ideen für die nächsten Schritte geben, können sie erkennen, dass Sie die Situation unter Kontrolle haben, und sich für weitere Tests sicher fühlen.

Tipp Nr. 3: Lass sie gut aussehen

Gehen Sie noch einen Schritt weiter und fügen Sie Daten hinzu, die ihnen wichtig sind:

- Wenn der Test fehlgeschlagen ist, geben Sie an, warum er Ihrer Meinung nach fehlgeschlagen ist . Fügen Sie den eingesparten ROI hinzu, indem Sie den fehlgeschlagenen Test nicht einführen, und wie er sich auf MRR und ARR auswirken würde.

- Wenn es gewonnen hat, geben Sie Einblicke in den erzielten ROI und wie sich dies auf den Jahresumsatz / MRR und ARR im Jahresvergleich auswirkt , zusammen mit der Möglichkeit, es weiter zu skalieren und einen höheren ROI zu erzielen. (d. h. Sie haben möglicherweise eine Lead-Erfassungsseite getestet und beim Optimieren des Layouts eine Steigerung festgestellt. Möglicherweise haben Sie 30 andere ähnliche Seiten, auf die Sie diesen Test anwenden könnten, die eine potenzielle Steigerung erkennen könnten.)

- Wenn der Test flach verlaufen ist, teilen Sie Ihre Erkenntnisse darüber mit, was Ihrer Meinung nach passiert ist und was als Nächstes zu tun ist. (Bessere Ausführung, eine neue Variante, eine vollständige Änderung oder ein besser ausgerichteter Test usw.)

Sicher, die Auswirkungen von ARR + MRR oder YOY sind eine grobe Schätzung, aber sie zeigen die potenziellen Auswirkungen und den Wert Ihrer Tests. Das ist es, was Ihrem Chef wichtig ist und woran er möglicherweise denkt, wenn er Ihre Ergebnisse sieht.

Vertrauen Sie mir, wenn Sie Ihre Informationen so präsentieren, werden Sie feststellen, dass sie viel einfacher rüberkommen. Sie stellen den Test nicht mehr als „verlorenes Geld“ oder Zeitverschwendung dar, sondern konzentrieren sich stattdessen auf potenzielle Einsparungen, tatsächliche Einnahmen und potenzielles weiteres Wachstum.

Nicht nur das, Sie werden auch in der Lage sein, den Wert zu beweisen, wenn Sie noch mehr Tests durchführen, Ihre CRO-Bemühungen ausreifen und Ihre Testgeschwindigkeit erhöhen.

Fazit

Hier hast du es.

Inzwischen sollten Sie viel sicherer darin sein, Ihre A/B-Testergebnisse zu analysieren und daraus zu lernen, und diese Informationen Ihrem Chef oder anderen Personen präsentieren können, unabhängig davon, wie Ihre Tests abgeschnitten haben.

Befolgen Sie einfach diese Anleitung, um die Post-Test-Analyse jedes neuen A/B-Tests, den Sie durchführen, zu optimieren!